2025年AI内容检测工具指南:先判断分数能不能信,再决定买哪款

这不是一篇模板化榜单,而是一份面向老师、编辑和内容团队的 AI 内容检测决策指南。重点解决高分结果该不该信、中文和多语言内容怎么选、以及哪些工具适合真实工作流。

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者2025年AI内容检测工具指南:先判断分数能不能信,再决定买哪款

如果你是老师、编辑或者内容负责人,真正棘手的时刻通常不是“找不到检测工具”,而是已经看到一个 72%、84% 甚至更高的 AI 分数,却不知道这个结果到底能不能作为下一步动作的依据。学生可能会被误判,稿件可能会被错杀,团队也可能把大量时间浪费在无效复核上。

这篇重写版不再做“哪款最准”的模板榜单,而是先回答更接近现场的问题:什么情况下检测结果只是弱信号,什么情况下值得上第二个工具复核,什么情况下必须回到人工审阅和写作过程证据。只有把判断顺序理清,后面的工具选择才有意义。

TL;DR

- AI 检测器更适合做“风险分流”,不适合做“单点定罪”。Google 关注的是内容质量而不是生产方式(Google Search Central,2026-03-18);Turnitin 也明确写明,AI 报告不能作为对学生采取不利处分的唯一依据(Turnitin Guides,2026-03-18)。

- 低门槛初筛可以先用免费入口。Ahrefs 的免费检测器当前一次支持 2,048 个字符(Ahrefs AI Content Detector,2026-03-18);但中高风险场景至少要“第二个工具 + 人工复核 + 过程证据”一起看。

- 需要中文、多语言和 API 工作流,优先看 Copyleaks、Originality.ai、Winston AI。Copyleaks 官方写明支持 30+ 语言含简繁中文(Copyleaks AI Detector,2026-03-18),Originality.ai 的多语言检测也覆盖 30 种语言含简繁中文(Originality.ai Help,2026-03-18)。

- 学生或作者需要自证写作过程时,GPTZero 的 Writing Replay 比“再跑一次检测”更有用,因为它是过程证据,不是单一概率值(GPTZero Students,2026-03-18)。

- 如果你的目标是 SEO,不要把“通过检测器”当成终点。更可靠的做法是补充来源、案例、判断和编辑痕迹,让内容对读者更有帮助。

先别问哪款最准,先问这个分数能不能用

AI 检测工具最容易被误用的地方,是把一个概率分数当成事实判断。现实里,同样一篇文章换一个工具、换一种语言、换一个片段长度,结果都可能明显变化。原因不是某一款产品“完全没用”,而是它们本来就更像筛查器,而不是司法级证据系统。

这也是为什么两家最关键的官方信号,应该放在任何工具比较之前。第一,Google 公开强调,搜索系统关注的是内容是否原创、有帮助、令人满意,而不是内容是否由 AI 参与生产(Google Search Central,2026-03-18)。第二,Turnitin 在自己的 AI 写作报告说明里明确写明,模型可能误判,AI 报告不能作为对学生采取不利处分的唯一依据;同时 Turnitin 现在不再显示 0% 到 19% 的数值,因为这个区间更容易出现误报(Turnitin Guides,2026-03-18)。

把这两条信息放在一起看,结论就很直接了:你需要的不是“一个最准的工具”,而是“一个和风险等级相匹配的流程”。如果只是快速判断一篇营销稿是否值得人工复看,免费筛查器可能够用。如果是课程作业、毕业论文、期刊投稿或外包稿件验收,单一分数本身就不够。

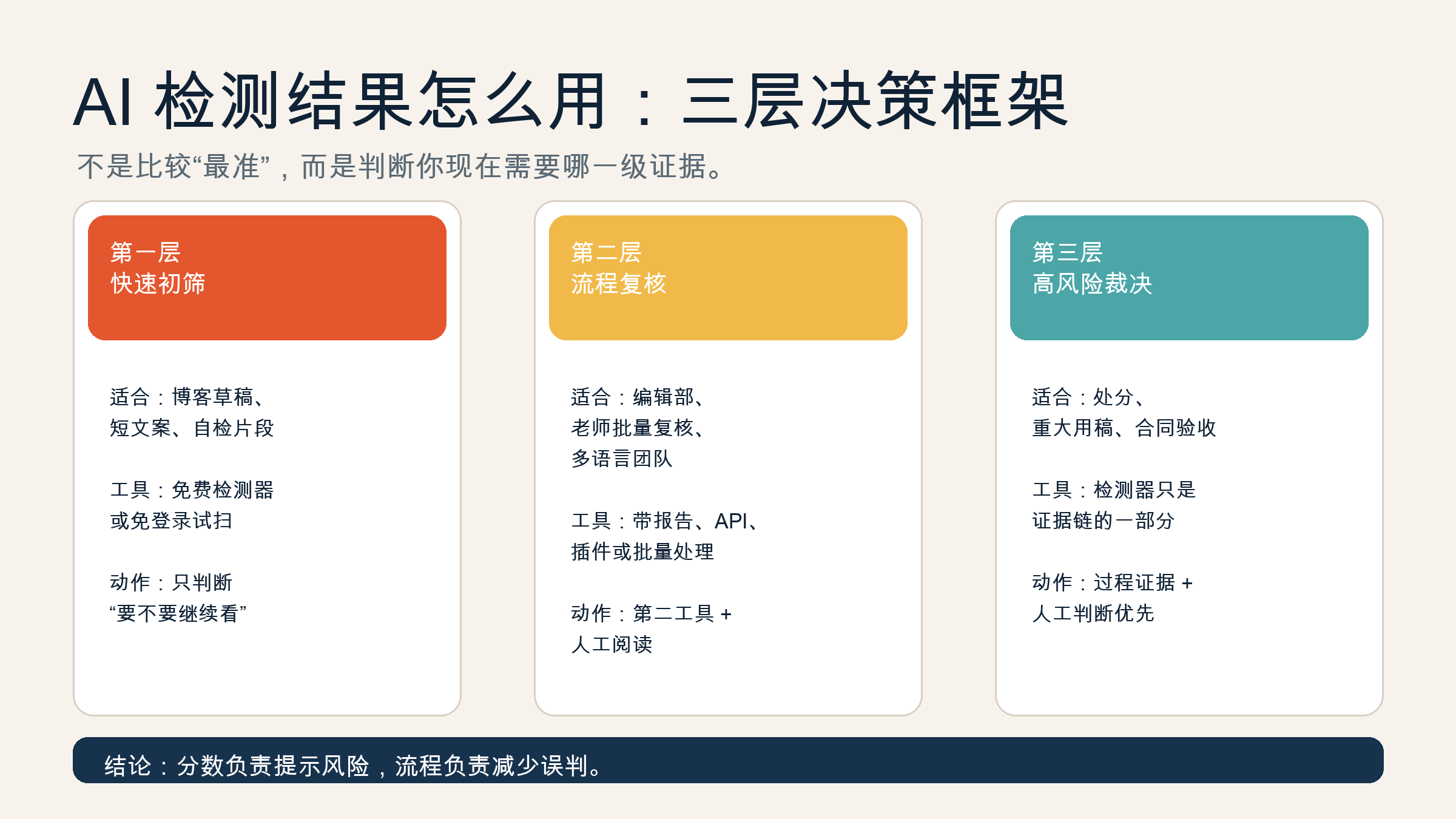

AI 检测结果怎么用:三层决策框架

下面这张框架图,是这次更新最重要的部分。它不是在回答“谁排第一”,而是在回答“你现在应该怎么做”。

| 决策层 | 适用场景 | 推荐工具类型 | 你该怎么做 |

|---|---|---|---|

| 第一层:快速初筛 | 博客草稿、自媒体稿件、自检一小段文本 | 免费检测器或免登录试扫 | 只把结果当“是否需要继续看”的信号,不直接下结论 |

| 第二层:流程复核 | 编辑部、内容团队、老师批量复核、多语言内容 | 有报告、批量处理、API 或插件的工具 | 至少结合第二个工具和人工阅读,记录为什么触发复核 |

| 第三层:高风险裁决 | 学术处分、重大用稿、合同验收、争议申诉 | 工具 + 人工 + 过程证据 | 分数不能单独决定结果,必须结合草稿历史、引用来源、版本记录和作者说明 |

如果你只想记一句话,可以这样理解:低风险看“要不要复看”,中风险看“要不要升级流程”,高风险看“证据链够不够”。这个顺序比“哪家官网写了 99%”更能减少误判。

2025 仍值得关注的 6 类方案,不按名次排,按任务排

与其做一个统一排行,不如按任务去选。下面这张表只保留当前能从官网直接核验的关键信息:免费入口、适用人群、多语言能力、工作流特征和定价模型。

| 工具/方案 | 更适合谁 | 当前可核验信息 | 我会怎么用 |

|---|---|---|---|

| Ahrefs AI Content Detector | 想先快速筛一段内容的人 | 免费;单次输入上限 2,048 个字符;支持 Analyze & Rewrite(Ahrefs AI Content Detector,2026-03-18) | 只做低风险初筛,不拿来做正式判断 |

| Copyleaks | 教育机构、企业内容审核、多语言团队 | 支持 30+ 语言含简繁中文;免登录可扫 25,000 个字符;Personal $16.99/月或年付 $13.99/月起(Copyleaks AI Detector / Pricing,2026-03-18) | 适合需要多语言、报告和 API 的团队流程 |

| GPTZero | 学生自检、老师课堂场景、需要过程证据的人 | 免费版每月 10,000 words;Writing Replay 可记录 Google Docs 写作过程;Premium $12.99/月 300,000 words(GPTZero Students / Turnitin vs GPTZero,2026-03-18) | 当“自证过程”比“再测一次”更重要时优先考虑 |

| Originality.ai | 发行团队、SEO 内容团队、站群/代理商 | Pay As You Go $30;Pro $14.95/月;Chrome 扩展、WordPress、Moodle、API;多语言检测支持 30 种语言含简繁中文(Originality.ai Pricing / Help,2026-03-18) | 适合把检测嵌进生产流程,而不是单篇临时判断 |

| Winston AI | 需要 OCR、PDF、团队分享的人 | 14 天试用含 2,000 credits;多语言含简体中文;支持 OCR、文档扫描、图片/手写识别、PDF 报告(Winston AI Pricing,2026-03-18) | 适合文件型工作流和要交报告的团队 |

| Turnitin AI Writing Report | 已部署院校或课程平台 | 官方明确提示不能作为唯一处分依据;300-30,000 words prose text 最合适;支持 English、Spanish、Japanese(Turnitin Guides,2026-03-18) | 只有在学校已有流程和申诉机制时才有价值 |

1. Ahrefs:免费初筛很方便,但别把它当判决器

Ahrefs 的优势很明确:你不需要先搭一整套流程,也不需要注册学校或团队账号。对于“这段 landing page 文案是不是太像模板”这类问题,它的速度和上手门槛很合适。官网当前写明输入上限是 2,048 个字符,还提供 Analyze & Rewrite 的轻量工作流(Ahrefs AI Content Detector,2026-03-18)。

但它更像体温计,不像化验单。输入太短、片段太碎、语言太混杂,都会让结果解释空间变大。所以我只会把 Ahrefs 放在第一层:它帮助你决定“要不要继续看”,不帮助你决定“这就是 AI 写的”。

2. Copyleaks:如果你要中文、多语言和团队流程,它是最稳的通用型选项之一

Copyleaks 这类工具的价值,不在于一句“准确率最高”,而在于它把团队真正需要的东西都打包了:多语言、可分享结果、API、以及相对明确的商业入口。官网当前写明它支持 30+ 语言,包含简体和繁体中文,同时允许免登录扫描 25,000 个字符(Copyleaks AI Detector,2026-03-18)。对于需要先试后买的团队,这个门槛相对友好。

如果你已经确定会把检测放进内容工作流,而不是偶尔查一篇稿件,Copyleaks 比单纯免费工具更像一套可扩展方案。它的问题在于成本和流程复杂度也随之上升,所以不太适合“我今天就想临时测一篇短文”的个人场景。

3. GPTZero:真正有价值的不是分数,而是 Writing Replay

很多人把 GPTZero 当成“学生版检测器”,但我认为它最有差异化的地方其实不是分数,而是过程证据。GPTZero 当前对学生页写得很清楚:免费计划每月可以扫描 10,000 个单词;如果你在 Google Docs 里写作,还可以用 Writing Replay 保存写作过程(GPTZero Students,2026-03-18)。

这点非常关键。因为在老师、学生和作者之间真正能减少争议的,往往不是再跑一遍第二个检测器,而是拿出草稿演变、修改轨迹、来源记录。GPTZero 也在自己的对比页里写明其付费档位和多语言支持,包括中文(GPTZero Turnitin vs GPTZero,2026-03-18)。所以如果你的核心需求是“自证”而不是“筛别人”,GPTZero 的优先级会高于很多榜单里更花哨的产品。

4. Originality.ai:适合把检测塞进内容生产线里

如果你是编辑部、内容代理商或者 SEO 团队,Originality.ai 的重点不在于“我能不能测一次”,而在于“我能不能把它接进日常工作流”。官网当前公开的定价模型很清楚:一次性 Pay As You Go 是 $30,Pro 为 $14.95/月,企业方案更高;同时它提供 Chrome 扩展、WordPress 插件、Moodle 插件和 API(Originality.ai Pricing,2026-03-18)。

这意味着它天然适合“多作者、多轮审核、多站点发布”的团队。再加上其多语言检测页明确写到支持 30 种语言,包含简体与繁体中文(Originality.ai Help,2026-03-18),它对跨语言内容团队比很多英文导向工具更友好。它不一定是每个个人作者都需要的产品,但对“检测就是流程环节之一”的组织来说,性价比反而更高。

5. Winston AI:文件型工作流、OCR 和报告交付是它的强项

Winston AI 的官网定价页给出的信息很直接:它有 14 天、2,000 credits 的免费试用,付费版本按月提供更高 credits;更重要的是它明确把 OCR、文档扫描、图片/手写识别、PDF 报告这些能力放进了卖点列表(Winston AI Pricing,2026-03-18)。

这让它很适合处理 Word、PDF、截图、扫描件这类非纯文本输入的团队。如果你的日常不是复制一段正文到网页里,而是收稿、审稿、归档、导出报告,Winston 这种带文件工作流的工具往往比轻量网页检测器更顺手。官网同时写明它的多语言检测包含简体中文(Winston AI Pricing,2026-03-18),这一点对中文团队也有现实价值。

6. Turnitin:它的重要性不在“最准”,而在“制度位置”

Turnitin 经常被当成“学术场景的答案”,但它真正的地位来自制度嵌入,而不是单篇判断神奇。院校如果已经把 Turnitin 接进 LMS、课程政策和申诉流程里,它确实能成为复核的一部分。可同样重要的是,Turnitin 官方也反复提醒:AI 报告不能作为唯一处分依据,而且 0% 到 19% 的分值区间干脆不再显示,因为误报风险更高(Turnitin Guides,2026-03-18)。

所以我会把 Turnitin 放在第三层。它适合已经有制度、有记录、有申诉机制的环境,不适合被拿来做一次性定性的锤子。

哪些文本最容易让检测器失真

很多人把误判理解成“这个工具不准”,但更准确的说法是:有些文本类型天生就不适合被直接拿来跑一个概率值。只要你先知道哪些场景最容易失真,很多争议其实在上工具之前就能避免。

1. 太短的文本,本来就缺少稳定信号

几十字到几百字的简介、社媒文案、邮件回信、提纲式段落,本身就没有足够上下文给模型判断。Ahrefs 当前也只提供 2,048 字符的轻量入口(Ahrefs AI Content Detector,2026-03-18),这类工具很适合“先扫一眼”,但越短的文本,越不适合拿结果做强结论。对短文本而言,你更应该看它是否模板化、是否空泛,而不是执着于一个百分比。

2. 引用多、格式重的文本,容易把“规范”误当成“像 AI”

学术摘要、文献综述、行业白皮书、法务函件、产品规格说明,本来就会大量使用固定表达和稳定结构。Turnitin 官方直接列出了它不适合稳定判断的类型,包括脚本、代码、简短项目符号式写作和带注释书目(Turnitin Guides,2026-03-18)。这意味着如果你的输入里有大量引用、列表、格式化块或参考文献,结果解释必须保守。

3. 中文夹英文术语、代码和品牌名,会明显放大波动

中文团队最常见的真实文本,不是纯中文,也不是纯英文,而是“中文叙述 + 英文产品名 + API 字段 + 代码片段 + 表格标题”的混合物。这类内容即便本来完全由人写,也很容易被工具识别成风格不自然。对这类文本,我更建议先分段复核:把核心论证段、引用段、说明段拆开看,而不是整篇丢进去期待一个万能结论。

4. 后期被重写过很多轮的 AI 协作稿,也会让工具互相打架

真正复杂的不是纯 AI 稿,而是“AI 起草 + 人工补事实 + 编辑重写 + 再次润色”的协作稿。它既不是传统意义上的纯人工,也不是纯机器产物,所以不同工具给出不一致结果反而是常态。遇到这种情况,最有价值的问题不是“到底谁最准”,而是“作者有没有保留足够的写作过程和来源证据”。这也是为什么我会把 GPTZero 的 Writing Replay 放在高于单点分数的位置。

不同角色怎么配工具和流程,效率最高

如果你只想要一句“该买哪个”,通常反而会买错。因为老师、编辑、作者和内容代理商承担的风险完全不同,工具只是流程的一部分。下面这组建议更适合作为采购和落地时的起点。

老师和教务

教学场景最怕的不是漏判,而是误伤。我的建议是把 Turnitin 或 GPTZero 放在“预警层”,而不是“处罚层”。先做初筛,再看人工复读,最后才看草稿历史、课堂表现和引用来源。只要流程设计成“高分即复核”,而不是“高分即定性”,争议会少很多。

编辑和内容负责人

编辑部真正需要的是留痕能力,而不是一页网页里的彩色标签。Originality.ai、Copyleaks 和 Winston AI 这类带插件、API、报告或文件扫描能力的产品更适合团队,因为它们能把检测融进收稿、复核、归档和回传作者修改意见的流程里。对编辑来说,最值钱的不是单次判断,而是“这篇稿为什么被打回”可以被解释和复现。

作者、学生和自由职业者

这类用户的核心诉求不是抓别人,而是保护自己。所以我会优先考虑能保留过程证据的方案,而不是只会给分数的方案。GPTZero 在这里的价值尤其明显,因为它把“我确实写过”变成可以展示的轨迹。哪怕你最后不用它做正式检测,保留写作过程本身也能大幅降低后续争议成本。

中文和多语言团队

如果你的工作流里经常出现中文正文、英文术语、国际客户材料和本地化改写稿,最需要的不是“一个英文向榜单冠军”,而是一个明确支持多语言、并且能在团队里稳定复用的方案。Copyleaks、Originality.ai、Winston AI 都比单纯免费检测页更符合这种环境,因为它们公开写清楚了多语言覆盖和工作流能力,采购时更容易做出可解释的选择。

中文和多语言内容,别再照搬英文榜单

中文场景里,很多英文榜单的可参考价值其实有限。问题不只是“中文支持得好不好”,而是多语言混写、引用格式、行业术语、短段落、翻译痕迹这些变量会同时影响结果解释。尤其是公司内部稿件、留学申请、自媒体脚本和研究摘要,经常天然就不是纯英文长文,这时很多“最准榜单”的前提已经变了。

从当前官网能直接核验的信息看,Copyleaks、Originality.ai 和 Winston AI 都明确把简体中文放进支持范围;GPTZero 也在自己的对比页写明支持 Chinese(相关官方页均核验于 2026-03-18)。如果你的内容经常出现中文正文里夹英文术语、代码、产品名、表格和引用,我更建议从这些工具里选,而不是只看一个英文向免费检测器的分数。

更现实的一点是,中文内容里“像 AI”的特征经常和“像公文”“像品牌白皮书”“像学术摘要”重叠。也就是说,被打高分并不一定意味着文本来自 AI;它也可能只是过于模板化、过于平直、过于统一。对中文作者来说,这反而说明后续编辑应该优先补证据、补案例、补作者立场,而不是疯狂改同义词。

如果被打出高 AI 分数,正确复核流程是什么

这部分是我认为当前大多数文章都写得不够的地方。无论你是老师、作者还是编辑,只要你把下面这套流程建立起来,误伤概率就会明显下降。

第一步,先看文本类型,而不是先看分数。短文本、提纲、代码、脚本、带大量引用或项目符号的文本,本来就不是很多检测器最稳定的输入类型。Turnitin 官方甚至明确列出,它不适合检测诗歌、脚本、代码、简短项目符号式写作和带注释书目(Turnitin Guides,2026-03-18)。如果输入类型先天不稳,任何高分都要打折解释。

第二步,看是否值得上第二个工具。如果这是低风险稿件,初筛高分只意味着“值得人工多看两眼”。如果这是中高风险稿件,就应该换一个不同定位的工具复核,例如把轻量网页检测器换成带报告和多语言支持的产品。你不是在追求“多数票”,而是在观察不同模型对同一文本是否都给出一致风险信号。

第三步,回到人工阅读。真正会引发人工怀疑的,通常不是一个百分比,而是整篇文章缺乏具体来源、没有个人判断、所有段落都同样平、案例空泛、语气始终一致。这些信号和读者价值也直接相关,所以人工复核本身并不是额外成本,它本来就是内容质量判断的一部分。

第四步,要求过程证据,而不是口头解释。如果是学生、作者或 freelancer 需要自证,最有力的材料通常包括:Google Docs 或 Word 版本记录、研究笔记、采访记录、引用来源列表、草稿到成稿的迭代痕迹。GPTZero 的 Writing Replay 值得一提,正是因为它把“我真的写过”变成可展示的过程记录(GPTZero Students,2026-03-18)。

第五步,只有当工具结果、人工阅读和过程证据三者一致时,才值得升级成正式结论。这个顺序看起来慢,但比“单一高分就拒稿或处分”要安全得多,也更公平。

实务建议

如果你负责团队审核,可以把高分内容先分成两类:一类是“需要人工复看”,另一类是“需要作者补交过程证据”。不要把检测器直接嵌成自动拒稿规则,这样最容易误伤真正写过的人。

想降低 AI 痕迹,别把目标设成“骗过检测器”

很多旧文章都会教你怎么“躲过检测”,但如果你的真实目标是发表、过稿、过审或建立可信度,这个方向其实很短视。因为 Google 看的不是你有没有躲开检测器,而是内容是否真的有帮助(Google Search Central,2026-03-18);编辑和老师在高风险场景里,最后也会回到人工阅读。

更有效的做法,是把文章改成“更像你写的”,而不是“更像某个工具检测不到的样子”。最直接的办法通常有四个。第一,补具体来源,让关键结论有出处。第二,补个人判断,说明你为什么推荐 A 而不是 B。第三,补情境细节,例如这条建议更适合老师、代理商还是自由作者。第四,补编辑痕迹,让段落结构和重点分配真正围绕问题展开,而不是所有段落都一样整齐。

如果你本来就在用 AI 起草,建议把“人工增值”放在三个位置:开头两段、所有决策建议段、以及结论。因为这些地方最能体现作者判断,也最容易让读者看出这篇内容到底有没有经历过真正的编辑。需要系统化改写方法,可以继续看AI 创作人性化指南,但前提仍然不是“绕过工具”,而是提升内容对人类读者的可信度和可用度。

常见问题解答

AI 检测工具能不能判断一篇文章是不是 AI 写的?

不能把它理解成“法官判决”。更准确的说法是:它们提供的是风险信号,而不是终局证据。Turnitin 自己都明确写明不能把 AI 报告当成唯一处分依据(Turnitin Guides,2026-03-18),这已经足够说明问题。对于低风险内容,它们很有用;对于高风险决定,它们必须放进更完整的复核流程里。

免费工具够不够用?

够不够用,取决于后果大小。你只是想筛一下网页文案、博客段落或外包稿件里一小段可疑文本,Ahrefs 这类免费入口已经够用。你一旦需要批量、报告、插件、多语言或申诉记录,免费工具很快就不够,因为它们缺少的是工作流,而不是“再多一个分数”。

中文内容是不是更容易被误判?

很多时候是的,但原因不一定是“中文一定更差”,而是中文场景更常见混合输入:中文正文里夹英文术语、品牌名、引用、表格、脚本、提示词、代码片段。再加上中文商务写作、学术写作本来就更容易模板化,工具会把“风格很统一”误读成“像 AI”。所以中文场景里,支持范围明确的多语言工具通常比英文向轻量工具更稳。

我是老师,最稳妥的做法是什么?

先把检测器当成分流器,而不是证据本身。实际操作上,可以先让系统做初筛,再把高风险文本交给人工复看;如果仍有疑问,再要求学生补交草稿历史、版本记录、引用来源或现场口头说明。这样做比“看到高分直接处理”更慢一点,但能明显减少误伤。

我是内容团队负责人,应该优先买哪类工具?

如果你管的是多人协作、发布频繁、需要留下审核记录的内容团队,我更看重插件、API、批量处理、导出报告和多语言覆盖,而不是一个单独的“准确率宣传语”。也就是说,Originality.ai、Copyleaks、Winston 这类能塞进工作流的产品,往往比纯网页检测页更有投资价值。

SEO 会不会因为文章被判成 AI 内容而直接受影响?

没有证据表明“被某个第三方检测器判成 AI”本身会让 Google 直接降权。Google 公开强调的是内容质量、原创性和是否真正帮助用户,而不是生产方式(Google Search Central,2026-03-18)。如果一篇文章被很多检测器打高分,同时又缺来源、缺案例、缺判断,那真正的问题通常不是“它像 AI”,而是“它确实不够好”。

结论

这次更新之后,我对“AI 内容检测工具怎么选”的结论比旧稿更简单:先别迷信排行榜,也别迷信单一分数。先判断你面对的是低风险初筛、中风险流程复核,还是高风险裁决,再去选对应的工具和证据链。

如果你只想找一句最实用的建议,那就是这句:检测器负责告诉你“哪里值得再看一眼”,真正决定结果的,永远还是人工判断、过程证据和内容本身的质量。把这个顺序搞对了,工具才会帮你省时间;顺序搞反了,再贵的工具也只是把误判流程自动化。