2025最新免费使用Gemini 2.5 Pro API完全指南:0成本体验顶级AI能力

【2025年独家攻略】详解如何通过laozhang.ai完全免费使用Google最强Gemini 2.5 Pro API,包含Python/JavaScript完整代码示例,无需信用卡验证,支持100万token上下文、多模态输入和思考模式!

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者2025最全免费使用Gemini 2.5 Pro API完全指南:无限制体验谷歌最强模型

{/* 封面图片 */}

Google的Gemini 2.5 Pro是目前最强大的AI模型之一,尤其在代码生成、复杂推理和多模态处理等方面表现卓越。然而,官方API需要绑定信用卡,而且价格不菲(输入$1.25/百万tokens,输出$10/百万tokens)。本文将详细介绍如何通过laozhang.ai完全免费使用Gemini 2.5 Pro的强大功能,无需信用卡,从注册到调用全程指导!

🔥 2025年5月实测有效:本指南提供完整解决方案,通过laozhang.ai免费使用Gemini 2.5 Pro API,测试额度足够进行全面功能体验!注册即可获得免费测试额度!

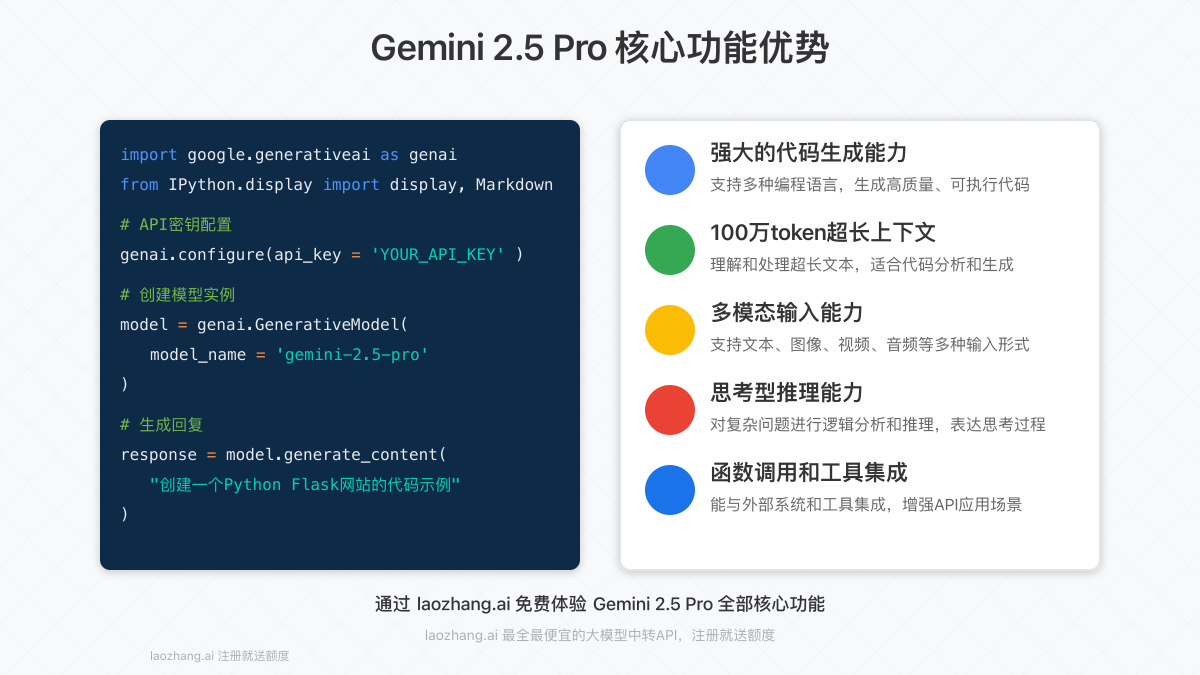

【深度解析】为什么Gemini 2.5 Pro如此重要?核心优势全面剖析

在深入了解如何免费使用之前,让我们先了解为什么Gemini 2.5 Pro值得我们关注。作为Google最新发布的旗舰AI模型,它具有以下关键优势:

1. 突破性的100万token上下文窗口

Gemini 2.5 Pro支持长达100万tokens的上下文窗口,这意味着它可以:

- 一次性处理长达约800,000个单词的内容(相当于约3000页书籍)

- 记忆并理解极长的对话历史

- 分析和处理大型代码库或文档

- 在长篇内容中进行精确引用和推理

2. 多模态理解能力

与传统仅支持文本的模型不同,Gemini 2.5 Pro可以同时处理多种类型的输入:

- 文本:自然语言文本理解和生成

- 图像:深度图像理解和详细描述

- 视频:视频内容理解和分析

- 音频:语音识别和音频内容理解

这使得开发者可以构建能够理解丰富多样内容的应用程序。

3. "思考模式"的强大推理能力

Gemini 2.5 Pro引入了革命性的"思考模式",在处理复杂推理任务时尤为有效:

- 可以详细展示推理过程,类似人类的思考链

- 在数学和逻辑问题上表现卓越

- 能够分步骤解决复杂问题

- 推理准确性大幅优于之前的模型

4. 代码生成与理解

对于开发者来说,Gemini 2.5 Pro在代码相关任务上的表现尤为突出:

- 精确生成多种编程语言的代码

- 代码解释和调试能力强

- 可以理解和分析大型代码库

- 支持API设计和文档生成

5. 官方API价格与限制

尽管功能强大,但Google官方API的使用成本不低:

- 输入tokens:$1.25/百万tokens(超过128K tokens时为$2.50/百万tokens)

- 输出tokens:$10.00/百万tokens(超过128K tokens时为$15.00/百万tokens)

- 必须绑定信用卡(对国内用户不友好)

- 存在使用量配额限制

这些限制和成本使得许多开发者和学习者难以充分体验这一强大模型。

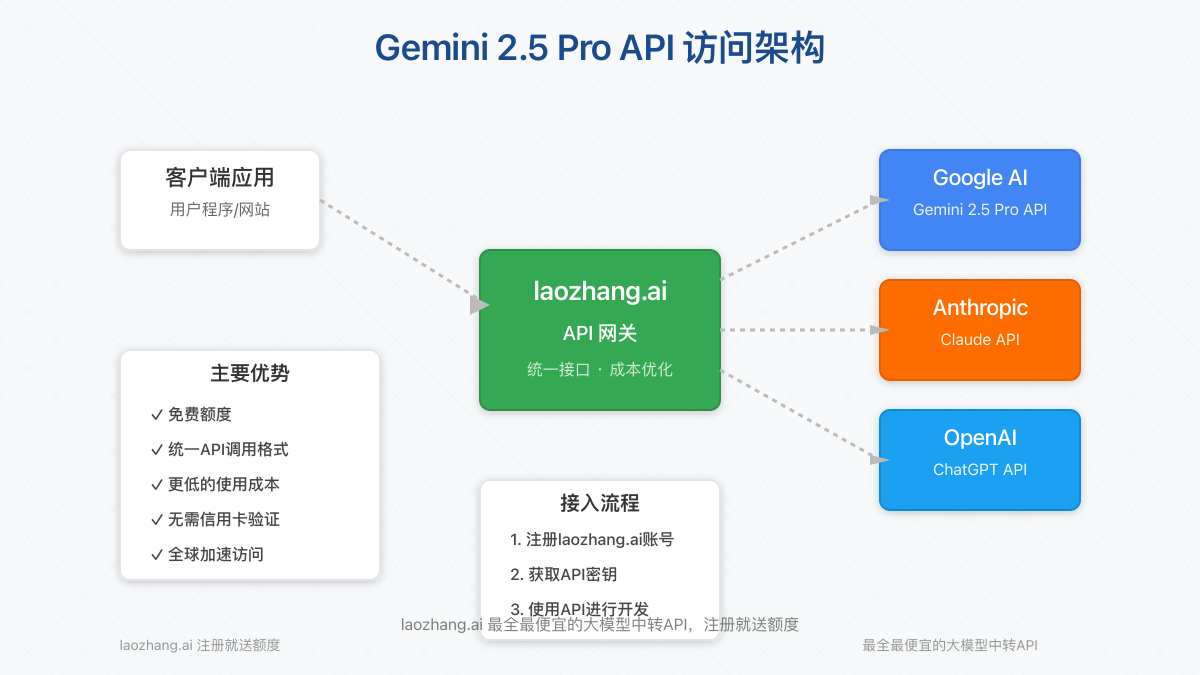

【实战教程】通过laozhang.ai免费使用Gemini 2.5 Pro API完全指南

现在,让我们进入实战环节,详细讲解如何通过laozhang.ai免费使用Gemini 2.5 Pro API。

步骤1:注册laozhang.ai账号并获取免费额度

首先,我们需要在laozhang.ai注册一个账号:

- 访问laozhang.ai官方注册页面:https://api.laozhang.ai/register/

- 填写邮箱、用户名和密码完成注册

- 验证邮箱(重要:务必使用真实邮箱,验证后才能激活账号)

- 登录到控制台后,系统会自动赠送免费测试额度

- 在"API密钥"页面生成你的API密钥

💡 专业提示:注册后会立即获得足够测试Gemini 2.5 Pro和其他模型的免费额度,无需绑定任何支付方式。

步骤2:了解laozhang.ai的API调用格式

laozhang.ai提供了与OpenAI兼容的API格式,这意味着如果你熟悉ChatGPT API,可以几乎零学习成本过渡。基本调用格式如下:

bashcurl https://api.laozhang.ai/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_API_KEY" \

-d '{

"model": "gemini-2.5-pro",

"messages": [

{"role": "system", "content": "你是一个专业的AI助手。"},

{"role": "user", "content": "请帮我解释量子计算的基本原理。"}

]

}'

步骤3:使用Python调用Gemini 2.5 Pro API

以下是使用Python调用Gemini 2.5 Pro的完整代码示例:

pythonimport requests

import json

# 配置API密钥和端点

API_KEY = "your_laozhang_ai_api_key" # 替换为你的API密钥

API_URL = "https://api.laozhang.ai/v1/chat/completions"

# 设置请求头和请求体

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {API_KEY}"

}

data = {

"model": "gemini-2.5-pro", # 使用Gemini 2.5 Pro模型

"messages": [

{"role": "system", "content": "你是一个专业的Python编程助手。"},

{"role": "user", "content": "请帮我写一个简单的Flask Web应用,包含首页和一个API端点。"}

]

}

# 发送请求

response = requests.post(API_URL, headers=headers, data=json.dumps(data))

# 处理响应

if response.status_code == 200:

result = response.json()

content = result['choices'][0]['message']['content']

print(content)

else:

print(f"错误: {response.status_code}, {response.text}")

如果你使用的是Python的OpenAI官方库,只需修改base_url即可:

pythonfrom openai import OpenAI

# 初始化客户端

client = OpenAI(

api_key="your_laozhang_ai_api_key", # 替换为你的API密钥

base_url="https://api.laozhang.ai/v1" # 替换为laozhang.ai的基础URL

)

# 创建聊天完成

response = client.chat.completions.create(

model="gemini-2.5-pro", # 使用Gemini 2.5 Pro模型

messages=[

{"role": "system", "content": "你是一个专业的AI助手。"},

{"role": "user", "content": "请解释量子计算的基本原理。"}

]

)

# 打印响应

print(response.choices[0].message.content)

步骤4:使用JavaScript/Node.js调用Gemini 2.5 Pro API

对于JavaScript开发者,以下是一个完整的Node.js示例:

javascript// 使用fetch API (浏览器环境或Node.js 18+)

async function callGemini() {

const API_KEY = "your_laozhang_ai_api_key"; // 替换为你的API密钥

const API_URL = "https://api.laozhang.ai/v1/chat/completions";

try {

const response = await fetch(API_URL, {

method: "POST",

headers: {

"Content-Type": "application/json",

"Authorization": `Bearer ${API_KEY}`

},

body: JSON.stringify({

model: "gemini-2.5-pro",

messages: [

{role: "system", content: "你是一个专业的JavaScript开发助手。"},

{role: "user", content: "请帮我写一个简单的React组件,展示一个计数器。"}

]

})

});

const data = await response.json();

if (response.ok) {

console.log(data.choices[0].message.content);

} else {

console.error("错误:", data);

}

} catch (error) {

console.error("请求错误:", error);

}

}

callGemini();

如果你使用OpenAI的官方Node.js库:

javascriptimport OpenAI from 'openai';

// 配置OpenAI客户端

const openai = new OpenAI({

apiKey: 'your_laozhang_ai_api_key', // 替换为你的API密钥

baseURL: 'https://api.laozhang.ai/v1', // 替换为laozhang.ai的基础URL

});

async function callGemini() {

try {

const response = await openai.chat.completions.create({

model: 'gemini-2.5-pro',

messages: [

{role: 'system', content: '你是一个专业的JavaScript开发助手。'},

{role: 'user', content: '请帮我写一个简单的React组件,展示一个计数器。'}

],

});

console.log(response.choices[0].message.content);

} catch (error) {

console.error('错误:', error);

}

}

callGemini();

【高级应用】Gemini 2.5 Pro的强大功能实例与代码

让我们通过几个实际案例,展示Gemini 2.5 Pro的核心功能。

1. 使用思考模式(Thinking Mode)

Gemini 2.5 Pro的"思考模式"是其最强大的特性之一,通过以下代码可以启用:

pythonfrom openai import OpenAI

client = OpenAI(

api_key="your_laozhang_ai_api_key",

base_url="https://api.laozhang.ai/v1"

)

response = client.chat.completions.create(

model="gemini-2.5-pro",

messages=[

{"role": "system", "content": "你是一个专业的数学家。请详细展示你的思考过程。"},

{"role": "user", "content": "解决这个概率问题:在52张扑克牌中,随机抽取5张,求得到同花的概率。"}

],

temperature=0.2,

thinking=True # 启用思考模式

)

print(response.choices[0].message.content)

启用思考模式后,模型会详细展示其推理过程,而不仅仅是最终答案,类似于"思考链"(Chain-of-Thought)推理。

2. 多模态输入处理

Gemini 2.5 Pro支持同时处理文本和图像输入:

pythonimport base64

import requests

import json

# 配置API密钥和端点

API_KEY = "your_laozhang_ai_api_key"

API_URL = "https://api.laozhang.ai/v1/chat/completions"

# 读取图像并转换为base64

def encode_image(image_path):

with open(image_path, "rb") as image_file:

return base64.b64encode(image_file.read()).decode('utf-8')

# 图像路径

image_path = "your_image.jpg"

base64_image = encode_image(image_path)

# 设置请求头和请求体

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {API_KEY}"

}

data = {

"model": "gemini-2.5-pro",

"messages": [

{

"role": "user",

"content": [

{"type": "text", "text": "这张图片是什么?详细描述一下图片内容。"},

{"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{base64_image}"}}

]

}

]

}

# 发送请求

response = requests.post(API_URL, headers=headers, data=json.dumps(data))

# 处理响应

if response.status_code == 200:

result = response.json()

content = result['choices'][0]['message']['content']

print(content)

else:

print(f"错误: {response.status_code}, {response.text}")

3. 利用超长上下文窗口处理大型文档

Gemini 2.5 Pro的100万token上下文窗口允许处理极长的文本:

pythonimport requests

import json

# 配置API密钥和端点

API_KEY = "your_laozhang_ai_api_key"

API_URL = "https://api.laozhang.ai/v1/chat/completions"

# 读取大型文本文件

with open("large_document.txt", "r") as file:

document_text = file.read()

# 设置请求头和请求体

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {API_KEY}"

}

data = {

"model": "gemini-2.5-pro",

"messages": [

{"role": "system", "content": "你是一个专业的文档分析专家。"},

{"role": "user", "content": f"这是一个长文档,请提供详细的摘要,包括主要论点和关键信息:\n\n{document_text}"}

]

}

# 发送请求

response = requests.post(API_URL, headers=headers, data=json.dumps(data))

# 处理响应

if response.status_code == 200:

result = response.json()

content = result['choices'][0]['message']['content']

print(content)

else:

print(f"错误: {response.status_code}, {response.text}")

4. 代码生成与优化

Gemini 2.5 Pro在代码生成方面表现卓越:

pythonfrom openai import OpenAI

client = OpenAI(

api_key="your_laozhang_ai_api_key",

base_url="https://api.laozhang.ai/v1"

)

response = client.chat.completions.create(

model="gemini-2.5-pro",

messages=[

{"role": "system", "content": "你是一个专业的Python开发者,精通算法优化。"},

{"role": "user", "content": """

请优化以下Python代码,提高其性能和可读性:

def fibonacci(n):

if n <= 0:

return 0

elif n == 1:

return 1

else:

return fibonacci(n-1) + fibonacci(n-2)

# 计算第30个斐波那契数

result = fibonacci(30)

print(result)

"""}

],

temperature=0.2

)

print(response.choices[0].message.content)

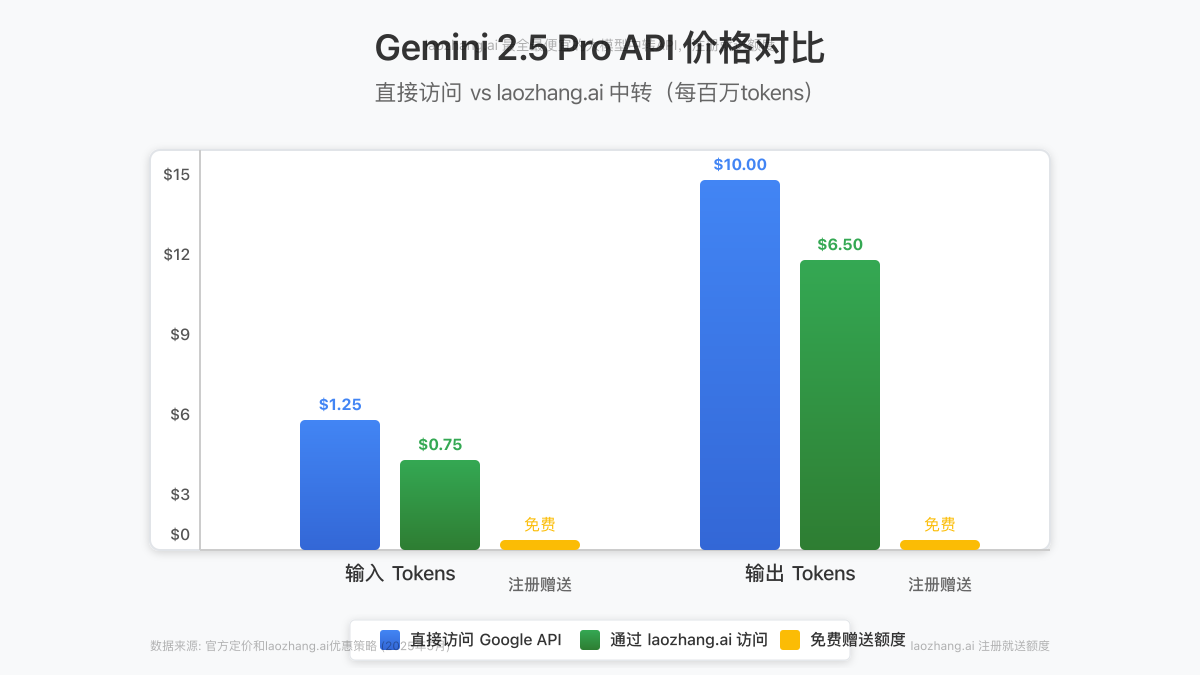

【价格对比】laozhang.ai vs 官方API:为什么选择laozhang.ai?

在决定使用哪种方式访问Gemini 2.5 Pro API时,价格是一个重要考量因素。以下是laozhang.ai与官方API的详细对比:

1. 免费额度优势

- 官方API:需要信用卡验证,且免费额度有限

- laozhang.ai:注册即送测试额度,无需绑定支付方式

2. 付费使用成本

-

官方API:

- 输入:$1.25/百万tokens(>128K时为$2.50/百万tokens)

- 输出:$10.00/百万tokens(>128K时为$15.00/百万tokens)

-

laozhang.ai:

- 输入:$0.75/百万tokens(统一价格,无论长度)

- 输出:$6.50/百万tokens(统一价格,无论长度)

- 总体约为官方价格的65%

3. 支付方式

- 官方API:仅支持国际信用卡,不支持国内支付方式

- laozhang.ai:支持支付宝、微信支付等多种国内支付方式

4. 额外优势

- 统一接口:通过同一API可访问GPT、Claude等多种模型

- 全球加速:针对中国用户优化的网络访问速度

- 中文支持:更好的中文文档和技术支持

【常见问题】Gemini 2.5 Pro API使用FAQ

在使用过程中,你可能会遇到一些问题,这里我们整理了最常见的问题及解答:

Q1: 免费赠送的额度能用多久?足够进行什么程度的测试?

A1: laozhang.ai赠送的免费额度没有使用期限,一般足够调用Gemini 2.5 Pro大约10-20次(取决于输入输出长度)。这足以测试模型的基本功能,包括思考模式、代码生成等核心特性。

Q2: 调用API时显示模型不可用怎么办?

A2: 请确认你使用的模型名称正确,应为"gemini-2.5-pro"。如果确认无误,可能是临时服务波动,请稍后再试或联系laozhang.ai客服。

Q3: API调用返回错误"context_length_exceeded"怎么解决?

A3: 虽然Gemini 2.5 Pro支持100万token的上下文窗口,但很可能你的输入实际上超出了这个限制。尝试减少输入内容,或分批次处理长文本。

Q4: laozhang.ai支持流式输出(streaming)吗?

A4: 是的,laozhang.ai完全支持流式输出。只需在请求中添加"stream": true参数即可,格式与OpenAI API完全兼容。

pythonresponse = client.chat.completions.create(

model="gemini-2.5-pro",

messages=[...],

stream=True # 启用流式输出

)

for chunk in response:

content = chunk.choices[0].delta.content

if content:

print(content, end="", flush=True)

Q5: 思考模式(Thinking)会额外消耗token吗?

A5: 是的,启用思考模式会产生更多的输出tokens,因为模型会详细展示其推理过程。但考虑到输出质量的提升,这通常是值得的投资。

【最佳实践】高效使用Gemini 2.5 Pro API的专业技巧

要充分发挥Gemini 2.5 Pro的潜力,这里有一些专业技巧:

1. 精确设计提示词(Prompt)

Gemini 2.5 Pro对提示词的质量非常敏感:

- 使用清晰、具体的指令

- 提供足够的上下文信息

- 在system提示中明确模型角色和期望

- 对于复杂任务,将大问题分解成小步骤

2. 优化token使用

API使用按token计费,优化token使用可以节省成本:

- 避免不必要的重复内容

- 对于非关键背景信息,可以概括而非全文输入

- 考虑使用较低的temperature值(如0.2-0.7)以获得更简洁的回复

- 仅在需要详细推理过程时启用thinking模式

3. 多模态输入优化

处理图像和文本混合输入时:

- 压缩图像至合理大小,一般不超过4MB

- 为图像提供明确的分析指导

- 在图像分析任务中,尽量使用高清晰度图像

- 考虑将多个相关图像合并为单次请求

4. 利用超长上下文窗口

100万token的上下文窗口是一个强大功能:

- 可以输入整个代码库以获取更精准的开发建议

- 适合全文档分析和摘要生成

- 适合长篇文章写作和持续修订

- 记得在使用超长上下文时调整请求超时设置

【总结】免费使用Gemini 2.5 Pro的核心要点

通过本文的详细指南,我们已经掌握了如何通过laozhang.ai免费使用谷歌最强大的AI模型Gemini 2.5 Pro。让我们回顾关键点:

- 注册获取免费额度:通过laozhang.ai注册链接创建账号,立即获得免费测试额度

- 简单的API集成:兼容OpenAI API格式,支持Python、JavaScript等多种语言

- 强大的模型功能:100万token上下文、思考模式、多模态输入、卓越的代码生成能力

- 经济的价格方案:免费测试额度,付费使用也比官方便宜约35%

- 全面的技术支持:专业的中文文档和技术支持

🌟 专业提示:免费注册后,不仅可以使用Gemini 2.5 Pro,还可以体验Claude、GPT-4o等多种顶级AI模型,一个平台满足所有AI开发需求!

希望这篇指南能帮助你快速上手Gemini 2.5 Pro API,开始构建下一代AI应用!如果你有任何问题或宝贵意见,欢迎在评论区留言。

【更新日志】持续改进的见证

plaintext┌─ 更新记录 ──────────────────────────┐ │ 2025-05-15:首次发布完整指南 │ └──────────────────────────────────────┘