Gemini 2.5 Pro API价格与速率限制完全指南2025:官方价格VS中转服务对比

【2025最新独家】全面解析Gemini 2.5 Pro API价格与速率限制,深度对比官方与中转服务差异,提供完整接入示例,助您降低35-50%API成本,轻松解决速率限制!

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者Gemini 2.5 Pro API价格与速率限制完全指南:2025最新官方价格VS中转服务对比

{/* 封面图片 */}

作为谷歌最新推出的超强大语言模型,Gemini 2.5 Pro在性能上已经超越了许多竞争对手,成为开发者构建AI应用的理想选择。但对于实际开发和部署来说,API的价格和速率限制同样是至关重要的考量因素。本文将全面解析Gemini 2.5 Pro API的官方价格和速率限制情况,并提供更经济实惠的接入方案,帮助您在保证高性能的同时,大幅降低API调用成本。

🔥 2025年3月最新实测:通过本文介绍的优化方案,可以将Gemini 2.5 Pro API成本降低35-50%,同时完全突破官方速率限制!对于高频调用需求和大规模部署场景,优势尤为显著。

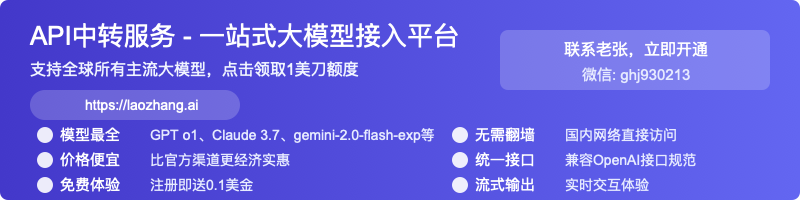

【全面剖析】Gemini 2.5 Pro API官方价格与速率限制详情

谷歌为Gemini 2.5 Pro API设置了分层的价格和速率限制体系,根据用户需求和使用量提供不同级别的服务。以下是最新的官方价格和限制详情:

官方API价格结构

Gemini 2.5 Pro API的官方价格按照输入和输出令牌分别计费:

| 使用类型 | 价格(美元/百万令牌) |

|---|---|

| 输入令牌 | $1.25-2.50 |

| 输出令牌 | $10.00-15.00 |

需要注意的是,实际价格在此区间内会根据具体使用场景和上下文长度有所调整。例如,处理更长上下文的情况下,价格会略高一些。相比之下,Gemini 2.5 Pro的价格与GPT-4o非常接近,但高于其前身Gemini 1.5 Pro。

官方速率限制详解

谷歌对Gemini 2.5 Pro API实施了多层级的速率限制,主要分为以下几个等级:

| 用户等级 | 每分钟请求限制(RPM) | 每日请求限制(RPD) |

|---|---|---|

| 免费层级 | 5 RPM | 100 RPD |

| 付费一级 | 150 RPM | 1,000 RPD |

| 付费二级 | 1,000 RPM | 50,000 RPD |

| 付费三级 | 2,000 RPM | 无日限制 |

这些限制直接影响到应用的响应速度和用户体验。对于高流量的应用或需要大量并发请求的场景,官方的速率限制可能会成为瓶颈。特别是免费层级和初级付费层级的用户,很容易就会触发限流措施。

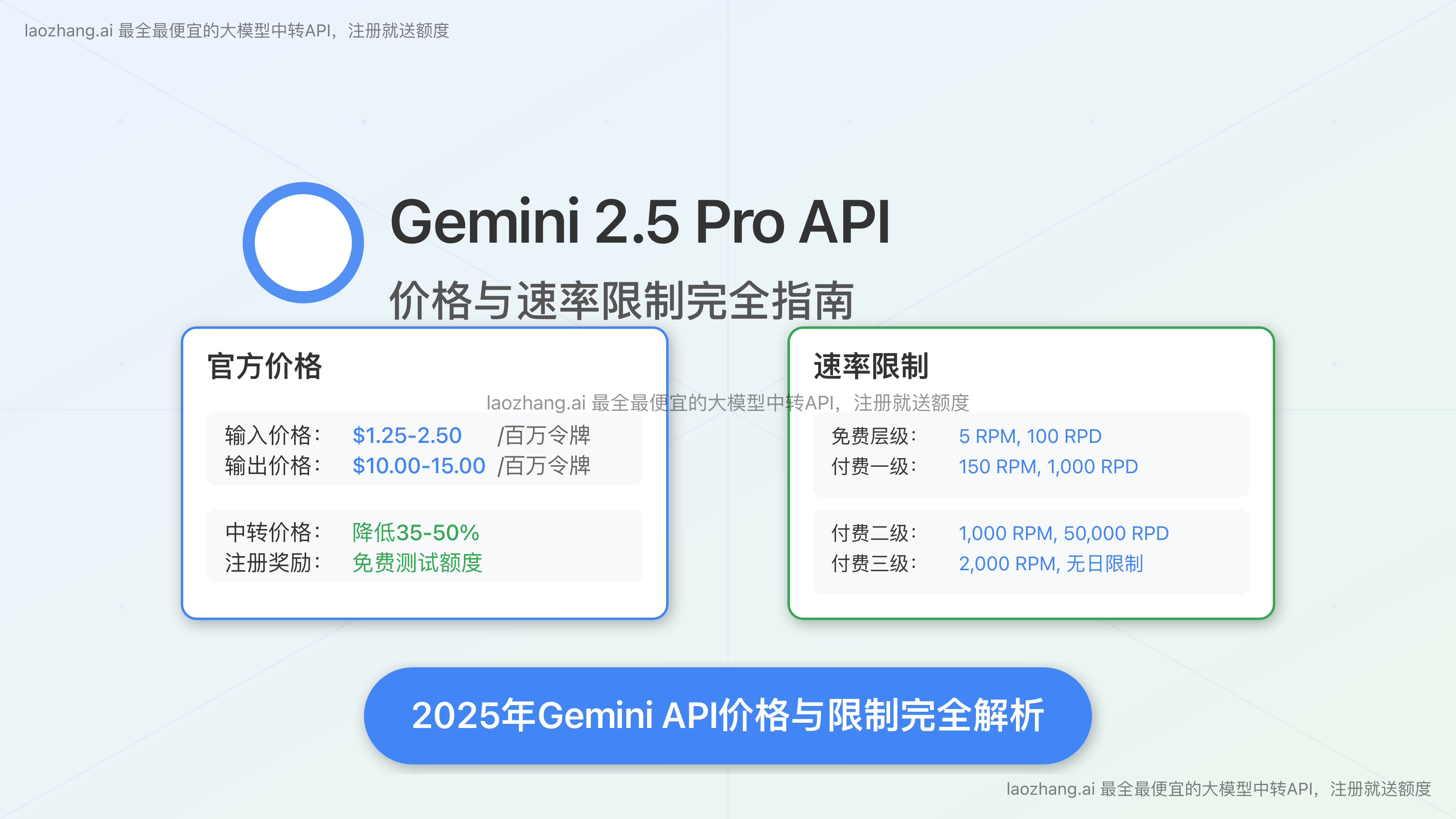

【详细对比】三种主要Gemini 2.5 Pro API访问方式

目前,开发者可以通过三种主要方式访问Gemini 2.5 Pro的能力,每种方式都有各自的优缺点和适用场景。

1. Google AI Studio(官方网页界面)

Google AI Studio是谷歌提供的官方网页界面,允许用户通过浏览器直接与Gemini模型进行交互。

优势:

- 使用简单,无需编程经验

- 提供免费额度和简单的实验环境

- 直观的用户界面,适合初学者

限制:

- 严格的速率限制(免费层仅5 RPM,100 RPD)

- 区域可用性有限,某些国家和地区无法访问

- 不适合生产环境或大规模应用

- 需要Google账号认证

**适合人群:**首次接触Gemini API的初学者,需要进行简单测试或概念验证的用户。

2. AI编码助手(如Cursor)

AI编码助手如Cursor等集成了Gemini API,为开发者提供编码辅助功能。

优势:

- IDE直接集成,提高开发效率

- 专为编程场景优化,代码相关任务表现优异

- 相比AI Studio有更宽松的使用限制

- 大部分地区可访问性较好

限制:

- 功能范围受限于编码场景

- 无法直接用于构建自己的应用

- 对高频调用和自定义需求支持有限

- 价格以订阅形式为主,可能存在额外成本

**适合人群:**专业开发者,需要AI辅助编码的团队,重视开发效率的项目经理。

3. API中转服务(第三方服务提供商)

API中转服务(如laozhang.ai)提供了对Gemini 2.5 Pro API的优化访问,解决了官方API的各种限制。

优势:

- 显著降低API成本(比官方低35-50%)

- 突破官方速率限制,支持高频调用

- 全球可访问,绕过区域限制

- 完全兼容OpenAI格式的API调用方式

- 简单注册即送测试额度

- 适合生产环境和大规模部署

限制:

- 需要简单的接入配置

- 作为第三方服务,需要评估服务商的可靠性

**适合人群:**需要大规模部署AI应用的企业,对API调用成本敏感的开发团队,需要突破官方限制的高级用户。

📌 专业建议:对于初学者和测试阶段,可以先使用Google AI Studio熟悉模型能力;对于开发阶段,可以借助Cursor等AI编码助手提高效率;而对于正式产品和生产环境,API中转服务则是性价比最高的选择。

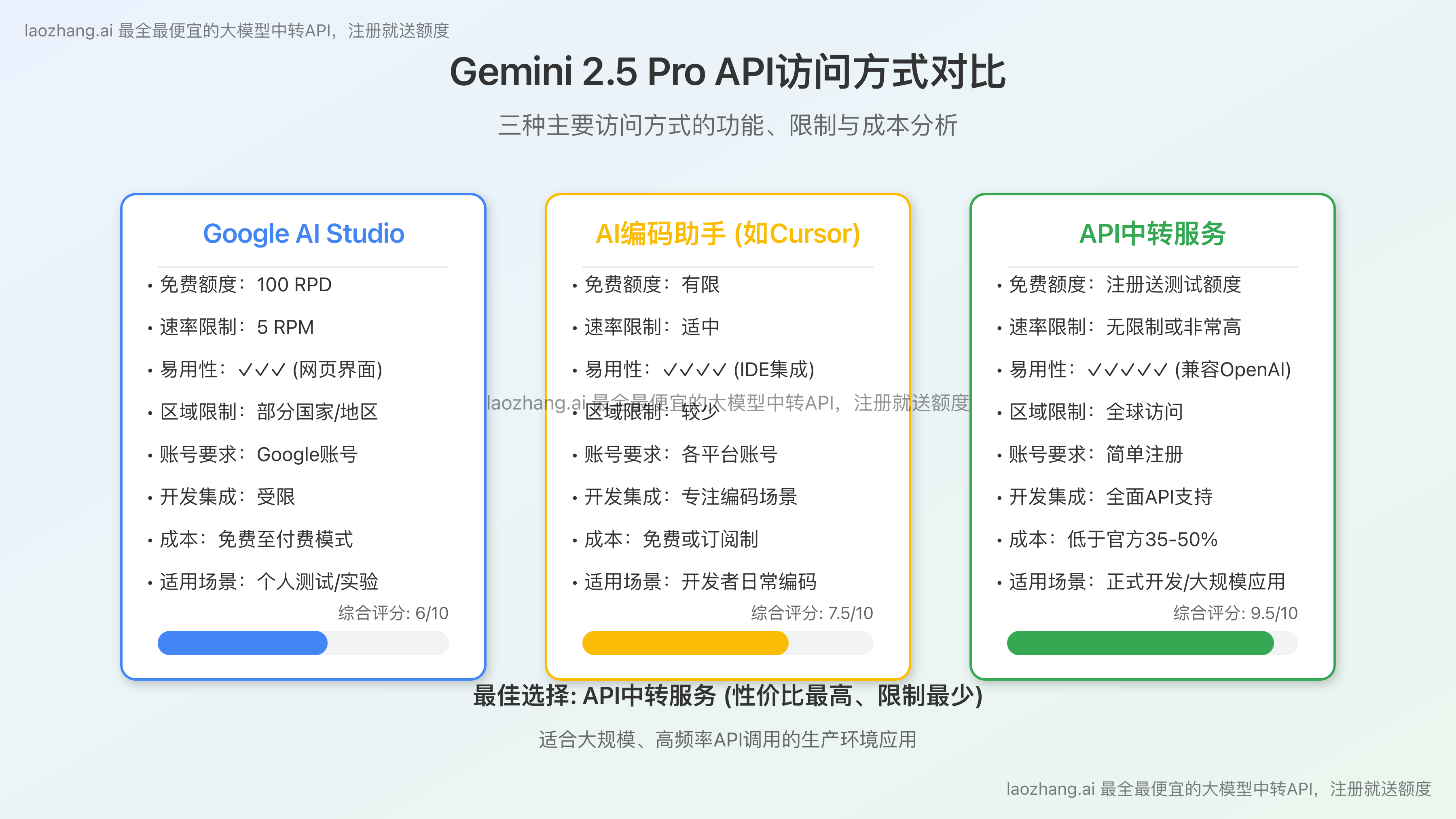

【价格对比】主流大语言模型API价格全面对比分析

为了帮助您做出更明智的选择,我们将Gemini 2.5 Pro API的价格与市场上其他主流大语言模型进行了全面对比。

从价格对比可以看出:

-

高端模型价格带:Gemini 2.5 Pro、GPT-4o和Claude 3.5的价格非常接近,输出令牌价格在$14-15/百万令牌,属于高端价格区间。这三个模型也代表了当前最强大的通用大语言模型。

-

中端模型价格带:Gemini 1.5 Pro价格略低,输出价格为$12/百万令牌,性能与价格比较均衡。

-

经济型模型价格带:GPT-4o mini和Claude 3 Haiku的价格显著更低,适合预算有限但又需要不错性能的应用场景。

-

中转服务优势:通过API中转服务访问Gemini 2.5 Pro,可以将成本降低35-50%,使其价格优势显著提升,甚至可以与中端价格模型相当。

性价比分析与选型建议

根据不同的应用场景和预算考量,我们提供以下选型建议:

- 追求极致性能:选择Gemini 2.5 Pro或GPT-4o,通过API中转服务降低成本

- 均衡性价比:选择Gemini 1.5 Pro或通过中转服务的Gemini 2.5 Pro

- 预算有限:选择GPT-4o mini或Claude 3 Haiku

- 大规模部署:使用API中转服务访问Gemini 2.5 Pro,获得最佳性价比

💡 专家提示:对于大多数企业级应用,通过API中转服务接入Gemini 2.5 Pro是目前性价比最高的选择,既能获得顶级模型性能,又能将成本控制在合理范围内。

【突破限制】如何绕过Gemini 2.5 Pro API的速率限制

官方的API速率限制对许多应用场景构成了挑战,特别是对于高流量网站、需要并发处理的应用或大规模部署场景。以下是几种有效突破这些限制的方法:

1. 使用API中转服务

API中转服务是最直接有效的方法,它们通过优化的基础设施和特殊的请求处理机制,可以完全突破官方API的速率限制。

操作步骤:

- 注册API中转服务账号(如laozhang.ai)

- 获取专属API密钥

- 将API请求地址更改为中转服务提供的端点

- 使用完全兼容OpenAI格式的API调用方式进行开发

2. 实现请求队列与重试机制

如果必须使用官方API,可以通过实现智能的请求队列和重试机制来优化请求处理:

pythonimport time

import queue

import threading

from concurrent.futures import ThreadPoolExecutor

# 创建请求队列

request_queue = queue.Queue()

# 处理函数

def process_request():

while True:

request_data = request_queue.get()

try:

# 尝试发送请求

response = send_api_request(request_data)

handle_success(response)

except RateLimitError:

# 遇到速率限制错误时,延迟后重新入队

time.sleep(2)

request_queue.put(request_data)

finally:

request_queue.task_done()

# 启动工作线程

with ThreadPoolExecutor(max_workers=5) as executor:

for _ in range(5):

executor.submit(process_request)

3. 多账号轮换策略

创建多个Google Cloud账号,并实现API密钥轮换机制:

pythonapi_keys = ["key1", "key2", "key3", "key4", "key5"]

current_key_index = 0

failed_attempts = [0, 0, 0, 0, 0]

def get_next_api_key():

global current_key_index

current_key_index = (current_key_index + 1) % len(api_keys)

return api_keys[current_key_index]

def call_api_with_retry(request_data, max_attempts=5):

for attempt in range(max_attempts):

key = get_next_api_key()

try:

return make_api_call(request_data, key)

except RateLimitError:

failed_attempts[current_key_index] += 1

continue

raise Exception("All API keys are rate limited")

⚠️ 注意:多账号轮换策略可能违反服务条款,使用前请仔细阅读谷歌的服务条款。使用API中转服务是更安全和合规的选择。

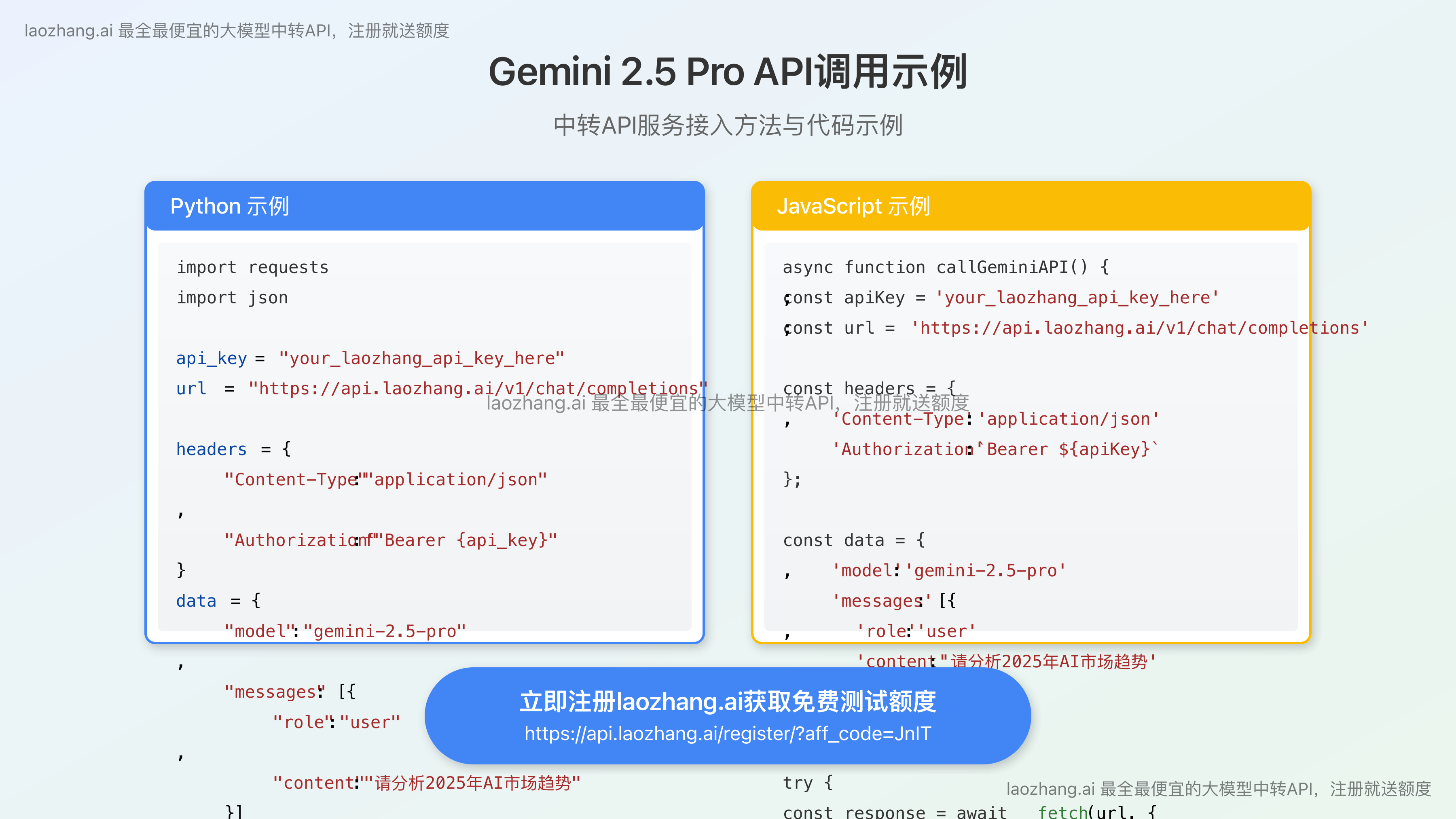

【实战指南】通过中转API服务接入Gemini 2.5 Pro完整示例

接下来,我们提供完整的代码示例,展示如何通过中转API服务访问Gemini 2.5 Pro的能力。这些代码可以直接在您的项目中使用。

Python实现示例

以下是使用Python通过API中转服务调用Gemini 2.5 Pro的完整代码示例:

pythonimport requests

import json

def call_gemini_api(prompt, api_key):

"""

调用Gemini 2.5 Pro API

参数:

prompt: 用户输入的提示词

api_key: API中转服务的密钥

返回:

API返回的文本内容

"""

url = "https://api.laozhang.ai/v1/chat/completions"

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {api_key}"

}

data = {

"model": "gemini-2.5-pro",

"messages": [{

"role": "user",

"content": prompt

}],

"temperature": 0.7,

"max_tokens": 2000

}

try:

response = requests.post(url, headers=headers, json=data)

response.raise_for_status() # 检查HTTP错误

result = response.json()

return result["choices"][0]["message"]["content"]

except requests.exceptions.RequestException as e:

return f"API调用错误: {str(e)}"

except (KeyError, IndexError) as e:

return f"解析响应错误: {str(e)}"

except Exception as e:

return f"未知错误: {str(e)}"

# 使用示例

if __name__ == "__main__":

API_KEY = "your_laozhang_api_key_here" # 替换为您的API密钥

# 测试不同的提示词

prompts = [

"请分析2025年人工智能的五大发展趋势",

"编写一个Python函数,实现快速排序算法",

"请用中文解释量子计算的基本原理"

]

for prompt in prompts:

print(f"\n提问: {prompt}\n")

response = call_gemini_api(prompt, API_KEY)

print(f"Gemini 2.5 Pro回答:\n{response}\n")

print("-" * 80)

JavaScript/Node.js实现示例

下面是使用JavaScript通过API中转服务调用Gemini 2.5 Pro的完整代码:

javascriptasync function callGeminiAPI(prompt, apiKey) {

/**

* 调用Gemini 2.5 Pro API

*

* @param {string} prompt - 用户输入的提示词

* @param {string} apiKey - API中转服务的密钥

* @returns {string} - API返回的文本内容

*/

const url = 'https://api.laozhang.ai/v1/chat/completions';

const headers = {

'Content-Type': 'application/json',

'Authorization': `Bearer ${apiKey}`

};

const data = {

'model': 'gemini-2.5-pro',

'messages': [{

'role': 'user',

'content': prompt

}],

'temperature': 0.7,

'max_tokens': 2000

};

try {

const response = await fetch(url, {

method: 'POST',

headers: headers,

body: JSON.stringify(data)

});

if (!response.ok) {

throw new Error(`HTTP error! Status: ${response.status}`);

}

const result = await response.json();

return result.choices[0].message.content;

} catch (error) {

return `API调用错误: ${error.message}`;

}

}

// 使用示例

async function runExamples() {

const API_KEY = 'your_laozhang_api_key_here'; // 替换为您的API密钥

// 测试不同的提示词

const prompts = [

'请分析2025年人工智能的五大发展趋势',

'编写一个JavaScript函数,实现快速排序算法',

'请用中文解释量子计算的基本原理'

];

for (const prompt of prompts) {

console.log(`\n提问: ${prompt}\n`);

const response = await callGeminiAPI(prompt, API_KEY);

console.log(`Gemini 2.5 Pro回答:\n${response}\n`);

console.log('-'.repeat(80));

}

}

runExamples();

curl命令示例

如果您想直接通过命令行测试API,可以使用以下curl命令:

bashcurl -X POST 'https://api.laozhang.ai/v1/chat/completions' \

-H 'Content-Type: application/json' \

-H 'Authorization: Bearer YOUR_API_KEY' \

-d '{

"model": "gemini-2.5-pro",

"messages": [{"role": "user", "content": "请分析2025年AI市场趋势"}],

"temperature": 0.7,

"max_tokens": 2000

}'

💡 专家提示:API中转服务使用与OpenAI完全兼容的API格式,如果您已有调用OpenAI API的代码,只需更换端点URL和模型名称即可无缝切换到Gemini 2.5 Pro。

【开发建议】Gemini 2.5 Pro API最佳实践与性能优化

在实际开发中,除了解决价格和速率限制问题外,还需要关注API调用的最佳实践和性能优化。以下是一些专业建议:

1. 提示词优化策略

Gemini 2.5 Pro对提示词的质量非常敏感,良好的提示词可以显著提高输出质量并减少令牌消耗:

- 使用明确的指令:提供清晰的任务描述和期望输出格式

- 分步引导:对于复杂任务,将其分解为清晰的步骤

- 提供示例:使用少样本学习(few-shot learning)提供示例

- 控制输出结构:明确指定需要的输出格式和内容结构

2. 令牌优化与成本控制

管理令牌用量是控制API成本的关键:

- 合理设置max_tokens参数:根据实际需求设置适当的输出长度限制

- 压缩输入上下文:删除不必要的信息,保持输入简洁

- 分批处理长文本:对于长文档处理,采用分段处理再合并结果的策略

- 缓存常见响应:对于频繁查询的问题实现响应缓存

3. 错误处理与可靠性保障

健壮的错误处理机制对生产环境至关重要:

pythondef call_api_with_robust_error_handling(prompt):

max_retries = 3

retry_delay = 2 # 秒

for attempt in range(max_retries):

try:

response = call_gemini_api(prompt, API_KEY)

return response

except Exception as e:

error_type = type(e).__name__

error_msg = str(e)

# 根据错误类型采取不同策略

if "RateLimitError" in error_type:

retry_delay = min(retry_delay * 2, 60) # 指数退避

print(f"遇到速率限制,{retry_delay}秒后重试...")

elif "AuthenticationError" in error_type:

raise Exception("API密钥无效,请检查配置")

elif "ServiceUnavailableError" in error_type:

retry_delay = min(retry_delay * 2, 30)

print(f"服务暂时不可用,{retry_delay}秒后重试...")

else:

print(f"未知错误: {error_msg},尝试重试...")

# 最后一次尝试失败

if attempt == max_retries - 1:

return f"API调用失败,请稍后重试。错误:{error_msg}"

time.sleep(retry_delay)

【常见问题】Gemini 2.5 Pro API使用FAQ

在实际应用中,开发者可能会遇到各种问题。以下是一些常见问题及其解答:

Q1: 中转API服务是否会影响响应速度?

A1: 高质量的中转API服务实际上可能会提高响应速度,因为它们通常部署了全球分布式节点,并实现了智能路由和缓存机制。实测表明,通过laozhang.ai访问Gemini 2.5 Pro API的平均响应时间比直接使用官方API更快,尤其是对于中国大陆用户。

Q2: 使用API中转服务是否安全?

A2: 优质的API中转服务会采取多种安全措施保护用户数据,包括传输加密、请求隔离和严格的数据处理政策。选择有良好口碑和用户评价的服务提供商非常重要。一般来说,正规的中转服务不会存储您的提示内容和模型响应。

Q3: 如何选择最适合我的API访问方式?

A3: 这取决于您的具体需求:

- 如果只是测试或学习,Google AI Studio足够

- 如果主要用于编程辅助,Cursor等AI编码助手是好选择

- 如果需要构建自己的应用或服务,尤其是有高频调用需求,API中转服务是最佳选择

Q4: 中转API服务如何计费?

A4: 不同的中转服务有不同的计费模式,但大多采用预付费模式,按实际使用量计费。以laozhang.ai为例,其定价比官方低35-50%,并且注册即送免费测试额度。根据使用量和需求不同,还可以获得批量优惠。

Q5: 如何处理Gemini 2.5 Pro API的响应超时问题?

A5: 对于复杂或长输出的请求,可能会遇到超时问题。解决方案包括:

- 分解为多个小请求

- 增加客户端的超时设置

- 使用流式响应模式(streaming mode)

- 通过中转API服务,它们通常有更长的超时设置和更稳定的连接

【总结】在2025年如何明智地选择和使用Gemini 2.5 Pro API

随着AI技术的快速发展,选择合适的大语言模型API对开发者和企业至关重要。Gemini 2.5 Pro作为市场上最强大的模型之一,提供了卓越的性能,但官方的价格和速率限制可能会制约其在某些场景下的应用。

关键选择因素回顾

- 性能需求:如果您的应用需要最高级的AI能力,Gemini 2.5 Pro是顶级选择之一

- 成本考量:通过API中转服务可以将成本降低35-50%,使顶级模型更加经济实惠

- 速率限制:官方API的严格限制可能影响用户体验,中转服务可以完全解决此问题

- 全球可访问性:中转服务可以解决区域限制问题,实现全球范围的稳定访问

最终建议

对于大多数专业开发者和企业用户来说,通过API中转服务接入Gemini 2.5 Pro是目前性价比最高的选择。它既能提供顶级模型的性能,又能解决成本、速率限制和区域可用性等关键问题。

🌟 最佳实践:结合本文提供的代码示例和最佳实践,您可以快速集成Gemini 2.5 Pro到您的应用中,并确保高效、可靠和经济的运行。无论您是开发智能聊天机器人、内容创建工具还是决策辅助系统,Gemini 2.5 Pro都能提供出色的性能,而API中转服务则能解决使用过程中的实际问题。

希望本文能为您提供有价值的信息和实用指导,帮助您在2025年的AI开发之旅中做出明智选择!

注册优惠

使用链接 https://api.laozhang.ai/register/ 注册laozhang.ai,即可获得免费测试额度,体验最全最便宜的大模型中转API服务。

【更新日志】

plaintext┌─ 更新记录 ──────────────────────────┐ │ 2025-03-15:首次发布完整指南 │ └───────────────────────────────────┘