Gemini生图安全机制完全解析:为什么不返回图片以及如何解决

深度解析Gemini图片生成的双层安全过滤架构,涵盖8大拦截类别、finishReason错误码诊断、Layer 1可配置过滤与Layer 2不可绕过机制、提示词优化策略和SynthID水印机制。

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者你输入了一段看似完全正常的提示词,Gemini API返回了HTTP 200状态码,响应体里有文字回复,但图片呢——消失了。没有报错,没有异常,就是不返回图片。这种"吞图"现象正在困扰大量使用Gemini图片生成功能的开发者和普通用户,而且问题在Nano Banana 2(即Gemini 2.5 Flash Image模型)于近期发布后变得更加严重。Google的安全过滤机制经历了一次重大升级,在名人识别、金融信息修改、换脸换装和隐含暗示内容四个维度显著收紧了安全策略。

理解"为什么不返回图片"需要先理解一个关键事实:Gemini的安全过滤不是单层的,而是双层架构。第一层是你可以通过API参数配置的输入端过滤,第二层是Google硬编码的输出端过滤,任何API参数都无法关闭。很多开发者在设置了BLOCK_NONE之后以为已经完全解除了限制,但图片依然不返回——这正是因为BLOCK_NONE只影响第一层,对第二层的IMAGE_SAFETY和PROHIBITED_CONTENT过滤毫无作用。

如果你还不熟悉Gemini图片生成API的基本使用方法,建议先阅读我们的Gemini 2.5 Flash Image API指南了解基础调用流程。本文将系统拆解Gemini图片生成的完整安全机制——从双层架构的技术原理到8大拦截类别的具体触发条件,从finishReason错误码的快速诊断到Layer 1和Layer 2的分别应对策略,再到SynthID数字水印的合规要求。无论你是遇到了"吞图"困扰的开发者,还是想深入理解AI生图安全边界的技术爱好者,这篇文章都能帮你建立完整的认知框架。

双层安全架构:理解"不返回图片"的技术根源

Gemini的图片生成安全机制采用了双层过滤架构(Dual-Layer Filtering Architecture),这是理解所有"不返回图片"问题的基础。两层过滤在请求处理的不同阶段生效,拥有完全不同的控制权限,这种设计决定了哪些安全限制你可以调整,哪些是Google强制执行的硬性红线。

Layer 1(可配置输入过滤) 在你的提示词到达模型之前就开始工作。根据Google AI安全设置文档的说明,它评估输入文本在四个维度上的风险概率:骚扰内容(Harassment)、仇恨言论(Hate Speech)、色情内容(Sexually Explicit)和危险内容(Dangerous Content)。每个维度都有独立的概率评分,系统会将评分与你设定的阈值进行比较——如果评分超过阈值,请求直接被拒绝,模型甚至不会尝试生成图片。Layer 1的关键特征是完全可配置:你可以为每个维度设定从BLOCK_LOW_AND_ABOVE(最严格)到BLOCK_NONE(最宽松)的不同阈值,也可以设为OFF完全关闭该维度的过滤。

重要区分:从Gemini 2.5和Gemini 3系列开始,四个Harm类别的默认阈值已经改为

OFF(关闭),这意味着Layer 1默认不会拦截任何请求。如果你仍然遇到图片不返回的问题,原因几乎一定在Layer 2。

Layer 2(不可配置输出过滤) 在模型已经生成图片之后才生效。它对生成的图片进行二次审查,检测其中是否包含违规内容。与Layer 1不同,Layer 2的所有过滤器都是硬编码的,无法通过任何API参数、配置文件或控制台设置来关闭。Layer 2包含三类核心过滤器:IMAGE_SAFETY(检测生成图片中的不安全内容)、PROHIBITED_CONTENT(检测版权侵犯和受限IP)、以及CSAM检测(检测涉及未成年人的不当内容,这是法律强制要求)。

这种双层设计解释了最让开发者困惑的现象:HTTP响应状态码是200(请求成功),响应体中有文字内容,但图片字段为空。这说明请求通过了Layer 1的审查,模型成功生成了图片,但Layer 2在输出阶段拦截了生成结果。API没有返回传统意义上的"错误",而是静默地移除了图片——这就是"吞图"现象的技术本质。

| 对比维度 | Layer 1(输入过滤) | Layer 2(输出过滤) |

|---|---|---|

| 生效阶段 | 提示词评估阶段 | 图片生成后审查 |

| 可配置性 | 完全可配置 | 不可配置 |

| 过滤类别 | 4个Harm类别 | IMAGE_SAFETY/PROHIBITED_CONTENT/CSAM |

| 默认状态 | OFF(Gemini 2.5+) | 始终启用 |

| 绕过方式 | 调整阈值到BLOCK_NONE | 无法绕过,只能优化提示词 |

| 典型表现 | 明确的拒绝响应 | HTTP 200但无图片 |

开发者须知:当你在

finishReason字段中看到SAFETY时,说明是Layer 1拦截,可以通过调整safety_settings解决。看到IMAGE_SAFETY或PROHIBITED_CONTENT时,说明是Layer 2拦截,需要通过提示词优化来规避。

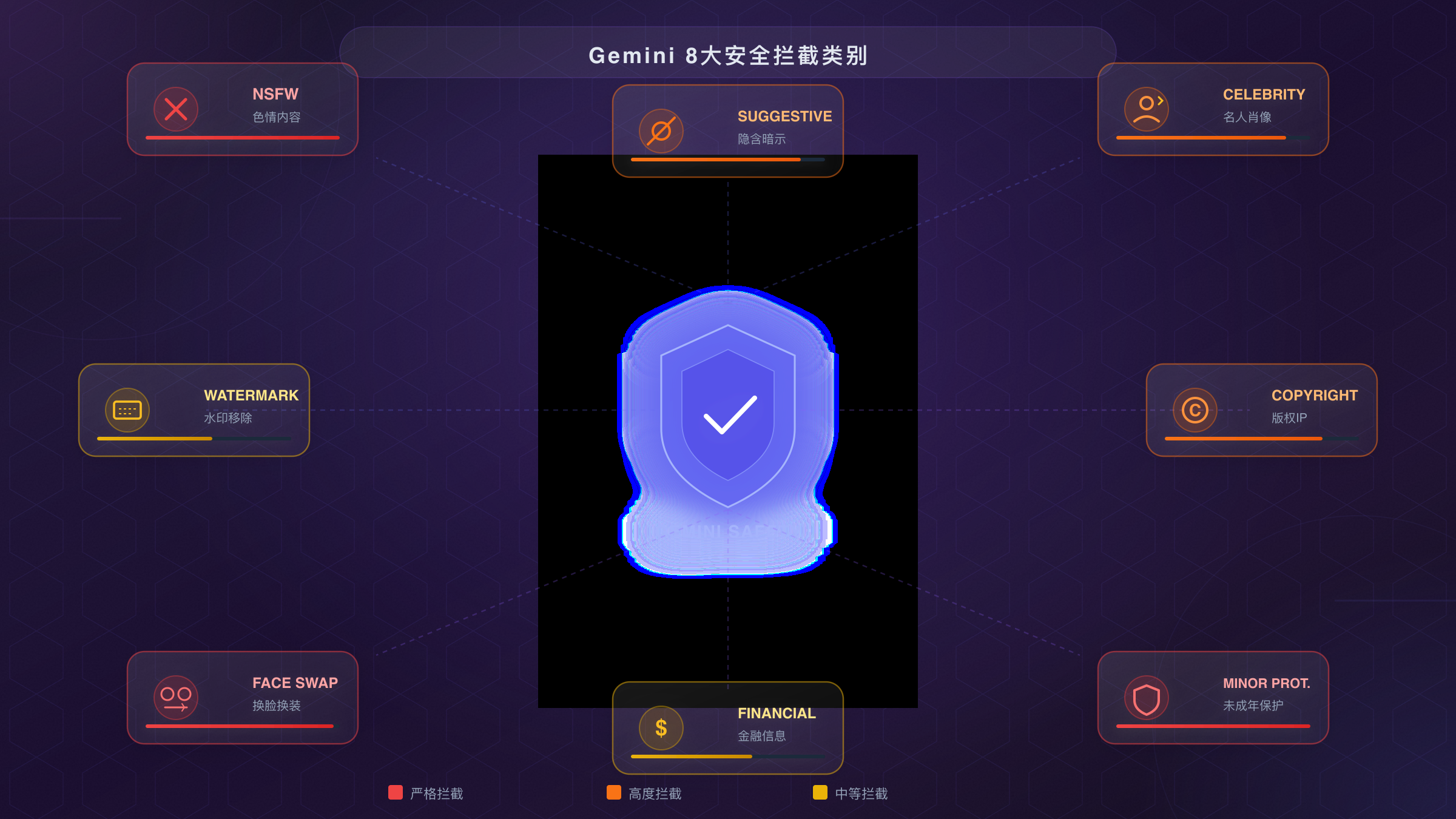

8大拦截类别完整图谱

理解了双层架构后,下一个问题是:具体什么内容会触发拦截?根据Google的官方文档和开发者社区的大量实测反馈,Gemini的图片生成安全机制覆盖了8个主要的拦截类别,每个类别的严格程度和绕过难度各不相同。

第一类:NSFW/色情内容是Gemini执行最严格的类别,采用"零容忍"策略。与其他AI图片生成工具相比,Gemini对色情内容的定义范围更广——不仅包括明显的裸露和性行为,还包括暗示性的姿态、过度暴露的着装描述,甚至某些文化语境下可能被解读为性暗示的场景。这个类别的拦截发生在Layer 2,无法通过任何API参数关闭。在实际测试中,包含"bikini"、"lingerie"等词汇的提示词即使在艺术创作语境下也会被高概率拦截。

第二类:隐含暗示内容是Nano Banana 2升级后新增强的检测能力。它针对的不是显性的违规内容,而是那些"表面合规但隐含暗示"的提示词。例如,描述某个角色在特定场景中的"放松姿态"或"自然状态",即使文字层面没有任何色情词汇,AI模型也可能判定意图可疑而拒绝生成。这类拦截的误报率相对较高,也是开发者社区抱怨最多的类别。

第三类:名人/公众人物的生成限制在最近的更新中被大幅收紧。任何可识别的真实公众人物——无论是政治人物、娱乐明星还是体育名人——的图片生成请求都会被Layer 2拦截。这个限制不仅包括直接提到名人名字的情况,还包括通过详细的外貌描述间接指向特定人物的情况。Google在开发者论坛中承认过滤器"比预期更加谨慎"(way more cautious than we intended),这意味着即使是模糊的相似性也可能触发拦截。

第四类:版权IP/受保护角色涵盖了所有受版权保护的知识产权,详见Gemini图片生成负责任AI文档。迪士尼角色、漫威超级英雄、Nintendo游戏角色、知名动漫形象等都在拦截范围内。值得注意的是,这个类别存在明显的"过度拦截"问题——某些通用的动漫艺术风格(anime style)也可能触发版权检测,即使提示词没有提到任何具体的角色或作品。finishReason返回PROHIBITED_CONTENT或OTHER通常表示触发了这个类别。

第五类:未成年人保护是法律强制要求的硬性限制,Google在这个类别上实施了最严格的CSAM(Child Sexual Abuse Material)检测。任何涉及未成年人的不当内容请求都会被绝对拦截,这个过滤器在所有模型版本中始终处于最高优先级,没有任何合法的绕过方式。

第六类:金融信息修改是随Nano Banana 2新增的拦截类别。它针对的是试图通过AI生成虚假金融文档、修改银行对账单、伪造交易记录等场景。这个类别的加入反映了Google对AI技术被用于金融欺诈的担忧。

第七类:换脸/换装(Deepfake Prevention)拦截所有试图将一个人的面部特征替换到另一个人身上的请求。无论是"给这个人换一套衣服"还是"把A的脸放到B的身体上",都会触发Layer 2的拦截。这个限制旨在防止深度伪造技术的滥用。

第八类:水印移除自2025年3月起逐步收紧。尝试让AI去除图片上的水印、版权标识或所有权标记的请求会被拦截。这个限制与Google对知识产权保护的立场一致,也与SynthID数字水印策略形成呼应。

| 拦截类别 | 所属层级 | 严格程度 | 误报率 | 可优化空间 |

|---|---|---|---|---|

| NSFW/色情 | Layer 2 | 极高 | 中等 | 极低 |

| 隐含暗示 | Layer 2 | 高 | 较高 | 中等 |

| 名人/公众人物 | Layer 2 | 极高 | 较高 | 低 |

| 版权IP | Layer 2 | 高 | 高 | 中等 |

| 未成年人保护 | Layer 2 | 绝对 | 极低 | 无 |

| 金融信息修改 | Layer 2 | 高 | 低 | 极低 |

| 换脸/换装 | Layer 2 | 高 | 低 | 极低 |

| 水印移除 | Layer 2 | 中高 | 低 | 低 |

核心结论:8个拦截类别中有7个属于Layer 2(不可配置),这就是为什么调整API参数对大多数"吞图"问题无效。唯一有效的应对策略是理解触发边界 + 提示词工程。

从表格中可以清楚地看到,8个拦截类别中有7个属于Layer 2——这就是为什么大多数"不返回图片"的问题无法通过调整API参数解决。唯一有效的应对策略是理解每个类别的触发边界,然后通过提示词工程来规避误拦截。

finishReason错误码快速诊断

当Gemini API不返回图片时,响应体中的finishReason字段是定位问题根源的最关键线索。不同的finishReason值指向不同的拦截层级和原因,对应着完全不同的解决路径。学会快速诊断finishReason可以将排查时间从数小时缩短到30秒以内。

finishReason: "STOP" 是唯一的正常状态,表示模型成功完成了生成过程且未被任何过滤器拦截。如果响应中出现STOP但你仍然没有看到图片,问题不在安全过滤,而在于请求配置——最常见的原因是没有在请求中指定responseModalities: ["TEXT", "IMAGE"]。Gemini的图片生成模型默认同时返回文本和图片,但如果你使用了错误的API端点或缺少了responseModalities参数,模型可能只返回文本描述而不生成实际图片。

finishReason: "SAFETY" 表示Layer 1拦截。响应体中的safetyRatings数组会详细列出四个Harm类别各自的概率评分,其中概率最高的类别就是触发拦截的原因。这是最容易解决的问题——在API请求中添加safetySettings参数,将对应类别的阈值设为BLOCK_NONE即可解除拦截。不过需要注意,生产环境中完全关闭安全过滤可能带来合规风险。

finishReason: "IMAGE_SAFETY" 表示Layer 2的图片安全过滤器拦截了已生成的图片。这是"吞图"现象最常见的原因。由于Layer 2不可配置,任何API参数调整都无法解决这个问题。唯一的应对方式是修改提示词——增加艺术风格描述、改用虚构场景框架、或者调整敏感元素的表述方式。

finishReason: "PROHIBITED_CONTENT" 表示内容涉及版权IP或受限知识产权。这通常发生在请求生成受版权保护的角色(如迪士尼角色、特定动漫人物)或使用了与受保护IP高度关联的风格描述时。解决方案是移除所有与特定IP相关的词汇,使用原创角色描述替代。

finishReason: "OTHER" 是一个模糊的兜底状态,通常与版权检测有关但不明确归入PROHIBITED_CONTENT。在开发者论坛的讨论中,这个状态经常出现在使用"anime style"(动漫风格)等通用但可能被误判为版权关联的描述时。

快速诊断流程:收到响应后,第一步检查

finishReason。如果是STOP但无图片,检查responseModalities参数。如果是SAFETY,查看safetyRatings找出触发类别并调整阈值。如果是IMAGE_SAFETY/PROHIBITED_CONTENT/OTHER,进入提示词优化流程。

以下是一个典型的Layer 2拦截响应示例,注意HTTP状态码是200但图片字段为空:

json{

"candidates": [{

"content": {

"parts": [

{"text": "I've created the image as requested."}

]

},

"finishReason": "IMAGE_SAFETY",

"safetyRatings": [

{"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "probability": "NEGLIGIBLE"},

{"category": "HARM_CATEGORY_HATE_SPEECH", "probability": "NEGLIGIBLE"}

]

}]

}

这个响应的诡异之处在于:文字部分声称"已经按要求创建了图片",但实际的图片数据并未包含在parts数组中。模型确实生成了图片,但Layer 2在输出阶段拦截了它——文字回复是在Layer 2过滤之前就已经确定的,所以出现了"说一套做一套"的矛盾现象。这也是很多用户困惑的来源:AI明明说"图片已生成",可就是看不到图片。

Layer 1可配置过滤:正确使用safety_settings

既然Layer 1的过滤器是完全可配置的,那么正确设置safetySettings参数就能消除这一层级导致的所有图片不返回问题。需要强调的是,从Gemini 2.5 Flash和Gemini 3系列开始,Layer 1的四个Harm类别默认阈值已经设为OFF(关闭),因此大多数新版本模型的用户不会遇到Layer 1的拦截。但如果你使用的是较早的模型版本(关于不同版本的免费额度差异,可以参考Gemini API免费层级限制详解),或者通过某些中间件调用API时被自动添加了安全设置,Layer 1仍然可能成为"吞图"的原因。

在Python中配置safety_settings的标准方式如下:

pythonfrom google import genai

from google.genai import types

client = genai.Client(api_key="YOUR_API_KEY")

response = client.models.generate_content(

model="gemini-2.5-flash-image",

contents="一只金毛犬在公园草地上奔跑,数字艺术风格",

config=types.GenerateContentConfig(

response_modalities=["TEXT", "IMAGE"],

safety_settings=[

types.SafetySetting(

category=types.HarmCategory.HARM_CATEGORY_HARASSMENT,

threshold=types.HarmBlockThreshold.BLOCK_NONE,

),

types.SafetySetting(

category=types.HarmCategory.HARM_CATEGORY_HATE_SPEECH,

threshold=types.HarmBlockThreshold.BLOCK_NONE,

),

types.SafetySetting(

category=types.HarmCategory.HARM_CATEGORY_SEXUALLY_EXPLICIT,

threshold=types.HarmBlockThreshold.BLOCK_NONE,

),

types.SafetySetting(

category=types.HarmCategory.HARM_CATEGORY_DANGEROUS_CONTENT,

threshold=types.HarmBlockThreshold.BLOCK_NONE,

),

],

),

)

这段代码有两个关键点容易被忽略。第一个是response_modalities参数——如果不明确指定["TEXT", "IMAGE"],某些API版本可能默认只返回文本。第二个是safety_settings必须覆盖所有四个Harm类别,遗漏任何一个类别都意味着该类别会使用默认阈值,可能导致意外拦截。

在Node.js环境中,配置方式略有不同但逻辑一致:

javascriptconst { GoogleGenerativeAI, HarmCategory, HarmBlockThreshold } = require("@google/generative-ai");

const genAI = new GoogleGenerativeAI("YOUR_API_KEY");

const model = genAI.getGenerativeModel({

model: "gemini-2.5-flash-image",

safetySettings: [

{ category: HarmCategory.HARM_CATEGORY_HARASSMENT, threshold: HarmBlockThreshold.BLOCK_NONE },

{ category: HarmCategory.HARM_CATEGORY_HATE_SPEECH, threshold: HarmBlockThreshold.BLOCK_NONE },

{ category: HarmCategory.HARM_CATEGORY_SEXUALLY_EXPLICIT, threshold: HarmBlockThreshold.BLOCK_NONE },

{ category: HarmCategory.HARM_CATEGORY_DANGEROUS_CONTENT, threshold: HarmBlockThreshold.BLOCK_NONE },

],

});

如果你使用的是REST API直接调用,安全设置通过JSON体中的safetySettings数组传递。每个元素需要包含category和threshold两个字段。需要特别注意的是,BLOCK_NONE和OFF在功能上接近但不完全等价——BLOCK_NONE会返回安全评分但不阻止内容,OFF则完全跳过评分过程。在图片生成场景中,两者的实际效果通常没有区别,但OFF的处理速度略快因为省去了评分计算。

生产环境建议:虽然将所有类别设为BLOCK_NONE可以消除Layer 1的拦截,但在面向最终用户的生产应用中,建议至少保留HARM_CATEGORY_DANGEROUS_CONTENT的默认过滤,以避免生成可能引发法律风险的内容。

对于使用Vertex AI而非Google AI Studio的企业用户,安全设置的配置方式相同,但需要注意Vertex AI平台可能有额外的组织级安全策略叠加在API级设置之上。开发者论坛中有报告指出,相同的提示词在Google AI Studio中能成功生成图片,但在Vertex AI上被拦截——这可能是因为Vertex AI的企业级安全策略比API默认设置更加严格。

Layer 2不可绕过过滤:提示词工程策略

当finishReason返回IMAGE_SAFETY或PROHIBITED_CONTENT时,问题出在Layer 2——这是无法通过任何配置参数解决的。唯一有效的应对方式是提示词工程(Prompt Engineering):在不改变创作意图的前提下,调整提示词的表述方式来降低触发安全过滤器的概率。根据开发者社区的大量实测数据,经过优化的提示词在边界性内容上的成功率可以从不到20%提升到70-80%。

提示词优化核心公式:具体性 + 环境描述 + 艺术框架。这三个元素的组合可以将边界性内容的生成成功率从不到20%提升到70-80%。

提示词优化的核心公式是:具体性 + 环境描述 + 艺术框架。每个元素都在降低安全过滤器的警觉度方面发挥作用。具体性意味着用详细的描述替代模糊的指令——"一只金毛犬在阳光下的草地上奔跑,数字艺术风格"比"一只狗"更不容易被拦截,因为详细描述为模型提供了更清晰的语境信号。环境描述添加了场景背景,让模型理解生成意图是创意表达而非恶意用途。艺术框架则通过明确的风格标注(如"illustration"、"concept art"、"cartoon"),将请求归入艺术创作范畴。

以下是经过验证的提示词转换策略及其实测成功率:

| 原始提示词 | 优化后提示词 | 成功率 |

|---|---|---|

| a dog | Golden retriever in park, digital art | 95% |

| person walking | Cartoon character walking, animation style | 85% |

| knight fighting | Fantasy hero in battle, video game concept art | 85% |

| woman portrait | Illustrated character portrait, watercolor style | 80% |

| city at night | Cyberpunk cityscape, neon lights, digital painting | 95% |

从表格中可以总结出几个关键模式。首先,添加艺术风格标注是最有效的单一优化手段——"digital art"、"illustration"、"concept art"、"watercolor"等标注明确告诉安全过滤器这是艺术创作请求。其次,使用虚构角色替代真实人物描述可以显著降低被拦截概率——"cartoon character"比"person"更安全,因为卡通角色不涉及真实人物的肖像权问题。第三,添加具体的环境描述提供了上下文信号,让过滤器更容易判定请求的意图是合法的。

对于版权IP类别的拦截,提示词优化的空间更加有限。如果你需要生成与特定IP风格相似但不直接引用的图片,可以使用"inspired by"或"in the style of"这类间接引用——但成功率取决于过滤器对风格相似度的判定。一个更可靠的策略是完全抛开特定IP的描述,转而描述你想要的视觉效果:"大眼睛、圆脸、色彩鲜艳的可爱角色"比"像Pixar风格的角色"更安全。

对于完全无法通过提示词优化解决的场景(如名人生成、NSFW内容),提示词工程不再适用,需要考虑替代方案。在中国开发者社区中,一种常见的做法是使用支持多模型切换的API服务,在Gemini被拦截时自动回退到过滤策略不同的模型。通过laozhang.ai这类聚合服务,你可以用统一的接口同时访问Gemini、DALL-E 3、Flux等多个图片生成模型——当一个模型的安全过滤器拒绝了你的请求时,自动切换到另一个模型往往能获得不同的结果,因为每家公司的安全策略侧重点不同。

SynthID数字水印:每张图片的隐形身份证

每一张由Gemini生成的图片都被强制嵌入了SynthID数字水印。这不是可选功能,而是硬编码在图片生成流程中的必经步骤——无论你使用的是Google AI Studio、Vertex AI还是直接调用API,SynthID都会在图片生成的最后阶段自动嵌入。

SynthID采用了双层水印设计。第一层是传统的可见标识,通常出现在图片的右下角区域,标注这是AI生成的内容。第二层是嵌入到图片像素层的隐形数字指纹,使用深度学习模型在不影响图片视觉质量的前提下修改特定像素的值。这个隐形水印具有相当强的鲁棒性——经过常规的图片处理操作如裁剪、旋转、压缩、色彩调整后,水印通常仍然可以被检测到。只有在图片经过多次叠加处理后,水印才可能变得无法识别。

从技术实现的角度看,SynthID的嵌入过程发生在模型推理的最后阶段,在Layer 2安全过滤之前。这意味着即使一张图片最终被Layer 2拦截而没有返回给用户,Google内部的系统仍然记录了这次生成行为。SynthID不仅服务于内容溯源,也是Google满足全球各地AI监管要求的技术基础——包括欧盟AI法案中对AI生成内容标注的强制性要求。

对于使用Gemini API进行商业项目的开发者来说,SynthID水印带来了一个实际考量:你生成的所有图片都携带了Google的数字指纹,可以被验证为AI生成内容。在大多数应用场景中这不会造成问题,但如果你对Gemini图片生成的提示词技巧感兴趣,我们的Gemini图片生成提示词指南中有更详细的实战经验。如果你的业务需要图片看起来"非AI生成"(例如某些创意营销场景),Gemini可能不是最合适的选择。目前没有官方支持的方式来移除SynthID水印——尝试移除水印本身也违反了Google的服务条款。

SynthID检测工具:Google提供了在线验证工具,任何人都可以上传图片来检查是否包含SynthID水印。这对内容审核团队和新闻机构来说是一个有价值的真实性验证手段。

替代方案与最佳实践

当Gemini安全过滤无法满足需求时

不是所有的图片生成需求都能在Gemini的安全边界内得到满足。理解何时应该坚持优化提示词、何时应该切换到其他工具,是提高开发效率的关键。以下是基于不同安全限制场景的替代方案建议:

对于触发IMAGE_SAFETY但内容本身合规的场景(如医学教育插图、历史事件描绘),提示词优化通常可以解决问题。添加"educational illustration"、"textbook diagram"等标注,明确传达内容的学术或教育目的。如果多次优化仍然被拦截,可以考虑使用DALL-E 3或Flux模型作为替代——这两个模型的安全过滤策略在某些类别上比Gemini更宽松。

对于触发PROHIBITED_CONTENT的版权相关场景,切换模型通常是更高效的选择。不同模型对版权IP的检测精度和覆盖范围不同,Gemini在这方面属于最严格的一档。使用开源模型(如Stable Diffusion系列)可以完全规避版权检测,但需要自行承担法律合规责任。

| 替代方案 | 安全策略特点 | 适用场景 | 价格参考 |

|---|---|---|---|

| DALL-E 3 | 严格但类别不同 | 艺术创作、商业设计 | ~$0.04/张 |

| Flux Kontext | 相对宽松 | 品牌设计、产品图 | ~$0.03/张 |

| Stable Diffusion | 无内置过滤 | 需自建安全审核 | 自托管成本 |

| Midjourney | 中等严格 | 概念艺术、创意设计 | ~$0.05/张 |

生产环境最佳实践

在生产应用中集成Gemini图片生成时,需要建立一套系统性的安全过滤应对机制,而不是遇到问题再临时处理。以下是经过验证的最佳实践框架:

第一,实现多层回退策略。在代码层面,当Gemini返回IMAGE_SAFETY或PROHIBITED_CONTENT时,自动触发备选模型生成。这种回退不需要用户干预,也不需要修改提示词,只是切换到安全策略不同的模型。对于使用多模型聚合API的开发者,实现这种回退通常只需要修改一个模型ID参数。通过laozhang.ai等支持200+模型的统一接口,你可以用相同的API格式轻松切换Gemini、DALL-E、Flux等不同的图片生成模型,充值$100获得$110额度,按实际使用量计费。

第二,建立提示词预检机制。在发送请求到Gemini之前,使用一个轻量级的文本分类模型对提示词进行预分析,识别可能触发拦截的关键词和模式。预检可以提前标记高风险提示词,给用户提供修改建议或直接路由到更宽松的模型,避免浪费API调用次数和等待时间。

第三,记录和分析拦截模式。将每次被拦截的请求记录下来,包括原始提示词、finishReason、safetyRatings和时间戳。定期分析这些数据可以帮你发现安全过滤策略的变化趋势——Google会不定期更新过滤规则,之前能通过的提示词可能在更新后被拦截。保持对这些变化的感知是长期运营的关键。

第四,为用户提供透明的反馈。当图片生成失败时,不要简单地显示"生成失败"——根据finishReason给用户提供有针对性的反馈和建议。例如,IMAGE_SAFETY触发时可以提示"当前描述可能包含敏感元素,建议添加艺术风格标注",PROHIBITED_CONTENT触发时可以提示"描述可能涉及受版权保护的内容,请使用原创描述"。透明的反馈不仅提升用户体验,还能引导用户自主调整提示词。

常见误区澄清

在Gemini图片生成安全机制的讨论中,有几个广泛流传但不正确的认知需要澄清。

误区一:"设置BLOCK_NONE就能解除所有限制"。事实是BLOCK_NONE只影响Layer 1的四个Harm类别,对Layer 2的IMAGE_SAFETY和PROHIBITED_CONTENT完全无效。而且从Gemini 2.5系列开始,Layer 1默认就是OFF,设置BLOCK_NONE不会带来任何额外的效果。

误区二:"Google AI Studio比API更宽松"。开发者论坛中确实有报告指出同样的提示词在AI Studio中成功但在API中失败的情况,但这通常是由于AI Studio和API使用了不同版本的模型或不同的默认安全配置,而非有意区分。

误区三:"重试几次就能成功"。对于Layer 2拦截的内容,重复发送相同的请求不会产生不同的结果——安全过滤器是确定性的,同一个输入始终产生同一个过滤决策。只有修改提示词或切换模型才可能改变结果。不过,对于一些边界性内容,由于模型生成过程本身的随机性,不同的生成结果可能在Layer 2的判定边界两侧——这种情况下重试确实偶尔能成功,但成功率通常低于20%。

误区四:"中文提示词比英文更容易被拦截"。这个说法没有系统性的数据支持。Gemini的安全过滤器对多语言输入的处理是基于语义理解而非关键词匹配,中文和英文提示词在安全评估上的差异主要来自翻译导致的语义变化,而非语言本身的歧视。

回顾全文的核心逻辑:Gemini的图片生成安全机制是一个精心设计的双层系统,Layer 1给你配置空间,Layer 2画出硬性红线。理解这个架构后,你就能快速判断每次"不返回图片"的根源在哪,是调整参数就能解决,还是需要优化提示词,或者干脆切换到其他模型。安全过滤不是bug——它是Google在AI能力和社会责任之间寻找平衡的产物。作为开发者,在这个框架内高效工作的能力,将成为AI应用开发的一项核心技能。