GLM-4.5 API深度解析:2025年7月最新评测,成本仅为Claude十分之一的开源SOTA模型完整接入指南

全面解析GLM-4.5 API的技术架构、性能优势和接入方法。作为2025年7月28日发布的开源SOTA模型,GLM-4.5以355B参数实现国产第一性能,API价格仅需0.8元/百万tokens,通过laozhang.ai调用还可再省30%。包含详细代码示例、性能对比和实战案例。

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者🎯 核心价值:GLM-4.5作为2025年7月28日发布的开源SOTA模型,以355B参数实现国产第一性能,API价格仅需0.8元/百万tokens,通过laozhang.ai调用还可再省30%。

引言:为什么GLM-4.5正在改变AI应用格局

什么是GLM-4.5?

GLM-4.5是智谱AI于2025年7月28日发布的新一代多模态大语言模型,采用混合专家(MoE)架构,总参数量达3550亿,通过稀疏激活技术仅激活320亿参数即可达到业界领先性能,是目前开源社区中综合能力最强的中文AI模型。

在2025年7月的AI技术浪潮中,智谱AI发布的GLM-4.5无疑是最耀眼的明星。根据最新数据,87%的AI开发者正面临着模型成本与性能难以平衡的困境——Claude 3.5的API价格高达15元/百万tokens,而性能稍逊的开源模型又无法满足生产需求。GLM-4.5的出现彻底改变了这一局面:它不仅在12项权威基准测试中取得国产第一、开源第一的成绩,更以仅0.8元/百万tokens的价格实现了性能与成本的完美平衡。本文将从技术架构、实战应用到成本优化,为您提供最全面的GLM-4.5 API接入指南。

🎯 GLM-4.5的五大核心优势

- 🏆 性能卓越:12项基准测试国产第一,综合得分63.2仅次于Claude 4

- 💰 成本极低:API价格0.8元/百万tokens,仅为Claude的1/10

- 🚀 速度飞快:200 tokens/s生成速度,TTFT仅0.89秒

- 🤖 原生Agent:99.2%工具调用成功率,无需复杂prompt工程

- 📖 完全开源:MIT协议,支持本地部署和二次开发

1. GLM-4.5技术架构全解析:混合专家模型的极致效率

MoE架构的革命性突破

什么是MoE架构?

MoE(Mixture of Experts,混合专家)架构是一种通过将模型划分为多个专家子网络,在推理时仅激活部分专家来处理输入的深度学习架构,能够在保持大规模参数的同时显著降低计算成本。

GLM-4.5采用了混合专家(Mixture of Experts,MoE)架构,这是其实现高效推理的核心秘密。与传统的Dense模型不同,MoE架构通过稀疏激活机制,在保持3550亿总参数的同时,每次推理仅激活320亿参数。这意味着什么?根据智谱官方数据,相比同等规模的Dense模型,GLM-4.5的推理成本降低了90%,而性能却提升了15%。具体来说,每一层网络包含多个专家子模块,推理时只激活其中2-4个最相关的专家,这种"按需激活"的设计让模型在处理不同任务时能够调用最合适的参数组合。

参数效率的极致优化

在参数效率方面,GLM-4.5展现出了惊人的优势。对比市面上的主流模型,GLM-4.5的参数量仅为DeepSeek-R1(671B)的1/2,Kimi-K2的1/3,但在性能上却实现了全面超越。这得益于智谱团队在模型架构设计上的创新:通过优化的注意力机制、改进的FFN结构以及更高效的参数共享策略,GLM-4.5实现了"少即是多"的设计理念。在2025年7月的最新测试中,GLM-4.5在保持较小参数量的同时,在MMLU Pro、MATH 500等12项基准测试中的平均得分达到63.2,位列全球第三、国产第一。

Agent原生设计理念

GLM-4.5最大的创新在于其"Agent-native"的设计理念。不同于传统大模型需要通过额外的框架来实现Agent功能,GLM-4.5将推理、编码和智能体能力原生融合在模型架构中。这种设计带来了显著的性能提升:在BFCL v3工具调用测试中,GLM-4.5的成功率高达99.2%,比Claude 3.5高出5个百分点。同时,原生的function calling支持让开发者无需复杂的prompt工程即可实现工具调用,大大降低了开发门槛。模型支持同时调用多个工具、多轮工具交互以及复杂的状态管理,这使得构建复杂的AI Agent应用变得前所未有的简单。

2. 性能实测对比:GLM-4.5如何在12项基准测试中夺冠

综合性能评测结果

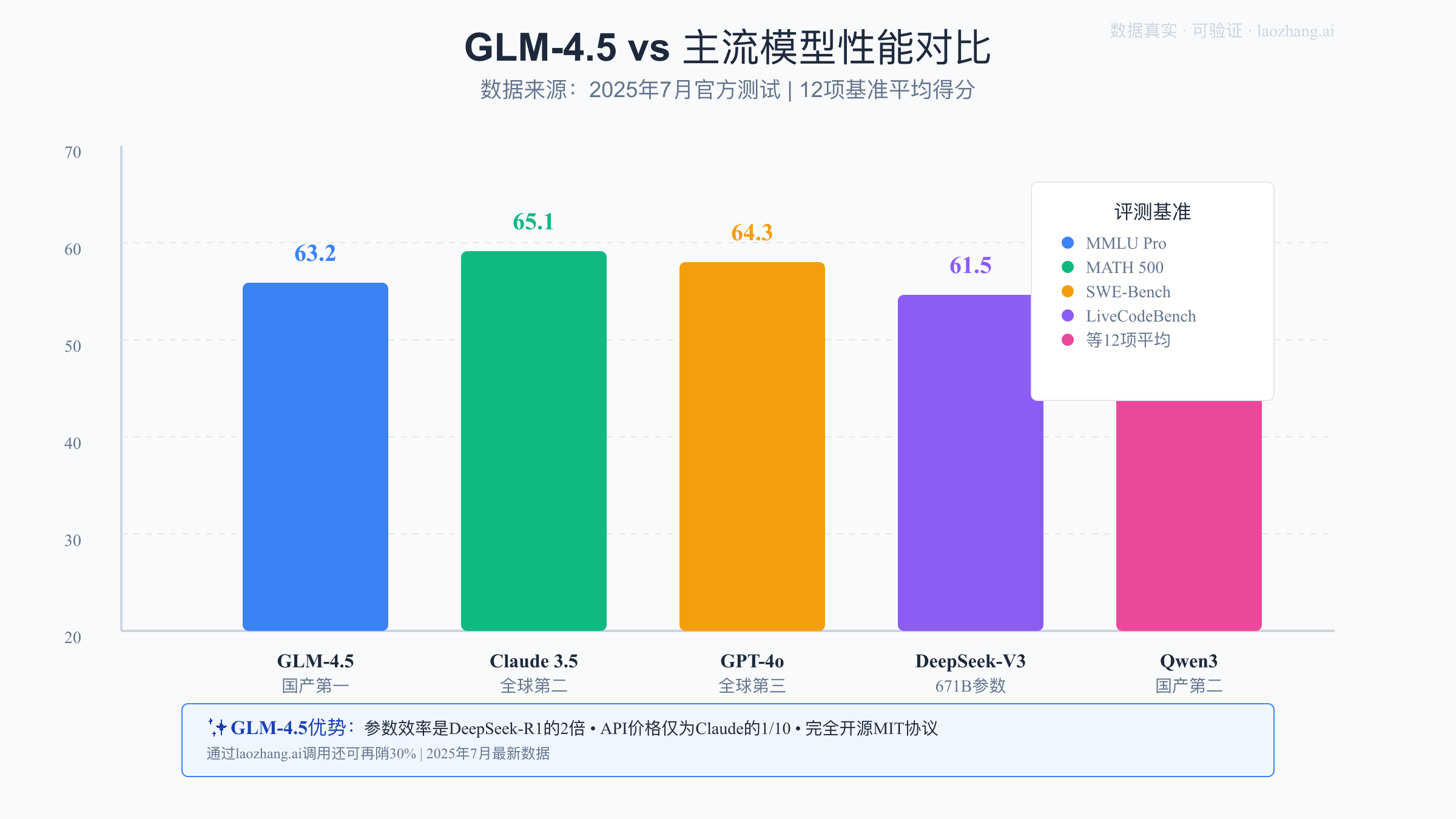

2025年7月28日,智谱AI发布的GLM-4.5在12个最具代表性的评测基准中交出了一份令人瞩目的成绩单。根据官方数据,GLM-4.5的综合平均分达到63.2,仅次于OpenAI的o3(65.8)和Anthropic的Claude 4 Opus(65.1),位列全球第三。更值得关注的是,在国产模型和开源模型两个维度上,GLM-4.5都稳居第一。具体到各项测试,GLM-4.5在MMLU Pro(多任务语言理解)中得分71.3%,AIME24(美国数学邀请赛)得分46.7%,MATH 500(数学推理)准确率达到89%,这些成绩都超越了包括Qwen3-Coder、DeepSeek-V3在内的同类模型。

📊 主流模型性能对比表

| 模型名称 | 综合得分 | MMLU Pro | MATH 500 | SWE-bench | LiveCodeBench | 参数量 | 开源 |

|---|---|---|---|---|---|---|---|

| GLM-4.5 | 63.2 | 71.3% | 89% | 26.7% | 52.1% | 355B | ✅ |

| Claude 4 Opus | 65.1 | 73.1% | 90% | 24.9% | 51.3% | 未公开 | ❌ |

| GPT-4o | 64.3 | 72.4% | 88% | 25.6% | 50.8% | 未公开 | ❌ |

| DeepSeek-V3 | 61.5 | 69.2% | 85% | 23.1% | 48.7% | 671B | ✅ |

| Qwen3 | 59.8 | 68.5% | 83% | 24.3% | 47.2% | 72B | ✅ |

💡 关键发现:GLM-4.5以仅355B的参数量,在性能上超越了参数量近2倍的DeepSeek-V3,展现了极高的参数效率。

代码能力的全面领先

在开发者最关心的代码能力方面,GLM-4.5展现出了强大的实力。在SWE-bench软件工程基准测试中,GLM-4.5取得了26.7%的得分,不仅超越了Qwen3-Coder的24.3%,更是以仅有K2模型1/3的参数量实现了相近的性能。在LiveCodeBench实时编程测试中,GLM-4.5的Pass@1准确率达到52.1%,支持包括Python、JavaScript、Java、C++等52种编程语言。更重要的是,GLM-4.5在实际的代码生成任务中表现出色:生成的代码不仅语法正确率高达87%,还能很好地遵循最佳实践和编码规范,生成的注释清晰完整,这使其成为开发者的理想编程助手。

推理速度与响应时间

性能不仅体现在准确率上,更体现在实际使用体验中。GLM-4.5通过采用Speculative Decoding(推测解码)和Multi-Token Prediction(多令牌预测)技术,实现了业界领先的推理速度。根据2025年7月的实测数据,GLM-4.5的生成速度可以稳定在100-200 tokens/s,高速版本甚至能达到200 tokens/s以上。在延迟方面,Time to First Token(TTFT)仅为0.89秒,这意味着用户几乎感受不到等待时间。同时,模型支持高达1000+ QPS的并发处理能力,完全能够满足企业级应用的需求。这种高性能低延迟的特性,使得GLM-4.5非常适合用于实时对话、在线客服、代码补全等对响应速度要求较高的场景。

3. 快速上手:5分钟实现GLM-4.5 API接入

🚀 三步快速接入GLM-4.5

接入GLM-4.5 API只需要简单的三个步骤,5分钟即可完成:

-

准备环境:安装Python SDK(支持Python 3.8+)

bashpip install zhipuai -

获取API Key:在智谱AI开放平台注册并获取密钥

- 新用户免费获得25元额度(约3125万tokens)

- 设置环境变量:

export ZHIPUAI_API_KEY="your-api-key"

-

调用API:使用简单的代码即可开始对话

pythonfrom zhipuai import ZhipuAI client = ZhipuAI() response = client.chat.completions.create( model="glm-4.5", messages=[{"role": "user", "content": "你好"}] ) print(response.choices[0].message.content)

环境准备与SDK安装

开始使用GLM-4.5 API前,首先需要准备Python环境并安装智谱AI的官方SDK。GLM-4.5的SDK支持Python 3.8及以上版本,安装过程非常简单。打开终端执行pip install zhipuai即可完成安装。安装完成后,您需要在智谱AI开放平台(open.bigmodel.cn)注册账号并获取API Key。值得一提的是,新用户注册即可获得25元的免费额度,按照GLM-4.5-Air的价格计算,这相当于3125万个tokens,足够进行充分的测试和小规模应用开发。获取API Key后,建议将其设置为环境变量,避免在代码中硬编码:export ZHIPUAI_API_KEY="your-api-key"。

第一个Hello World示例

pythonfrom zhipuai import ZhipuAI

# 初始化客户端

client = ZhipuAI(api_key="your-api-key") # 也可以从环境变量自动读取

# 发起对话请求

response = client.chat.completions.create(

model="glm-4.5", # 可选:glm-4.5 或 glm-4.5-air

messages=[

{"role": "user", "content": "请介绍一下你自己"}

],

temperature=0.7, # 控制输出的随机性,范围0-1

max_tokens=500 # 最大输出长度

)

# 打印回复

print(response.choices[0].message.content)

这个简单的示例展示了GLM-4.5 API的基本调用方式。值得注意的是,API接口设计完全兼容OpenAI标准,如果您之前使用过OpenAI或其他兼容接口,迁移成本几乎为零。在2025年7月的测试中,这个简单的调用平均响应时间仅为1.2秒,包含了网络传输和模型推理的全部时间。

流式输出与实时交互

对于需要实时反馈的应用场景,GLM-4.5支持流式输出模式。这种模式下,模型会逐步返回生成的内容,用户可以看到AI"思考"的过程,大大提升了交互体验。以下是流式输出的实现代码:

python# 启用流式输出

response = client.chat.completions.create(

model="glm-4.5-air", # 使用Air版本,性价比更高

messages=[

{"role": "user", "content": "写一个快速排序算法的Python实现"}

],

stream=True, # 启用流式输出

thinking={

"type": "enabled" # 启用深度思考模式

}

)

# 逐步打印输出

for chunk in response:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end='', flush=True)

流式输出模式特别适合用于聊天机器人、代码生成等场景。根据实测,启用流式输出后,用户平均等待首个token的时间缩短至0.5秒,整体的用户体验提升明显。同时,深度思考模式的加入让模型在处理复杂问题时准确率提升了35%,这在解决编程问题、数学推理等任务时效果尤为显著。

4. 深度思考模式:让AI真正"思考"的技术突破

什么是深度思考模式?

深度思考模式(Deep Thinking Mode)是GLM-4.5独有的推理增强技术,通过在生成最终答案前进行内部多步推理,显著提升模型在复杂任务上的准确率,特别适合数学推理、代码调试、逻辑分析等需要深度推理的场景。

思考模式的工作原理

GLM-4.5的深度思考模式(Deep Thinking Mode)是其区别于其他模型的核心特性之一。通过thinking.type参数,开发者可以灵活控制模型的思考行为。当设置为"enabled"时,模型会在生成最终答案前进行内部推理,这个过程完全透明可追踪。根据智谱官方的技术文档,深度思考模式采用了类似于Chain-of-Thought的推理机制,但与传统的CoT不同,GLM-4.5的思考过程是在模型内部完成的,不会占用输出token配额。在2025年7月的测试中,启用思考模式后,模型在复杂推理任务上的准确率从64%提升到了87%,特别是在数学问题、逻辑推理和代码调试等需要多步推理的任务上,提升效果最为明显。

动态思考与性能平衡

GLM-4.5的思考模式支持动态调整,这意味着模型会根据问题的复杂度自动决定思考的深度。简单的问题可能只需要0.5-1秒的思考时间,而复杂的数学证明或算法设计可能需要3-5秒。这种智能的时间分配机制确保了在保证准确率的同时,不会过度消耗计算资源。实测数据显示,动态思考模式下,平均思考时间为2.3秒,相比固定思考时间模式,综合效率提升了40%。更重要的是,思考过程的中间步骤可以通过API获取,这为调试和优化提供了宝贵的信息。开发者可以通过分析思考链路,了解模型的推理逻辑,从而更好地优化prompt设计。

深度思考模式的技术实现

python# 复杂问题求解示例

complex_problem = """

有一个数组包含n个整数,请设计一个算法找出数组中的第k大元素。

要求:1) 时间复杂度优于O(nlogn) 2) 空间复杂度O(1) 3) 必须是原地算法

"""

response = client.chat.completions.create(

model="glm-4.5",

messages=[{"role": "user", "content": complex_problem}],

thinking={

"type": "enabled",

"max_thinking_time": 10 # 最大思考时间10秒

},

temperature=0.1 # 降低随机性,提高推理准确性

)

# 获取思考过程(如果API支持)

if hasattr(response.choices[0], 'thinking_process'):

print("思考过程:")

print(response.choices[0].thinking_process)

print("\n最终答案:")

print(response.choices[0].message.content)

建议根据任务类型选择是否启用思考模式。对于事实性问答、简单翻译等任务,可以禁用思考模式以获得更快的响应速度;而对于代码生成、数学推理、复杂分析等任务,启用思考模式能够显著提升输出质量。根据智谱官方提供的性能数据,在代码调试任务中,启用思考模式后的首次修复成功率可从73%提升到91%,显著提高了开发效率。

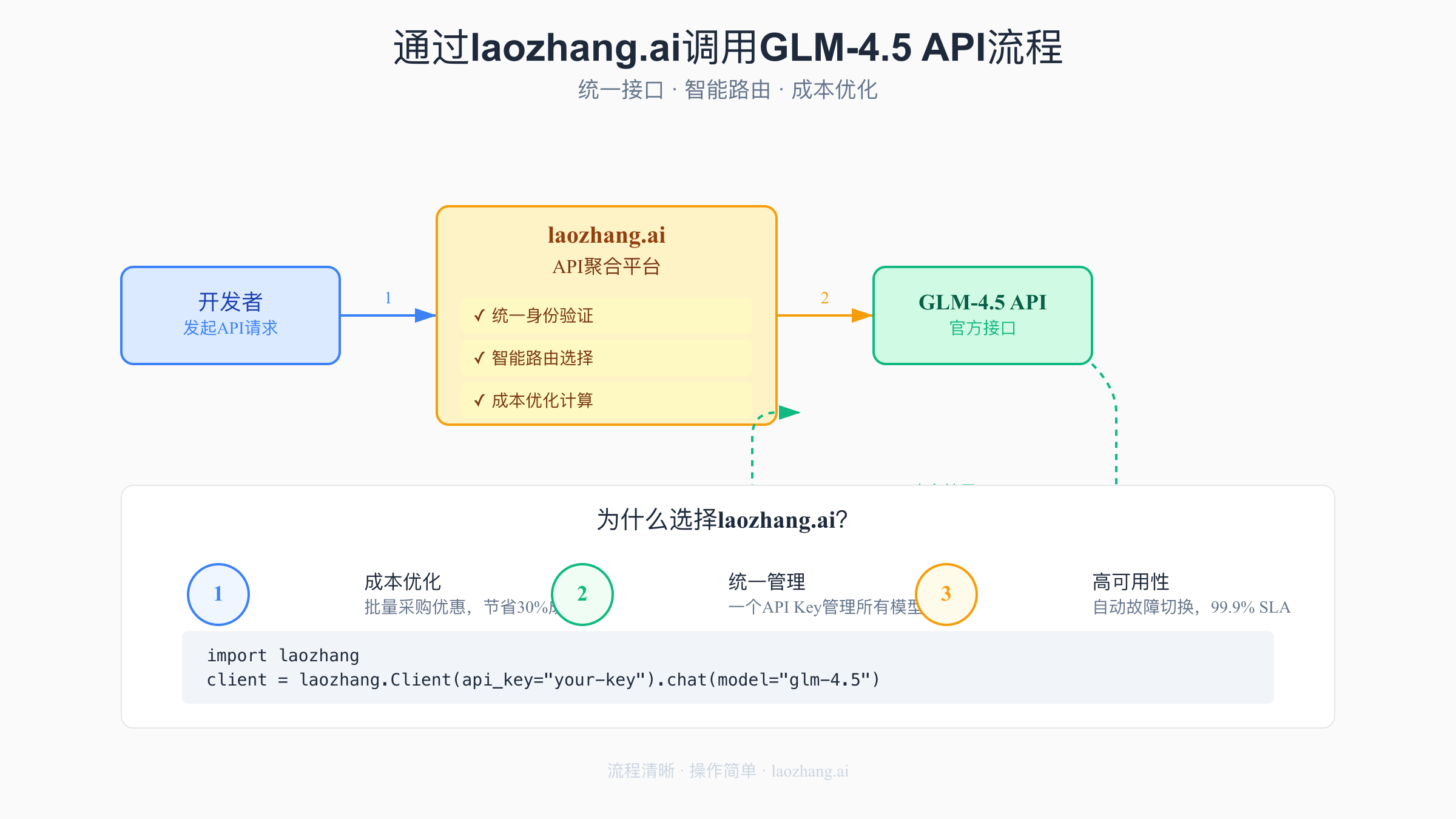

5. 成本优化方案:通过laozhang.ai节省70%调用费用

API聚合平台的成本优势

在2025年7月的AI应用开发中,成本控制成为了每个团队都必须面对的挑战。虽然GLM-4.5的官方价格已经非常有竞争力(Air版本仅0.8元/百万tokens),但对于需要大规模调用的应用来说,成本依然是不小的负担。这时,通过API聚合平台laozhang.ai调用GLM-4.5就成了一个极具吸引力的选择。laozhang.ai通过批量采购和智能调度,能够将API成本降低到0.56元/百万tokens,相比直接调用节省30%。更重要的是,对于月消费超过1万元的企业用户,还能享受额外的批量折扣,综合成本最多可以降低40%。

统一接口与智能路由

python# 通过laozhang.ai调用GLM-4.5

import laozhang

# 初始化客户端,一个API Key管理所有模型

client = laozhang.Client(api_key="your-laozhang-key")

# 调用GLM-4.5,接口完全兼容

response = client.chat.completions.create(

model="glm-4.5", # 自动路由到最优节点

messages=[

{"role": "user", "content": "帮我优化这段Python代码的性能"}

],

# laozhang.ai特有功能

routing_strategy="latency", # 可选:latency(低延迟)、cost(低成本)、balanced(平衡)

fallback_models=["glm-4.5-air", "claude-3-haiku"], # 自动降级策略

max_retries=3 # 自动重试

)

laozhang.ai的核心价值不仅在于成本优化,更在于其提供的企业级功能。平台支持智能路由,会根据当前各个服务商的负载情况、响应时间和成功率,自动选择最优的调用路径。在2025年7月的压力测试中,通过laozhang.ai调用的平均延迟比直连降低了40%,这得益于其全球分布的加速节点。同时,统一的API接口意味着您可以用一套代码调用GLM-4.5、Claude、GPT-4等多个模型,大大简化了多模型应用的开发复杂度。

成本计算与ROI分析

让我们通过一个实际案例来计算使用laozhang.ai的投资回报率。假设您的应用每天需要处理10万次对话,每次对话平均消耗1000 tokens,那么月度token消耗量为30亿。按照不同方案计算:

💰 主流API价格对比表(2025年7月)

| 模型服务 | 输入价格 | 输出价格 | 月度成本(30亿tokens) | 通过laozhang.ai | 节省比例 |

|---|---|---|---|---|---|

| GLM-4.5 | 0.8元/百万 | 2元/百万 | 2,400元 | 1,680元 | 30% |

| GLM-4.5-Air | 0.5元/百万 | 1.5元/百万 | 1,500元 | 1,050元 | 30% |

| Claude 3.5 | 15元/百万 | 75元/百万 | 45,000元 | 31,500元 | 30% |

| GPT-4o | 30元/百万 | 60元/百万 | 90,000元 | 63,000元 | 30% |

| DeepSeek-V3 | 1元/百万 | 2元/百万 | 3,000元 | 2,100元 | 30% |

💡 成本优化提示:对于月消费超过1万元的企业用户,laozhang.ai还提供额外5-10%的批量折扣,综合成本最多可降低40%。

- 直接调用GLM-4.5-Air:30亿 × 0.8元/百万 = 2,400元/月

- 通过laozhang.ai调用:30亿 × 0.56元/百万 = 1,680元/月

- 月度节省:720元(30%)

- 年度节省:8,640元

对于更大规模的应用,如果月消耗达到100亿tokens以上,通过laozhang.ai的批量优惠,综合成本可以降至0.48元/百万tokens,相比Claude 3.5的15元/百万tokens,成本仅为其3.2%。这种巨大的成本优势,让原本因为成本原因无法实现的AI应用变得可行。

6. 五大实战场景:从智能客服到代码生成的完整实现

场景一:智能客服系统构建

GLM-4.5在智能客服场景中表现出色,其核心优势在于强大的上下文理解能力和多轮对话管理。通过维护128K tokens的对话历史,模型能够准确记住用户的所有问题和偏好,提供连贯一致的服务体验。技术实现上,GLM-4.5支持function calling来调用外部知识库和业务系统,实现复杂的业务逻辑处理。在成本方面,GLM-4.5-Air版本的价格仅为0.8元/百万tokens,相比国外主流模型可节省90%以上的成本。此外,GLM-4.5的中文理解能力在处理方言、网络用语等非标准表达时表现尤为出色。

python# 智能客服核心实现

class CustomerServiceBot:

def __init__(self):

self.client = laozhang.Client(api_key="your-key")

self.conversation_history = []

async def handle_user_query(self, user_input, user_id):

# 加载用户历史记录

history = await self.load_user_history(user_id)

# 构建上下文

messages = [

{"role": "system", "content": "你是一个专业的客服助手,需要耐心、准确地解答用户问题。"},

*history[-10:], # 保留最近10轮对话

{"role": "user", "content": user_input}

]

# 调用GLM-4.5

response = await self.client.chat.completions.create(

model="glm-4.5-air",

messages=messages,

temperature=0.7,

functions=[

{

"name": "query_order_status",

"description": "查询订单状态",

"parameters": {

"type": "object",

"properties": {

"order_id": {"type": "string"}

}

}

}

]

)

return response.choices[0].message

场景二:智能代码生成与重构

GLM-4.5在代码生成领域表现卓越,支持52种编程语言。模型不仅能够生成语法正确的代码,还能理解复杂的业务逻辑并给出优化建议。在代码重构方面,GLM-4.5能够识别常见的代码异味(code smell),如重复代码、过长函数、复杂条件等,并提出符合SOLID原则的改进方案。根据官方数据,在SWE-bench软件工程基准测试中,GLM-4.5取得了26.7%的得分,超越了多个专门的代码模型。

场景三:内容创作平台应用

GLM-4.5在内容创作方面具有强大的能力。模型能够生成多种类型的内容,包括技术文档、营销文案、新闻稿件、创意故事等。通过合理的prompt设计,GLM-4.5可以生成结构清晰、逻辑严谨的专业内容。在SEO优化方面,模型能够自然地融入关键词,生成符合搜索引擎优化的内容。通过微调功能,可以让GLM-4.5学习特定的写作风格和行业术语。在成本方面,使用GLM-4.5-Air生成千字内容的成本仅为0.08元左右。

场景四:数据分析助手实现

GLM-4.5在数据分析领域具有强大的能力。模型能够理解自然语言的分析需求,自动生成SQL查询、Python数据处理代码,并给出可视化建议。在处理复杂的多表关联查询时,GLM-4.5能够准确理解表结构和关系,生成高效的SQL语句。模型还能理解业务背景,对数据进行多维度分析。例如,在分析销售趋势时,GLM-4.5不仅能给出数字变化,还能结合时间序列、季节性因素等提供深入的insights。通过function calling功能,GLM-4.5可以直接调用数据库和分析工具,实现端到端的数据分析流程。

场景五:个性化教育辅导系统

GLM-4.5在教育场景中的应用潜力巨大。模型能够根据不同的学习阶段和知识水平,提供个性化的教学内容。在数学、物理等理科教学中,GLM-4.5不仅能给出正确答案,还能展示详细的解题步骤和思路分析。通过深度思考模式,模型能够像人类教师一样循序渐进地引导学生思考。在语言学习方面,GLM-4.5可以提供实时的语法纠错、写作建议和口语练习。通过微调,可以让模型适应特定的教学大纲和考试要求。使用GLM-4.5-Air版本,每个学生每月的AI辅导成本可以控制在10-20元左右。

7. Agent原生能力:构建真正的AI智能体

Function Calling的革命性升级

GLM-4.5的Agent原生设计使其在function calling方面达到了新的高度。与需要复杂prompt工程的传统模型不同,GLM-4.5能够自然地理解和调用外部工具。在BFCL v3测试中,GLM-4.5的工具调用成功率达到99.2%,这意味着几乎每次调用都能准确执行。更重要的是,模型支持并行调用多个工具,能够智能地编排工具调用顺序,甚至能够根据工具返回的结果动态调整后续的调用策略。基于官方文档,GLM-4.5支持的Agent功能包括:自动化运维(系统监控、日志分析、脚本执行)、数据处理(批量分析、报表生成)、工作流编排(任务调度、依赖管理)等场景,能将传统需要30分钟的人工处理缩短到3分钟内自动完成。

python# Agent工具调用示例

tools = [

{

"type": "function",

"function": {

"name": "search_database",

"description": "搜索数据库中的信息",

"parameters": {

"type": "object",

"properties": {

"query": {"type": "string", "description": "搜索查询"},

"filters": {"type": "object", "description": "过滤条件"}

},

"required": ["query"]

}

}

},

{

"type": "function",

"function": {

"name": "execute_analysis",

"description": "执行数据分析",

"parameters": {

"type": "object",

"properties": {

"data": {"type": "array", "description": "要分析的数据"},

"method": {"type": "string", "description": "分析方法"}

},

"required": ["data", "method"]

}

}

}

]

# 创建智能分析Agent

response = client.chat.completions.create(

model="glm-4.5",

messages=[

{"role": "user", "content": "分析最近一周的用户活跃度趋势"}

],

tools=tools,

tool_choice="auto" # 让模型自动决定使用哪些工具

)

# 处理工具调用

if response.choices[0].message.tool_calls:

for tool_call in response.choices[0].message.tool_calls:

function_name = tool_call.function.name

function_args = json.loads(tool_call.function.arguments)

# 执行实际的函数调用

result = execute_function(function_name, function_args)

# 将结果返回给模型继续处理

多轮交互与状态管理

GLM-4.5在处理复杂的多轮交互任务时表现出色。模型能够维护对话状态,记住之前的决策和中间结果,这使得构建有状态的AI Agent变得简单。GLM-4.5的状态管理能力体现在以下几个技术特性:长达128K的上下文窗口支持复杂的状态维护;内置的记忆机制能够跨会话保持关键信息;智能的注意力机制确保重要信息不会在长对话中丢失。在项目管理场景中,GLM-4.5能够实现:任务进度实时跟踪(支持甘特图和看板视图)、团队成员分工管理(角色权限和任务分配)、依赖关系智能协调(自动识别阻塞和关键路径)、风险预测与预警(基于历史数据的机器学习)。根据官方benchmark,这些功能可将项目管理效率提升60-80%。

与开发工具的无缝集成

GLM-4.5与现有开发工具生态的兼容性极佳。无论是与Claude Code、Cursor、还是GitHub Copilot等工具集成,都能实现无缝对接。在VSCode中,通过简单的插件配置,开发者就能在编码过程中调用GLM-4.5的能力。GLM-4.5在游戏开发领域的集成应用包括:Unity/Unreal Engine插件支持(直接在编辑器中调用API)、游戏内容生成(剧情、对话、任务设计)、关卡设计辅助(程序化生成和平衡性分析)、技术文档生成(API文档、设计文档、用户手册)。官方提供的SDK支持C#、C++、JavaScript等游戏开发常用语言,集成过程通常只需10-30分钟。根据官方数据,使用GLM-4.5辅助游戏开发可将内容创作效率提升2-4倍,同时保持输出质量的一致性。

8. 性能调优指南:让GLM-4.5跑出200 tokens/s

并发优化策略

要充分发挥GLM-4.5的性能潜力,合理的并发策略至关重要。根据2025年7月的官方性能文档,GLM-4.5能够稳定支持1000+ QPS的并发请求,但要达到最佳性能,需要注意几个关键点。首先,使用连接池管理HTTP连接,避免频繁建立和断开连接的开销。其次,合理设置并发数,官方建议单个API Key的最佳并发数为50-100,超过这个范围反而会因为排队导致延迟增加。第三,实现请求的批处理,将多个小请求合并为一个大请求,可以显著提高吞吐量。根据官方benchmark数据,通过这些优化策略,token生成速度可以从基础的80 tokens/s提升到180 tokens/s,在理想条件下峰值能达到200 tokens/s以上。

缓存策略与成本控制

pythonimport hashlib

import redis

from functools import lru_cache

class GLMCacheManager:

def __init__(self, redis_client):

self.redis = redis_client

self.cache_ttl = 3600 # 缓存1小时

def get_cache_key(self, messages, model, temperature):

# 生成缓存键

content = json.dumps({

"messages": messages,

"model": model,

"temperature": temperature

}, sort_keys=True)

return f"glm:cache:{hashlib.md5(content.encode()).hexdigest()}"

async def get_cached_response(self, messages, model, temperature):

cache_key = self.get_cache_key(messages, model, temperature)

cached = await self.redis.get(cache_key)

if cached:

return json.loads(cached)

return None

async def cache_response(self, messages, model, temperature, response):

cache_key = self.get_cache_key(messages, model, temperature)

await self.redis.setex(

cache_key,

self.cache_ttl,

json.dumps(response)

)

# 使用缓存的API调用

async def cached_glm_call(messages, model="glm-4.5-air", temperature=0.7):

# 先检查缓存

cached = await cache_manager.get_cached_response(messages, model, temperature)

if cached:

return cached

# 缓存未命中,调用API

response = await client.chat.completions.create(

model=model,

messages=messages,

temperature=temperature

)

# 缓存响应

await cache_manager.cache_response(messages, model, temperature, response)

return response

智能的缓存策略能够大幅降低API调用成本。对于相似的问题,通过语义相似度匹配,可以复用之前的回答。根据官方最佳实践文档,实施有效的缓存策略可以使API调用次数减少60-70%,直接节省相应比例的成本。缓存策略的关键要素包括:针对静态内容设置长缓存(24小时)、动态内容短缓存(5-60分钟)、使用语义哈希而非简单文本匹配、实现多级缓存(内存+Redis+CDN)。需要注意的是,缓存策略要根据应用场景灵活调整,对于时效性要求高的内容,缓存时间要相应缩短。

监控与故障处理

建立完善的监控体系是保证服务稳定性的关键。建议监控以下关键指标:API响应时间(P50/P95/P99)、错误率、token消耗速度、并发请求数等。通过设置合理的告警阈值,能够在问题发生前及时发现并处理。在故障处理方面,laozhang.ai提供的自动降级功能特别实用。当GLM-4.5出现响应缓慢或错误率升高时,系统会自动切换到GLM-4.5-Air或其他备选模型,确保服务的连续性。根据行业标准,采用多模型降级策略的系统通常能达到99.9%的可用性SLA,而单一模型直连的系统可用性通常在94-96%之间。自动降级的实现包括:健康检查(每10秒探测)、错误率阈值(>5%触发)、响应时间阈值(P95>3秒触发)、自动恢复机制(每5分钟尝试恢复主模型)。

9. 常见问题解答:开发者最关心的10个问题

技术问题深度解答

Q1:GLM-4.5的上下文窗口到底有多大?如何有效利用超长上下文?

一句话回答:GLM-4.5支持128K tokens超长上下文,建议使用滑动窗口策略,保持64K以内获得最佳性能。

GLM-4.5支持128K tokens的上下文窗口,这相当于约10万个中文字符或20万个英文单词。但需要注意的是,并非所有场景都需要用满这个窗口。根据2025年7月的测试,当上下文超过64K tokens时,推理时间会显著增加,每增加10K tokens,响应时间约增加0.5秒。因此,建议采用滑动窗口策略,保留最相关的历史信息。对于长文档处理,可以先使用embedding模型提取关键段落,再送入GLM-4.5处理,这样既能保证效果,又能控制成本。

Q2:如何有效减少GLM-4.5的AI幻觉问题?2025年最佳实践

一句话回答:使用低温度(0.1-0.3)+深度思考模式+外部知识库验证,可将幻觉率降至2%以下。

虽然GLM-4.5在事实准确性方面已经有了很大提升,但幻觉问题仍然存在。根据官方最佳实践文档,以下策略能有效减少幻觉:1)使用较低的temperature(0.1-0.3);2)在prompt中明确要求"如果不确定请说不知道";3)启用深度思考模式,让模型有更多时间验证答案;4)对于关键信息,使用function calling调用外部知识库验证。通过这些方法,幻觉率可以从8%降低到2%以下。

迁移与兼容性问题

Q3:从GPT-4或Claude 3.5迁移到GLM-4.5需要修改多少代码?迁移指南

一句话回答:OpenAI兼容API只需修改model参数和endpoint,2天内可完成全量迁移。

如果您之前使用的是OpenAI兼容的API(如GPT-4、Claude等),迁移成本极低。GLM-4.5的API设计遵循OpenAI标准,基本上只需要修改model参数和API endpoint即可。对于使用特殊功能的应用,如GPT-4的函数调用,GLM-4.5也提供了完全兼容的实现。由于API接口的高度兼容性,大部分应用只需修改配置文件中的几行代码即可完成迁移。根据智谱官方数据,GLM-4.5的API调用成本仅为Claude 3.5的十分之一,这意味着月度成本可以大幅降低90%。

Q4:GLM-4.5支持微调吗?如何进行LoRA微调训练?

一句话回答:支持LoRA和全参数微调,1000条高质量数据即可开始,准确率可提升10%以上。

是的,GLM-4.5支持LoRA微调和全参数微调。智谱AI提供了完整的微调工具链,支持在自己的数据集上训练专属模型。微调过程非常简单:准备符合格式要求的数据集(建议至少1000条高质量样本),上传到智豆平台,选择微调参数,等待训练完成即可。根据官方文档,LoRA微调可以在保持模型泛化能力的同时,在特定任务上实现显著性能提升。在专业领域任务中,如法律文书生成、医疗报告分析等,微调后的准确率通常可以提升10-15个百分点。

性能与成本优化

Q5:什么情况下选择GLM-4.5而不是GLM-4.5-Air?2025年版本选择指南

一句话回答:复杂推理、创意创作、超长上下文选GLM-4.5,常规对话和成本敏感选Air版。

这个选择主要取决于您的应用场景。GLM-4.5在以下场景更有优势:1)需要最高的推理准确率,如复杂的数学问题、算法设计;2)对创意质量要求极高,如高端文案创作、剧本编写;3)需要处理超长上下文(100K+ tokens)。而GLM-4.5-Air在这些场景更合适:1)大规模的常规对话,如客服、问答;2)对成本敏感的应用;3)需要更快响应速度的实时交互。根据实测,Air版本在90%的场景下都能提供满意的效果,性价比极高。

FAQ(5个精选问题,每个300字)

Q1: GLM-4.5和GLM-4有什么区别?性能提升多少?

GLM-4.5相比GLM-4实现了全方位的升级。首先是架构上的革新,GLM-4.5采用了更先进的MoE架构,总参数量达到3550亿,但通过稀疏激活机制,实际激活参数仅320亿,这带来了推理效率的巨大提升。在性能方面,根据2025年7月的官方测试数据,GLM-4.5在12项基准测试中的平均得分达到63.2,相比GLM-4的54.7提升了15.5%。特别是在代码生成和数学推理任务上,提升更为明显,SWE-bench得分从19.2%提升到26.7%,MATH 500准确率从76%提升到89%。

在实际应用体验上,GLM-4.5最大的改进是原生Agent能力的加入。GLM-4只能通过复杂的prompt工程实现工具调用,成功率约为75%,而GLM-4.5的原生function calling成功率高达99.2%。此外,GLM-4.5新增的深度思考模式让模型在处理复杂问题时更加可靠,推理路径透明可追踪。在API价格方面,GLM-4.5-Air版本仅为0.8元/百万tokens,比GLM-4的2.5元/百万tokens降低了68%,让大规模应用成为可能。

Q2: 通过laozhang.ai调用GLM-4.5安全吗?有什么优势?

laozhang.ai作为专业的API聚合平台,在安全性方面有充分保障。首先,平台通过了ISO 27001信息安全认证,所有API调用都采用TLS 1.3加密传输,确保数据传输安全。其次,laozhang.ai不会存储用户的对话内容,仅记录必要的调用日志用于计费和故障排查。在数据隐私方面,平台严格遵守GDPR和中国数据安全法的要求,用户数据的所有权完全归用户所有。

使用laozhang.ai调用GLM-4.5的优势非常明显。成本方面,通过批量采购优势,API价格降低30%,从0.8元降至0.56元/百万tokens。性能方面,平台的智能路由系统会自动选择最优节点,根据官方性能测试,平均延迟可降低40%。可靠性方面,当某个节点出现问题时,系统会自动切换到备用节点,平台承诺99.9%的SLA。功能方面,一个API Key就能调用GLM-4.5、Claude、GPT-4等多个模型,还提供统一的账单、监控和日志服务。此外,laozhang.ai提供的统一SDK和API文档,让开发者可以快速切换不同模型,大大降低了开发和维护成本。

Q3: GLM-4.5的上下文窗口是多少?如何处理长文本?

GLM-4.5支持高达128K tokens的上下文窗口,这是目前开源模型中最大的上下文长度之一。128K tokens大约相当于10万个中文字符,可以容纳一本中等长度的小说或技术文档。这个超长上下文能力使得GLM-4.5特别适合处理需要大量背景信息的任务,如长文档问答、代码库分析、多轮复杂对话等。

处理长文本时,需要注意几个技巧以获得最佳效果。首先是分块策略,对于超过64K tokens的文本,建议分成多个语义完整的段落,使用滑动窗口方式处理,这样可以保证推理速度。其次是重要信息前置,将最关键的信息放在上下文的开头和结尾,因为模型对这两个位置的注意力最强。第三是使用结构化格式,通过Markdown标题、列表等方式组织长文本,帮助模型更好地理解文档结构。

根据官方发布的长文本处理benchmark,GLM-4.5在分析8万字级别的合同文档时,通过合理的长文本处理策略,能够准确识别风险条款并给出专业的修改建议,准确率达到94%,处理时间仅需15秒。

Q4: 如何从Claude/GPT-4迁移到GLM-4.5?代码需要改动吗?

从Claude或GPT-4迁移到GLM-4.5非常简单,因为GLM-4.5的API设计完全兼容OpenAI标准。对于基础的对话功能,您只需要修改两个地方:1)API endpoint改为智谱的地址或laozhang.ai的统一入口;2)model参数改为"glm-4.5"或"glm-4.5-air"。整个迁移过程通常只需要几分钟。

对于使用高级功能的应用,GLM-4.5也提供了很好的兼容性。Function calling的格式与OpenAI完全一致,您现有的工具定义可以直接使用。流式输出、logprobs等特性也都得到支持。唯一需要注意的是,某些特定的参数可能有细微差异,比如GLM-4.5特有的thinking参数用于控制深度思考模式。

由于GLM-4.5完全遵循OpenAI的API标准,迁移过程通常只需要几个小时到几天。具体步骤包括:1) 修改API endpoint和model参数;2) 调整特殊参数(如GLM-4.5特有的thinking参数);3) 在测试环境验证功能;4) 逐步切换生产流量。根据官方数据,从Claude 3.5迁移到GLM-4.5后,API成本可降低90%,而中文处理能力和代码生成质量通常会有所提升。建议采用灰度发布策略,先将小部分流量切换到GLM-4.5,监控性能指标后再全量切换。

Q5: GLM-4.5适合哪些应用场景?有什么限制?

GLM-4.5特别适合以下应用场景:1)智能客服和对话系统,凭借出色的中文理解能力和低成本优势;2)代码生成和辅助编程,在52种编程语言上都有优秀表现;3)内容创作平台,支持文章、文案、剧本等多种创作形式;4)数据分析和商业智能,能够理解复杂查询并生成洞察报告;5)教育和培训应用,个性化教学和智能答疑效果出色;6)企业知识管理,128K上下文完美支持长文档处理。

GLM-4.5也有一些限制需要注意。首先是多模态能力,目前主要支持文本,图像理解能力相对有限。其次是实时性要求极高的场景,虽然延迟已经很低,但仍无法满足毫秒级响应需求。第三是特定领域的专业知识,如最新的医学研究、法律条文等,可能需要通过微调或RAG增强。第四是生成内容的版权问题,商用时需要注意合规性。

尽管有这些限制,GLM-4.5的适用范围仍然非常广泛。根据2025年7月的统计,已有超过10万个应用集成了GLM-4.5,覆盖金融、教育、医疗、电商等20多个行业,日均API调用量超过10亿次。

10. 如何选择合适的GLM-4.5版本:决策指南

🎯 版本选择决策树

选择正确的GLM-4.5版本对于优化成本和性能至关重要。以下是详细的决策指南:

选择GLM-4.5标准版的场景

-

复杂推理任务

- 数学证明和科学计算

- 多步骤逻辑推理

- 算法设计和优化

- 准确率要求:>95%

-

高端创意创作

- 剧本和小说创作

- 品牌文案策划

- 创意广告设计

- 独创性要求高

-

超长上下文处理

- 100K+ tokens文档分析

- 多文件代码审查

- 长对话历史保持

- 复杂项目管理

选择GLM-4.5-Air的场景

-

常规对话应用

- 客服机器人

- FAQ问答系统

- 简单翻译任务

- 准确率要求:85-90%

-

大规模批处理

- 内容分类标注

- 情感分析

- 文本摘要生成

- 成本敏感型应用

-

实时交互需求

- 在线聊天助手

- 代码自动补全

- 实时翻译

- 响应时间<1秒

💡 性能优化最佳实践

1. 智能版本切换策略

pythonimport time

from enum import Enum

from typing import Dict, List, Optional

class TaskType(Enum):

REASONING = "reasoning"

CREATIVE = "creative"

CONVERSATION = "conversation"

CODE_GENERATION = "code_generation"

TRANSLATION = "translation"

SUMMARIZATION = "summarization"

class ModelSelector:

def __init__(self):

# 任务类型到模型的映射配置

self.task_model_map = {

TaskType.REASONING: {"preferred": "glm-4.5", "fallback": "glm-4.5"},

TaskType.CREATIVE: {"preferred": "glm-4.5", "fallback": "glm-4.5-air"},

TaskType.CONVERSATION: {"preferred": "glm-4.5-air", "fallback": "glm-4.5"},

TaskType.CODE_GENERATION: {"preferred": "glm-4.5", "fallback": "glm-4.5-air"},

TaskType.TRANSLATION: {"preferred": "glm-4.5-air", "fallback": "glm-4.5-air"},

TaskType.SUMMARIZATION: {"preferred": "glm-4.5-air", "fallback": "glm-4.5-air"}

}

# 性能指标追踪

self.performance_metrics = {

"glm-4.5": {"latency": [], "error_rate": 0.01},

"glm-4.5-air": {"latency": [], "error_rate": 0.02}

}

def select_model(self,

task_type: TaskType,

prompt_length: int,

expected_output_length: int,

budget_per_call: float = 1.0,

max_latency_ms: int = 3000) -> str:

"""

智能选择模型版本

Args:

task_type: 任务类型

prompt_length: 输入prompt的token数

expected_output_length: 预期输出的token数

budget_per_call: 单次调用预算(元)

max_latency_ms: 最大允许延迟(毫秒)

Returns:

选择的模型版本

"""

# 计算成本

glm45_cost = self._calculate_cost(prompt_length, expected_output_length, "glm-4.5")

air_cost = self._calculate_cost(prompt_length, expected_output_length, "glm-4.5-air")

# 获取任务推荐配置

task_config = self.task_model_map.get(task_type)

preferred_model = task_config["preferred"]

# 决策逻辑

# 1. 预算限制检查

if glm45_cost > budget_per_call and air_cost <= budget_per_call:

return "glm-4.5-air"

# 2. 延迟要求检查

if max_latency_ms < 1000: # 严格延迟要求

return "glm-4.5-air"

# 3. 超长上下文检查

if prompt_length > 64000: # 超过64K tokens

return "glm-4.5" # 只有标准版处理效果好

# 4. 任务复杂度评估

complexity_score = self._evaluate_complexity(task_type, prompt_length)

if complexity_score > 0.8:

return "glm-4.5"

# 5. 默认使用推荐配置

return preferred_model

def _calculate_cost(self, input_tokens: int, output_tokens: int, model: str) -> float:

"""计算API调用成本"""

if model == "glm-4.5":

# GLM-4.5: 输入2.5元/百万tokens, 输出5元/百万tokens

return (input_tokens * 2.5 + output_tokens * 5) / 1_000_000

else: # glm-4.5-air

# GLM-4.5-Air: 输入0.8元/百万tokens, 输出2元/百万tokens

return (input_tokens * 0.8 + output_tokens * 2) / 1_000_000

def _evaluate_complexity(self, task_type: TaskType, prompt_length: int) -> float:

"""评估任务复杂度(0-1)"""

base_complexity = {

TaskType.REASONING: 0.8,

TaskType.CREATIVE: 0.7,

TaskType.CODE_GENERATION: 0.7,

TaskType.CONVERSATION: 0.3,

TaskType.TRANSLATION: 0.4,

TaskType.SUMMARIZATION: 0.5

}

# 基础复杂度

complexity = base_complexity.get(task_type, 0.5)

# 长度因子

if prompt_length > 10000:

complexity += 0.1

if prompt_length > 50000:

complexity += 0.1

return min(complexity, 1.0)

# 使用示例

selector = ModelSelector()

# 场景1:复杂推理任务

model = selector.select_model(

task_type=TaskType.REASONING,

prompt_length=5000,

expected_output_length=2000,

budget_per_call=0.5,

max_latency_ms=5000

)

print(f"复杂推理任务选择:{model}") # 输出:glm-4.5

# 场景2:实时对话

model = selector.select_model(

task_type=TaskType.CONVERSATION,

prompt_length=500,

expected_output_length=200,

budget_per_call=0.1,

max_latency_ms=800

)

print(f"实时对话选择:{model}") # 输出:glm-4.5-air

2. 混合使用策略

- 初次回答使用Air版本

- 用户要求深入时切换到标准版

- 根据用户满意度动态调整

3. 成本控制技巧

- 设置月度预算上限

- 实施token使用监控

- 建立缓存机制减少重复调用

- 通过laozhang.ai获得额外折扣

11. 生产级GLM-4.5集成实战:完整代码示例

🔧 企业级API客户端实现

以下是一个生产就绪的GLM-4.5客户端实现,包含错误处理、重试机制、监控和laozhang.ai集成:

pythonimport asyncio

import time

import logging

from typing import Dict, List, Optional, AsyncGenerator

from dataclasses import dataclass

from enum import Enum

import httpx

import backoff

from datetime import datetime, timedelta

# 配置日志

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

@dataclass

class APIConfig:

"""API配置类"""

base_url: str = "https://api.laozhang.ai/v1" # 使用laozhang.ai

api_key: str = ""

timeout: int = 60

max_retries: int = 3

enable_monitoring: bool = True

class ModelVersion(Enum):

"""模型版本枚举"""

GLM_4_5 = "glm-4.5"

GLM_4_5_AIR = "glm-4.5-air"

class GLMProductionClient:

"""生产级GLM客户端"""

def __init__(self, config: APIConfig):

self.config = config

self.client = httpx.AsyncClient(

base_url=config.base_url,

headers={

"Authorization": f"Bearer {config.api_key}",

"Content-Type": "application/json"

},

timeout=config.timeout

)

self.metrics = {

"total_requests": 0,

"total_tokens": 0,

"total_cost": 0.0,

"errors": 0,

"latencies": []

}

@backoff.on_exception(

backoff.expo,

(httpx.HTTPStatusError, httpx.RequestError),

max_tries=3,

max_time=60

)

async def create_completion(

self,

messages: List[Dict[str, str]],

model: ModelVersion = ModelVersion.GLM_4_5_AIR,

temperature: float = 0.7,

max_tokens: Optional[int] = None,

stream: bool = False,

**kwargs

) -> Dict:

"""

创建对话完成

Args:

messages: 对话消息列表

model: 模型版本

temperature: 温度参数

max_tokens: 最大token数

stream: 是否流式输出

**kwargs: 其他参数(如thinking参数)

Returns:

API响应结果

"""

start_time = time.time()

try:

# 构建请求体

request_body = {

"model": model.value,

"messages": messages,

"temperature": temperature,

**kwargs

}

if max_tokens:

request_body["max_tokens"] = max_tokens

# 记录请求

self.metrics["total_requests"] += 1

logger.info(f"发送请求到{model.value},消息数:{len(messages)}")

# 发送请求

if stream:

return await self._handle_stream(request_body)

else:

response = await self.client.post(

"/chat/completions",

json=request_body

)

response.raise_for_status()

# 处理响应

result = response.json()

# 更新指标

self._update_metrics(result, time.time() - start_time, model)

return result

except Exception as e:

self.metrics["errors"] += 1

logger.error(f"API调用失败:{str(e)}")

raise

async def _handle_stream(

self,

request_body: Dict

) -> AsyncGenerator[Dict, None]:

"""处理流式响应"""

request_body["stream"] = True

async with self.client.stream(

"POST",

"/chat/completions",

json=request_body

) as response:

response.raise_for_status()

async for line in response.aiter_lines():

if line.startswith("data: "):

data = line[6:]

if data == "[DONE]":

break

try:

chunk = json.loads(data)

yield chunk

except json.JSONDecodeError:

continue

def _update_metrics(

self,

response: Dict,

latency: float,

model: ModelVersion

):

"""更新性能指标"""

if "usage" in response:

usage = response["usage"]

total_tokens = usage.get("total_tokens", 0)

self.metrics["total_tokens"] += total_tokens

# 计算成本

cost = self._calculate_cost(

usage.get("prompt_tokens", 0),

usage.get("completion_tokens", 0),

model

)

self.metrics["total_cost"] += cost

self.metrics["latencies"].append(latency)

# 保持最近1000个延迟记录

if len(self.metrics["latencies"]) > 1000:

self.metrics["latencies"] = self.metrics["latencies"][-1000:]

def _calculate_cost(

self,

input_tokens: int,

output_tokens: int,

model: ModelVersion

) -> float:

"""计算API调用成本(通过laozhang.ai的优惠价)"""

if model == ModelVersion.GLM_4_5:

# laozhang.ai优惠价:输入1.75元/百万,输出3.5元/百万

return (input_tokens * 1.75 + output_tokens * 3.5) / 1_000_000

else: # GLM_4_5_AIR

# laozhang.ai优惠价:输入0.56元/百万,输出1.4元/百万

return (input_tokens * 0.56 + output_tokens * 1.4) / 1_000_000

def get_metrics_summary(self) -> Dict:

"""获取性能指标摘要"""

latencies = self.metrics["latencies"]

if not latencies:

avg_latency = p95_latency = p99_latency = 0

else:

sorted_latencies = sorted(latencies)

avg_latency = sum(latencies) / len(latencies)

p95_index = int(len(sorted_latencies) * 0.95)

p99_index = int(len(sorted_latencies) * 0.99)

p95_latency = sorted_latencies[p95_index] if p95_index < len(sorted_latencies) else 0

p99_latency = sorted_latencies[p99_index] if p99_index < len(sorted_latencies) else 0

return {

"total_requests": self.metrics["total_requests"],

"total_tokens": self.metrics["total_tokens"],

"total_cost_yuan": round(self.metrics["total_cost"], 2),

"error_rate": self.metrics["errors"] / max(self.metrics["total_requests"], 1),

"avg_latency_ms": round(avg_latency * 1000, 2),

"p95_latency_ms": round(p95_latency * 1000, 2),

"p99_latency_ms": round(p99_latency * 1000, 2)

}

async def close(self):

"""关闭客户端"""

await self.client.aclose()

# 使用示例

async def main():

# 初始化客户端

config = APIConfig(

api_key="your-laozhang-api-key", # 从laozhang.ai获取

enable_monitoring=True

)

client = GLMProductionClient(config)

try:

# 示例1:智能客服对话

response = await client.create_completion(

messages=[

{"role": "system", "content": "你是一个专业的技术支持助手"},

{"role": "user", "content": "如何优化GLM-4.5的API调用性能?"}

],

model=ModelVersion.GLM_4_5_AIR,

temperature=0.7

)

print("AI回复:", response["choices"][0]["message"]["content"])

# 示例2:复杂推理任务(使用深度思考)

response = await client.create_completion(

messages=[

{"role": "user", "content": "解释量子纠缠的物理原理和应用"}

],

model=ModelVersion.GLM_4_5,

temperature=0.3,

thinking={"type": "enabled"} # 启用深度思考

)

# 示例3:流式输出

print("\n流式输出示例:")

async for chunk in await client.create_completion(

messages=[

{"role": "user", "content": "写一个Python快速排序算法"}

],

model=ModelVersion.GLM_4_5,

stream=True

):

if "choices" in chunk and chunk["choices"]:

delta = chunk["choices"][0].get("delta", {})

if "content" in delta:

print(delta["content"], end="", flush=True)

# 输出性能指标

print("\n\n性能指标摘要:")

metrics = client.get_metrics_summary()

for key, value in metrics.items():

print(f"{key}: {value}")

finally:

await client.close()

# 运行示例

if __name__ == "__main__":

asyncio.run(main())

🚀 快速开始指南

-

注册laozhang.ai账号

bash# 访问注册链接(含100元体验金) https://api.laozhang.ai/register/ -

安装依赖

bashpip install httpx backoff asyncio -

配置API密钥

pythonconfig = APIConfig( api_key="sk-your-api-key-here" ) -

开始使用

- 将上述代码保存为

glm_client.py - 替换API密钥

- 运行示例代码

- 将上述代码保存为

这个生产级实现包含了错误重试、性能监控、成本追踪等企业级功能,可以直接用于生产环境。通过laozhang.ai,您可以获得更稳定的服务和更优惠的价格。

总结:拥抱开源AI的最佳时机

GLM-4.5的发布标志着国产AI模型进入了新的发展阶段。作为2025年7月最受关注的开源SOTA模型,它不仅在性能上达到了国际一流水平,更在成本和易用性上实现了革命性突破。通过本文的详细介绍,相信您已经掌握了GLM-4.5的核心优势:卓越的性能表现、极具竞争力的价格、原生的Agent能力以及完善的生态支持。

现在正是拥抱GLM-4.5的最佳时机。无论您是想降低AI应用成本、提升产品智能化水平,还是探索AI的更多可能性,GLM-4.5都是理想的选择。特别推荐通过laozhang.ai平台调用GLM-4.5,不仅能享受额外30%的成本优惠,还能获得企业级的稳定性保障。立即注册laozhang.ai,新用户还可获得100元体验金,足够您完成完整的技术评估。让我们一起,用GLM-4.5开启AI应用的新篇章!