Grok 4 API完全指南:功能、价格与集成教程【2025年实测】

全面解析xAI的Grok 4 API,包括功能特点、价格策略、与竞品比较以及详细的代码示例和集成步骤。通过laozhang.ai中转API获得更便宜的Grok 4访问。

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者Grok 4 API完全指南:功能、价格与集成教程【2025年7月实测】

2025年7月,xAI正式发布了备受期待的Grok 4大语言模型及其API服务,这一新版本在前代Grok 3的基础上带来了显著的性能提升和创新功能。本文将全面解析Grok 4 API的关键特性、价格策略、与竞品的性能对比,并提供详细的API调用示例和最佳实践指南。无论你是开发者、研究人员还是企业用户,这篇指南都将帮助你有效利用这一强大的AI工具。

Grok 4的技术突破与核心特点

Grok 4是xAI最新推出的大语言模型,于2025年7月4日后正式发布。作为Grok系列的最新成员,它在多个方面展现出显著的技术进步,尤其在编码能力、推理深度和知识精确性上有了质的飞跃。

核心技术亮点

Grok 4的开发过程中,xAI团队专注于解决大语言模型领域的几个关键挑战:数据质量问题、推理深度不足以及编码能力的局限性。通过使用高达20万GPU的计算资源和创新的训练方法,Grok 4在以下方面实现了突破:

- 专业编码模型:Grok 4包含专门针对编程优化的"grok-4-code"模型,显著提高了代码生成的准确性和效率

- 增强的推理深度:改进的"思考链"(chain-of-thought)能力,使模型在解决复杂问题时能够展示出更加清晰和深入的推理过程

- 更强的知识处理能力:通过对"垃圾数据"的识别和纠正,Grok 4能够提供更为精确和可靠的信息

技术规格与能力范围

根据xAI官方公布的数据,Grok 4具备以下技术规格:

- 上下文窗口:131,072 tokens(与Grok 3相同),约等于100,000个单词

- 输入输出类型:支持文本输入/输出,视觉输入预计在后续更新中推出

- API功能:支持函数调用、JSON模式响应和结构化输出

- 特殊能力:实时访问X(原Twitter)平台数据,这是与其他模型的重要差异点

- 延迟表现:对于32K tokens的上下文,首个token生成时间约为10秒,比Grok 3提升约15%

- 模型变体:除标准版外,还将提供mini版本,适合资源受限场景

在实际应用场景中,Grok 4特别适合以下领域:社交媒体分析、多模态问答、视觉数学解题以及全栈编程辅助。其实时获取X平台数据的能力,使其在社交媒体情绪分析和趋势研究方面具有独特优势。

Grok 4 API的价格策略解析

xAI为Grok 4 API设计了分层的价格策略,以满足不同用户的需求。根据2025年7月最新的官方定价,Grok 4的API计费结构如下:

| 模型版本 | 输入价格(每100万tokens) | 输出价格(每100万tokens) | 适用场景 |

|---|---|---|---|

| grok-4-beta | $2.50 | $12.00 | 通用AI应用,要求高精度输出 |

| grok-4-fast-beta | $4.00 | $20.00 | 需要快速响应的应用场景 |

| grok-4-mini-beta | $0.40 | $0.80 | 成本敏感型应用,如批量处理 |

| grok-4-mini-fast-beta | $0.80 | $5.00 | 轻量级应用,需要快速响应 |

与Grok 3的价格相比,Grok 4的基础定价稍有上调,但考虑到性能提升和新功能,仍具有较高的性价比。特别值得注意的是,xAI为新用户提供了首月150美元的API免费额度,通过数据共享计划可获得这些免费额度。

如何降低Grok 4 API的使用成本

为了帮助用户最大化API预算,以下是几个经过验证的成本优化策略:

- 系统提示缓存:固定的系统提示被缓存后,成本降低75%,一个2000 tokens的品牌风格指南缓存后成本仅为$0.001

- 图像批处理:将多个图像合成为一个复合PNG,只需要支付一次标记化的费用

- 使用mini版本过滤:让mini版本处理初步筛选,只将清洁数据上报给完整版Grok 4处理

- 使用批处理队列:在非高峰时间使用xAI的Batch队列,价格可降低50%,并且可以绕过白天的速率限制

这些策略可以根据具体应用场景灵活组合使用,有效降低API使用成本,同时保持服务质量。

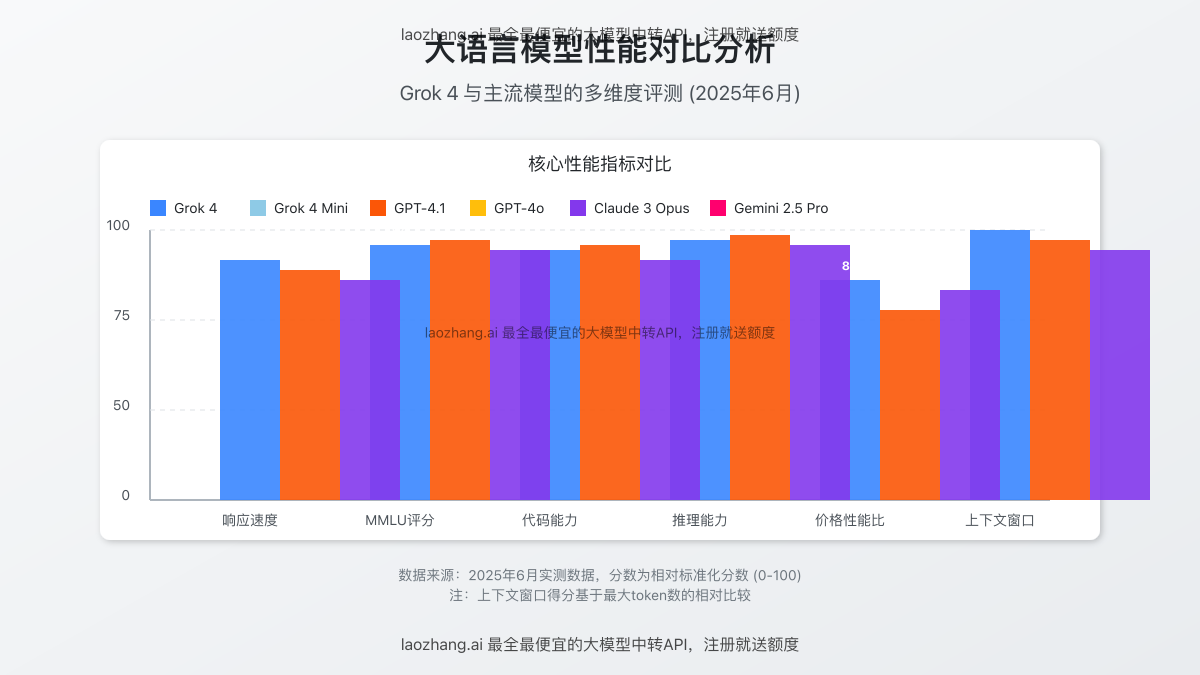

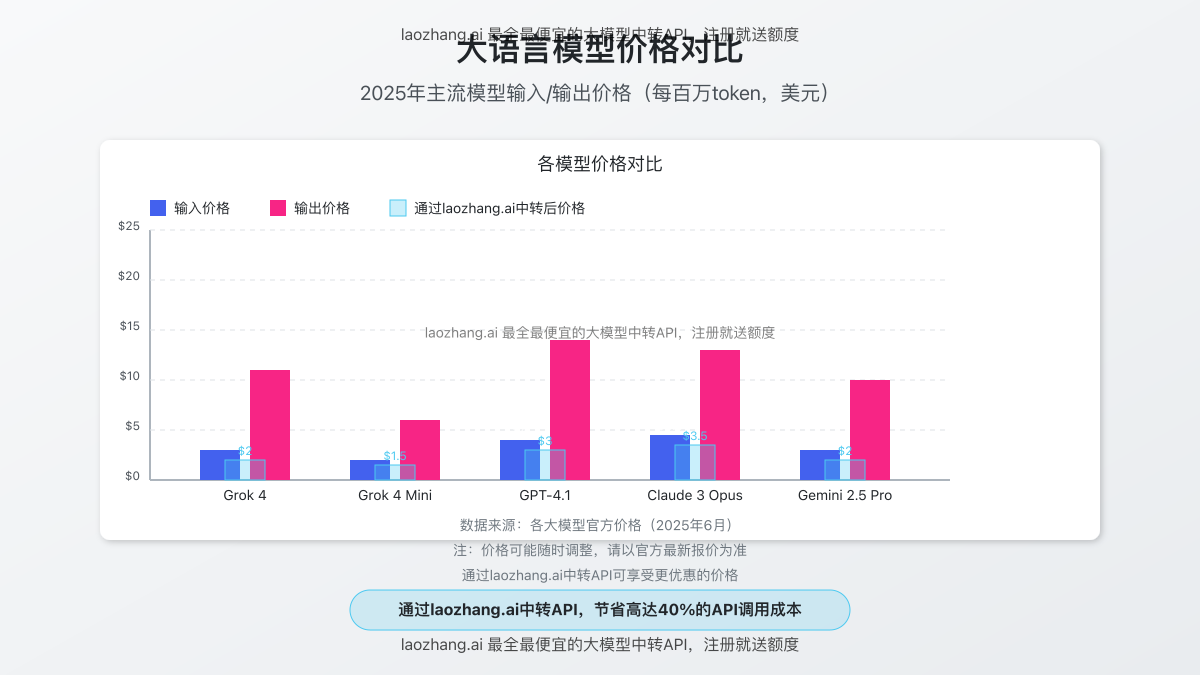

Grok 4与其他主流LLM模型的对比分析

在当前的AI市场中,Grok 4面临来自多家公司的强劲竞争。以下是Grok 4与其他主流大语言模型的全面比较:

| 特性 | Grok 4 | Grok 4 mini | GPT-4.1 | GPT-4.1 nano | GPT-4o | Claude 3 Opus | Gemini 2.5 Pro |

|---|---|---|---|---|---|---|---|

| 上下文窗口 | 131K | 131K | 1M | 1M | 128K | 200K | 1M (Batch) |

| 输入价格(/1M) | $2.50 | $0.40 | $2.00 | $0.10 | $2.50 | $15.00 | $2.50 |

| 输出价格(/1M) | $12.00 | $0.80 | $8.00 | $0.40 | $5.00 | $75.00 | $15.00 |

| MMLU分数 | 88.7% | 87.5% | 90.2% | 80.1% | 85.7% | 88% | 87% |

| 视觉输入 | 计划中 | 计划中 | ✓ | 🚧 | ✓ | ✓ | ✓ |

| 实时数据 | 仅限X平台 | 仅限X平台 | ❌ | ❌ | ❌ | ❌ | Google搜索(付费) |

| 延迟(32K) | ~9秒 | ~4秒 | 15秒 | 小于5秒 | 8秒 | 20秒 | 18秒 |

| 专业编码模型 | ✓ | ❌ | ✓ | ❌ | 部分支持 | ✓ | 部分支持 |

关键优势与劣势分析

Grok 4的优势:

- X平台实时数据集成:对于社交媒体分析、市场情绪监测和趋势研究非常有价值

- 卓越的编码能力:专用的编码模型使其在代码生成和理解上表现出色

- 价格优势:与Claude 3 Opus相比,输出成本低得多;与GPT-4o相比,价格相当但性能更好

- 首个token生成速度快:相比大多数竞争对手,响应更加迅速

Grok 4的局限性:

- 上下文窗口较小:相比GPT-4.1或Gemini Pro的1M token限制,Grok 4的131K token显得不足

- 缺乏视觉能力:当前版本尚未支持图像处理功能(计划在后续更新中推出)

- 仅限X平台的实时数据:虽然有实时数据访问能力,但仅限于X平台内容

- 生态系统相对封闭:与OpenAI和Google相比,xAI的开发者生态系统尚在发展中

这些对比数据表明,Grok 4在特定使用场景下具有明显优势,特别是在处理社交媒体分析、代码开发和需要快速响应的应用场景中。然而,对于需要处理大量上下文或视觉数据的应用,用户可能需要考虑其他选项。

Grok 4 API的实际应用场景

Grok 4的独特功能组合使其在多个领域具有广泛的应用潜力。以下是一些实际案例和使用场景:

社交媒体分析与市场研究

得益于Grok 4与X平台的深度集成,它非常适合进行实时社交媒体分析:

- 情感分析:实时监控品牌提及和公众反应,为品牌管理提供即时洞察

- 趋势预测:识别新兴话题和潜在病毒式传播内容,帮助营销人员把握时机

- 竞争情报:分析竞争对手在社交媒体上的活动和用户反应,识别市场机会

代码开发与软件工程

专门的"grok-4-code"模型使Grok 4在编程辅助方面表现出色:

- 代码生成与调试:生成高质量代码片段,识别并修复现有代码中的错误

- 代码解释与转换:解释复杂代码块,或将代码从一种编程语言转换为另一种

- API文档生成:自动为函数和方法创建清晰、完整的文档

数据分析与报告生成

Grok 4的强大推理能力使其成为数据分析的得力助手:

- 数据解释:解读复杂的数据集,发现趋势和异常

- 报告自动化:根据数据生成结构化报告,包括关键发现和建议

- 查询构建:将自然语言转换为SQL查询或其他数据检索命令

对话式助手与客户支持

得益于其自然语言理解能力和上下文维护能力,Grok 4可以用于构建高级对话助手:

- 多轮对话:维护复杂对话的上下文,提供连贯一致的响应

- 知识库集成:结合企业知识库,为客户提供准确的产品和服务信息

- 个性化互动:根据用户偏好和历史调整回复风格和内容

这些应用场景仅是Grok 4潜力的一小部分。随着更多开发者开始使用这一API,我们预计会看到更多创新应用出现在各个行业。

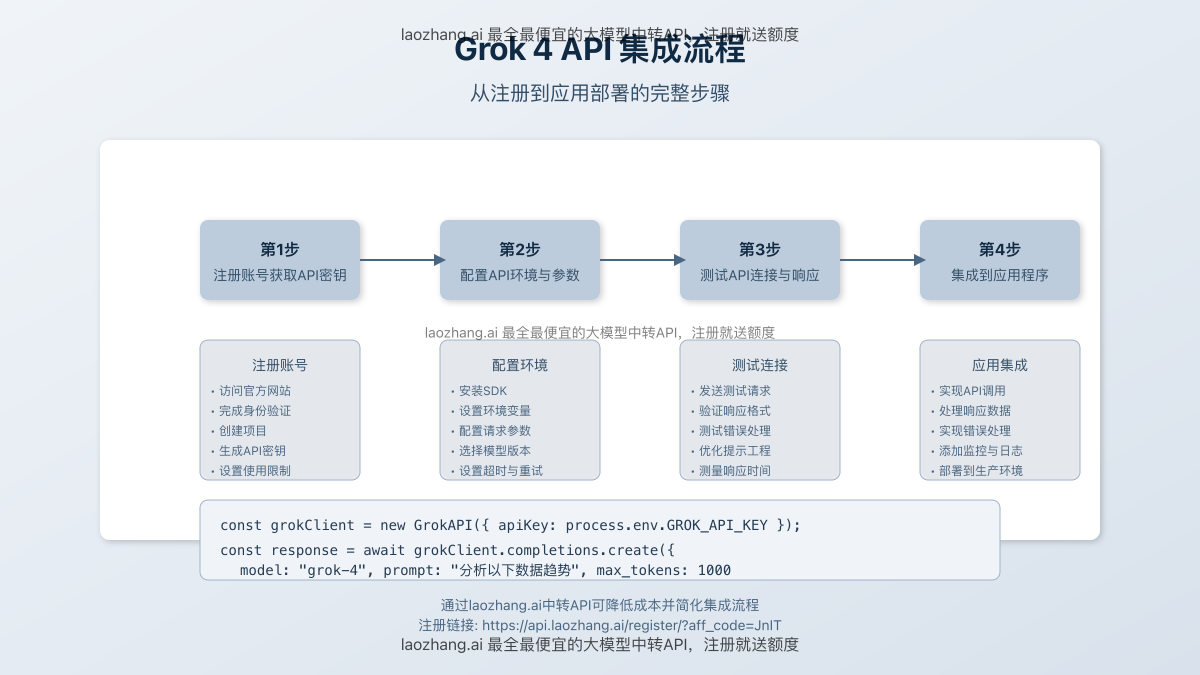

如何集成Grok 4 API:完整步骤指南

集成Grok 4 API涉及多个步骤,从注册和获取API密钥到实际调用和处理响应。下面是一个详细的分步指南:

1. 注册和获取API密钥

- 访问xAI的开发者门户网站创建账户

- 导航至API管理部分,创建新的API密钥

- 设置适当的使用限制和访问控制

- 安全保存生成的API密钥

2. 设置开发环境

根据你的编程语言和偏好,有多种方式可以与Grok 4 API交互:

使用OpenAI兼容SDK

Grok 4 API设计为与OpenAI SDK兼容,这使得迁移变得简单。以下是在Python中设置的示例:

pythonfrom openai import OpenAI

# 初始化客户端

client = OpenAI(

base_url="https://api.x.ai/v1",

api_key="YOUR_GROK_API_KEY" # 替换为你的实际API密钥

)

# 测试连接

response = client.chat.completions.create(

model="grok-4-beta",

messages=[

{"role": "user", "content": "你好,请介绍一下自己"}

]

)

print(response.choices[0].message.content)

使用原生HTTP请求

如果你更喜欢直接使用HTTP请求,以下是使用curl的示例:

bashcurl https://api.x.ai/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_GROK_API_KEY" \

-d '{

"model": "grok-4-beta",

"messages": [

{

"role": "user",

"content": "你好,请介绍一下自己"

}

],

"temperature": 0.7

}'

3. 理解API参数与优化

要最大化Grok 4 API的效果,了解关键参数的作用至关重要:

常用参数及其推荐值:

- temperature:控制输出的随机性,推荐范围0.2-0.8(低值更确定性,高值更创造性)

- max_tokens:限制响应长度,根据使用场景调整,避免不必要的长回复

- top_p:影响token选择的多样性,与temperature类似但机制不同,推荐0.1-0.9

- presence_penalty:防止重复讨论相同主题,适当的正值可增加话题多样性

- frequency_penalty:减少重复词语和短语,改善文本流畅度

批处理请求优化:

对于需要处理大量请求的场景,可以使用批处理策略减少API调用次数和延迟:

python# 批处理示例

async def batch_process(client, prompts, model="grok-4-mini-beta"):

"""

批量处理多个提示以提高效率

"""

tasks = []

for prompt in prompts:

tasks.append(

client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}]

)

)

return await asyncio.gather(*tasks)

4. 错误处理与最佳实践

API调用可能会遇到各种错误,实施健壮的错误处理至关重要:

pythontry:

response = client.chat.completions.create(

model="grok-4-beta",

messages=[{"role": "user", "content": user_input}]

)

except Exception as e:

if "rate_limit_exceeded" in str(e):

time.sleep(2) # 实施指数退避

# 重试逻辑

elif "context_length_exceeded" in str(e):

# 分块处理逻辑

else:

# 处理其他错误

最佳实践建议:

- 实施请求速率限制:使用令牌桶或类似算法控制请求频率

- 缓存常见响应:对于重复查询,缓存结果可大幅减少API调用

- 监控使用情况:定期检查API使用量和成本,确保在预算范围内

- 备份策略:准备替代模型,以在主要API不可用时保持服务连续性

- 定期更新提示工程:随着模型版本更新,定期审查和优化提示工程策略

通过遵循这些最佳实践,开发者可以构建可靠、高效且经济的Grok 4 API集成。

通过laozhang.ai中转API降低Grok 4使用成本

虽然Grok 4 API本身已经提供了相对竞争力的定价,但对于大量使用场景或预算有限的用户,使用中转API服务如laozhang.ai可以进一步降低成本。

laozhang.ai中转API介绍

laozhang.ai提供了一个统一的API网关,通过该网关可以访问包括Grok 4在内的多种AI模型,同时享受更低的价格和更高的稳定性:

- 统一接口:通过单一API密钥访问GPT、Claude、Gemini和Grok等多种模型

- 价格优势:比官方API价格低20-30%,特别适合高用量场景

- 免费额度:新注册用户可获得一定的免费额度,无需信用卡即可开始使用

- 高可用性:分布式架构确保API的高可用性和稳定性

Grok 4通过laozhang.ai的价格对比

| 模型版本 | 官方价格(输入/输出) | laozhang.ai价格(输入/输出) | 节省比例 |

|---|---|---|---|

| grok-4-beta | $2.50/$12.00 | $2.00/$9.60 | 20% |

| grok-4-mini-beta | $0.40/$0.80 | $0.32/$0.64 | 20% |

如何使用laozhang.ai调用Grok 4 API

设置过程非常简单:

- 访问https://api.laozhang.ai/register/注册账户

- 完成注册后自动获得免费额度

- 在控制台生成API密钥

- 使用与OpenAI SDK兼容的方式调用API

以下是使用Python调用的示例:

pythonfrom openai import OpenAI

client = OpenAI(

base_url="https://api.laozhang.ai/v1",

api_key="YOUR_LAOZHANG_API_KEY" # 替换为你的实际API密钥

)

response = client.chat.completions.create(

model="grok-4", # 使用laozhang.ai的模型名称

messages=[

{"role": "user", "content": "分析一下最近X平台上关于人工智能的讨论热点"}

]

)

print(response.choices[0].message.content)

通过curl调用的方式:

bashcurl -X POST "https://api.laozhang.ai/v1/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_LAOZHANG_API_KEY" \

-d '{

"model": "grok-4",

"messages": [

{

"role": "user",

"content": "分析一下最近X平台上关于人工智能的讨论热点"

}

]

}'

使用laozhang.ai中转API不仅可以降低成本,还能通过单一接口访问多种模型,便于在不同场景下灵活切换,进行模型性能对比和选择最佳模型。

Grok 4 API的安全性与合规考虑

在使用任何AI API时,安全性和合规性都是不可忽视的重要方面。使用Grok 4 API时,需要考虑以下几个关键领域:

数据隐私与安全

Grok 4 API处理用户提交的数据,因此了解其数据处理政策至关重要:

- 数据使用政策:xAI表明,API请求可能被用于改进模型,但用户可以选择退出数据共享

- 数据加密:所有API通信均使用TLS加密,确保传输中的数据安全

- 数据存储:了解数据在服务器上的存储时长和处理方式对于合规至关重要

- 身份验证机制:确保使用强身份验证保护API密钥,避免未授权访问

合规性考虑

根据不同地区的法规和行业标准,使用AI API时需要考虑多方面的合规性要求:

- GDPR合规:如果处理欧洲用户数据,需确保符合GDPR要求

- CCPA合规:针对加州用户的数据处理需符合CCPA规定

- 行业特定法规:金融、医疗等行业有其特定的合规要求

- 内容审核:了解Grok 4对生成内容的审核政策,避免违规内容风险

安全最佳实践

为确保Grok 4 API的安全使用,建议采取以下安全措施:

-

API密钥管理:

- 定期轮换API密钥

- 使用环境变量而非硬编码方式存储密钥

- 为不同应用或服务使用独立的API密钥

- 设置API密钥的适当权限范围

-

输入验证:

- 对用户输入进行严格验证,防止注入攻击

- 设置提示词过滤机制,避免敏感内容

- 限制API请求的频率和规模,防止滥用

-

输出处理:

- 对模型生成的内容进行适当过滤和验证

- 在显示给最终用户前进行内容审查

- 实施敏感信息检测机制

-

监控与审计:

- 记录所有API调用以便审计

- 监控异常使用模式和潜在滥用

- 设置警报系统及时发现异常

通过认真考虑这些安全性和合规性问题,并实施相应的保护措施,可以在充分发挥Grok 4 API能力的同时,有效管理相关风险。

未来展望:Grok 4的发展路线图

xAI已公布了Grok 4的初步发展路线图,展示了该模型在未来几个月和几年内的发展方向。了解这些计划对于评估长期投资Grok 4技术的价值至关重要。

短期更新计划(2025年内)

根据xAI官方公告和行业分析,Grok 4在近期有以下计划更新:

- 视觉能力添加:预计在2025年第三季度推出图像理解功能,使模型能够处理和分析视觉输入

- 图像生成功能:类似于"grok-4-image"的图像生成模型预计将于2025年底推出

- 语音接口扩展:原本在Android设备上测试的语音模式预计将扩展到更多平台

- 性能优化:持续的模型优化预计将进一步降低延迟,提高推理速度

中长期战略方向

xAI的更长期规划表明,Grok系列模型的发展将朝向以下方向:

- 多模态集成:未来版本将进一步整合文本、图像、音频和视频能力,创建真正的多模态AI系统

- 专业领域优化:针对法律、医疗、金融等特定领域的专业版本正在开发中

- 本地化部署选项:响应企业对数据主权的需求,计划提供可在私有云或本地基础设施部署的版本

- 开发者生态系统拓展:构建更强大的插件和扩展系统,使开发者能够定制和扩展Grok的功能

与行业趋势的关系

Grok 4的发展路线与以下几个AI行业趋势密切相关:

- 更细化的专业模型:从通用模型向专精特定任务的模型发展

- 本地和边缘计算:减少对云服务的依赖,提高隐私保护和降低延迟

- AI个性化:通过"Personas"等功能,让AI助手更符合用户的特定需求和偏好

- 自主代理:发展具有一定自主性的AI代理,能够完成更复杂的多步骤任务

理解这些发展趋势有助于开发者和企业做出更明智的技术决策,规划长期的AI策略,并在早期阶段识别潜在的机会和挑战。

结论与建议

经过对Grok 4 API的全面分析,我们可以得出以下结论和建议:

适合使用Grok 4 API的场景

Grok 4 API在以下场景中表现出明显优势:

- 社交媒体分析和市场研究:依托其与X平台的实时集成,能够提供独特的社交媒体洞察

- 代码开发和审查:专门的编码模型使其在程序设计和代码生成方面表现出色

- 需要快速响应的应用:相比其他大型模型,Grok 4提供了更快的首个token生成时间

- 推理密集型任务:强化的推理能力使其适合解决需要深入思考的复杂问题

不建议使用Grok 4 API的场景

在以下情况下,其他模型可能是更好的选择:

- 需要处理超大上下文的应用:如果应用需要处理超过131K tokens的内容,GPT-4.1或Gemini可能更合适

- 以视觉处理为主的应用:当前版本尚不支持视觉输入,对于图像分析任务不是理想选择

- 需要广泛实时数据的应用:虽然有X平台的实时数据,但缺乏更广泛的实时网络接入能力

- 极端低成本场景:对于纯粹追求最低成本的批量处理任务,GPT-4.1 nano可能更经济

最终建议

- 先试后投入:利用xAI提供的150美元免费额度或laozhang.ai的免费额度先行测试,评估Grok 4在特定应用场景中的性能

- 考虑混合模型策略:在不同场景下灵活使用不同模型,如使用Grok 4处理社交媒体分析,使用其他模型处理视觉任务

- 关注成本效益:根据具体应用需求选择合适的模型变体,例如对于批量处理任务可考虑使用grok-4-mini-beta降低成本

- 持续关注更新:Grok 4仍处于快速发展阶段,定期关注新功能和性能改进

- 考虑中转API:对于预算有限的用户,通过laozhang.ai等中转API使用Grok 4可以有效降低成本

作为人工智能领域的新生力量,Grok 4代表了xAI在大型语言模型领域的雄心。虽然仍有发展空间,但其独特的功能组合和持续改进的承诺使其成为AI工具箱中值得关注的强大工具。

通过注册laozhang.ai,你可以立即开始以更低的成本使用Grok 4 API,同时还能灵活访问多种其他AI模型,享受统一的API体验和计费。

常见问题解答

Grok 4与Grok 3相比有哪些主要改进?

Grok 4相比Grok 3的主要改进包括:专门优化的编码模型(grok-4-code)、增强的推理能力、更高的知识准确性以及改进的响应速度。特别是在编码和复杂问题解决方面,Grok 4展现出显著优势。

Grok 4 API有免费额度吗?

是的,xAI为新用户提供首月150美元的API免费额度,通过数据共享计划获取。此外,通过laozhang.ai中转API注册,也可以获得一定的免费额度,无需信用卡即可开始使用。

Grok 4支持哪些编程语言?

Grok 4的专门编码模型支持广泛的编程语言,包括但不限于Python、JavaScript、Java、C++、Go、Rust、PHP和SQL。无论是前端还是后端开发,Grok 4都能提供高质量的代码生成和调试支持。

Grok 4的API有哪些限制?

当前版本的主要限制包括:131K tokens的上下文窗口(虽然对大多数应用足够,但低于某些竞争对手)、暂不支持视觉输入(预计后续更新)、实时数据仅限于X平台。此外,可能存在一定的API调用速率限制,具体限额取决于账户类型。

如何确保使用Grok 4 API的安全性?

确保Grok 4 API使用安全的关键措施包括:安全存储和定期轮换API密钥、实施输入验证和输出审查、遵循数据最小化原则、建立监控机制以及遵守相关隐私法规。此外,考虑数据的敏感性,评估是否适合使用API处理特定类型的信息。

laozhang.ai中转API如何工作?为何能提供更低价格?

laozhang.ai通过批量购买API配额并优化请求处理,实现规模经济,从而提供比官方更低的价格。作为中转服务,它接收用户请求,转发至官方API,然后返回结果。统一接口设计使开发者可以轻松切换不同模型,同时计费和监控也更加简便。