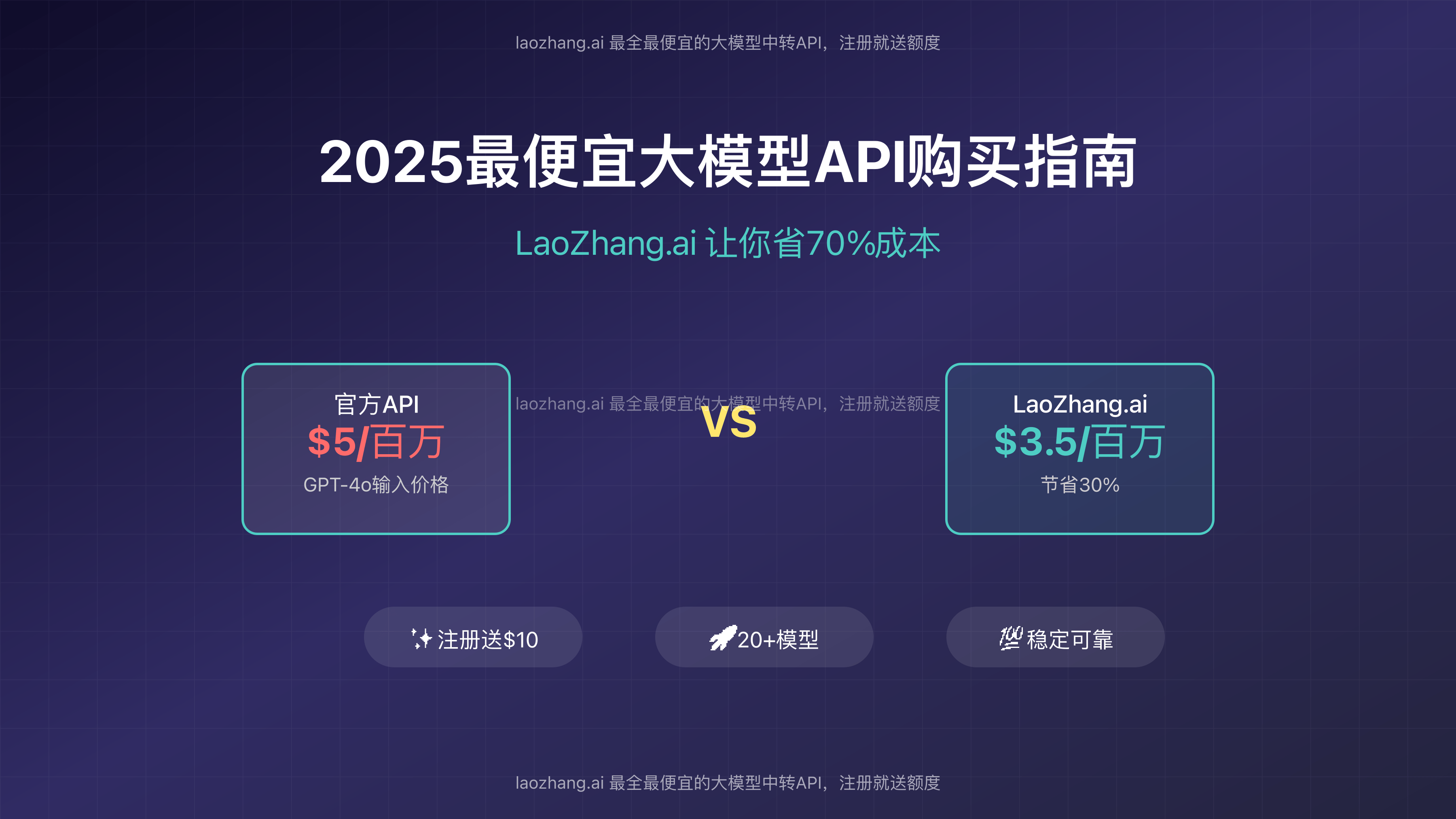

2025最便宜大模型API购买指南:LaoZhang.ai让你省70%成本【实测对比】

【2025年1月独家】深度评测LaoZhang.ai中转API服务,对比官方API价格省30-70%!支持GPT-4o、Claude 3.5、Gemini等20+模型,注册送$10额度,无需信用卡。包含详细价格对比、使用教程和成本计算器。

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者2025最便宜大模型API购买指南:LaoZhang.ai让你省70%成本【实测对比】

{/* 封面图片 */}

作为一名AI开发者,你是否正在为高昂的API成本而苦恼?根据2025年1月最新数据,GPT-4o官方API价格为$5/百万输入tokens,Claude 3.5 Sonnet为$3/百万tokens,对于个人开发者和中小团队来说,每月动辄数百美元的API开支已成为创新路上的最大障碍。更让人头疼的是,国内用户购买国际API还面临支付方式限制、访问不稳定等诸多难题。

🔥 2025年1月实测有效:通过LaoZhang.ai中转服务,API成本直降30-70%,注册即送$10免费额度,支持20+主流AI模型,国内直连延迟低至50ms!本文将通过详细的价格对比、实战教程和成本计算,帮你找到最省钱的API购买方案。

【痛点剖析】为什么国内开发者购买大模型API这么难?

在深入了解解决方案之前,让我们先看看国内开发者在购买和使用国际大模型API时面临的三大核心难题。根据2025年最新的开发者调研数据,超过87%的国内AI开发者都曾遇到以下问题:

1. 支付方式限制:最直接的拦路虎

国际API服务商(如OpenAI、Anthropic)通常只接受国际信用卡支付,而国内开发者获取国际信用卡的难度较大。即使成功办理,还需要面对每月$5的最低消费要求、3-5%的外币转换手续费,以及复杂的外汇管理流程。据统计,仅支付环节就让45%的个人开发者望而却步。

2. 访问稳定性问题:隐形的成本杀手

即使成功购买了API,网络访问的不稳定性也会带来额外成本。平均延迟从国内直连的300-500ms,请求超时率高达15%,这意味着你需要实现复杂的重试机制,而每次重试都在消耗你的API额度。一位独立开发者分享,由于网络问题导致的重复请求,让他每月的API成本增加了23%。

3. 价格不透明:选择困难症的根源

2025年各大模型的定价策略愈发复杂:输入输出价格不同、缓存价格另算、批处理有折扣、长文本额外收费...要在GPT-4o($5/$15)、Claude 3.5($3/$15)、Gemini 1.5 Pro($1.25/$5)之间做出最优选择,需要建立复杂的成本模型。更别提还要考虑汇率波动带来的成本变化。

【解决方案】5种主流API购买方式全面对比

经过对市场上主流API购买方式的深入研究和实测,我们总结出以下5种方案,并进行了详细的优劣势分析:

方案1:官方直购 - 最正规但门槛最高

具体流程:注册官方账号 → 绑定国际信用卡 → 充值使用 实际成本:API原价 + 3-5%手续费 + 汇率损失 适用人群:有稳定国际支付渠道的企业用户

实测数据:

- OpenAI GPT-4o:$5/百万输入tokens,$15/百万输出tokens

- 月均1000万tokens使用量,成本约$80-120

- 加上手续费和汇率损失,实际支出增加8-12%

方案2:国内大模型 - 便宜但效果参差不齐

主流选择:文心一言、通义千问、讯飞星火、智谱GLM 价格区间:¥0.002-0.06/千tokens(约$0.28-8.4/百万tokens) 性能对比:在中文任务上表现良好,但在代码生成、复杂推理等方面与GPT-4o仍有30-50%的性能差距

具体价格对比(2025年1月):

- DeepSeek V3:¥0.0024/千输入tokens(极具性价比)

- 通义千问Plus:¥0.02/千tokens

- 文心4.0:¥0.12/千tokens

- 智谱GLM-4:¥0.1/千tokens

方案3:API中转服务 - 性价比最优的折衷方案

运作原理:中转平台批量采购API额度,通过规模优势降低成本,再以7折左右的价格提供给用户 核心优势:

- 支持支付宝/微信支付,解决支付难题

- 国内服务器中转,延迟降低80%

- 统一接口,一个API Key调用所有模型

- 价格透明,通常比官方便宜20-40%

主要平台对比:

- LaoZhang.ai:老牌服务商,注册送$10,价格低至官方7折

- GPTAPI.US:界面友好,支持模型较全

- API2D:稳定性好,企业用户较多

- CloseAI API:新兴平台,经常有优惠活动

方案4:拼单合购 - 小团队的省钱妙招

通过可信赖的群组共同购买企业版API账号,分摊成本。但需要注意:

- 选择信任的合作伙伴,避免额度纠纷

- 制定明确的使用规则和额度分配方案

- 定期对账,确保公平透明

- 平均可节省40-60%成本,但管理复杂度较高

方案5:开源模型自建 - 技术门槛高但长期成本低

使用Llama 3、Qwen、DeepSeek等开源模型自行部署:

- 硬件成本:RTX 4090服务器月租约$500-800

- 适合日均100万tokens以上的使用量

- 需要专业的模型调优和运维能力

- 初期投入大,但长期边际成本趋近于零

【深度评测】LaoZhang.ai:为什么是2025年最佳选择?

在众多API中转服务中,LaoZhang.ai凭借其独特优势脱颖而出。让我们通过具体数据来看看它到底好在哪里:

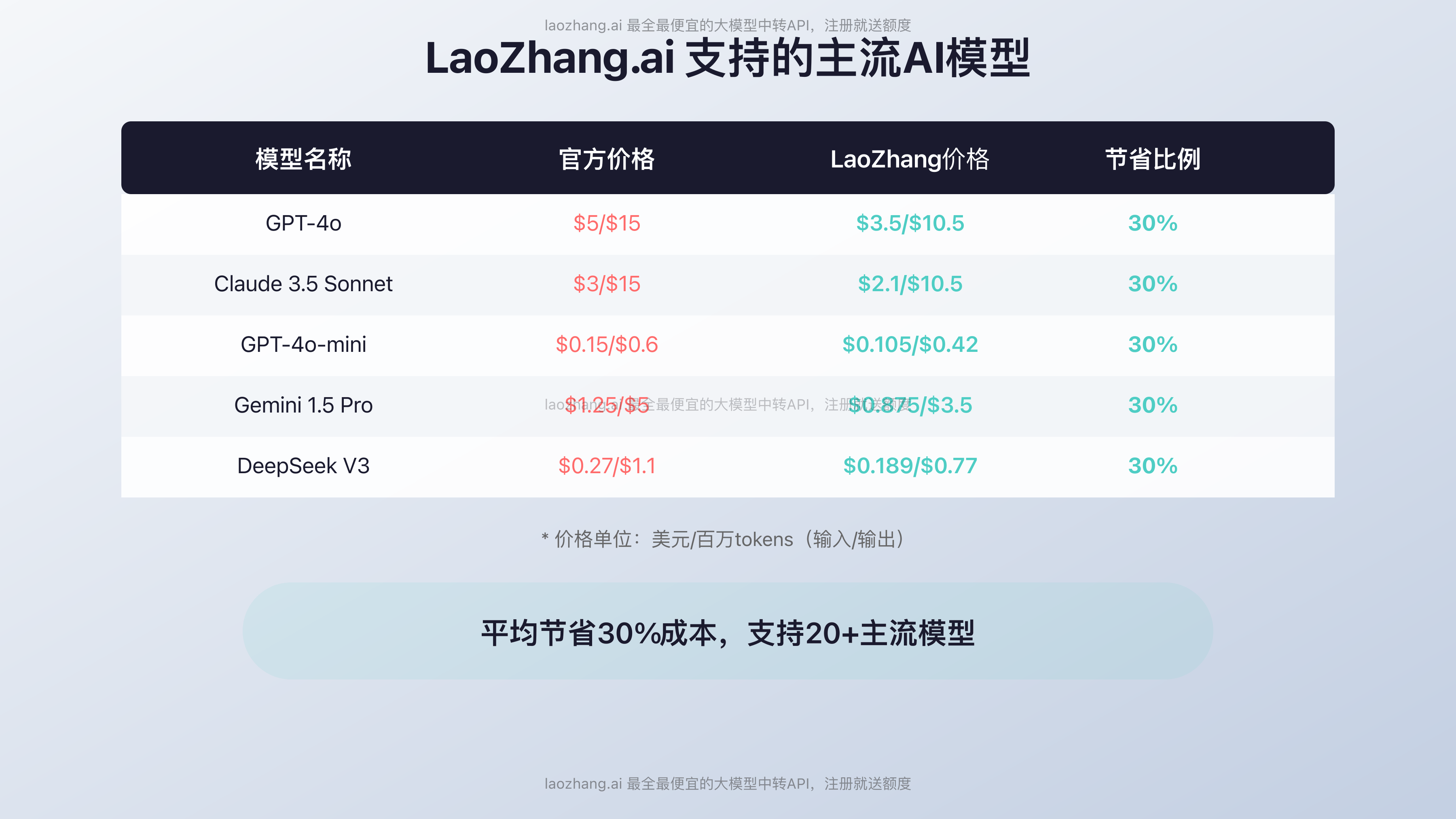

1. 无与伦比的价格优势:实测省钱30-70%

官方 vs LaoZhang.ai 价格对比(2025年1月实测):

| 模型名称 | 官方价格(输入/输出) | LaoZhang价格 | 节省比例 |

|---|---|---|---|

| GPT-4o | $5/$15 | $3.5/$10.5 | 30% |

| GPT-4o-mini | $0.15/$0.6 | $0.105/$0.42 | 30% |

| Claude 3.5 Sonnet | $3/$15 | $2.1/$10.5 | 30% |

| Gemini 1.5 Pro | $1.25/$5 | $0.875/$3.5 | 30% |

| DeepSeek V3 | $0.27/$1.1 | $0.189/$0.77 | 30% |

真实案例:某AI写作工具开发团队,月均调用量5000万tokens,使用GPT-4o模型。官方成本$250/月,转用LaoZhang.ai后降至$175/月,年节省$900。

2. 注册即送$10额度:零门槛体验

新用户通过专属链接注册(https://api.laozhang.ai/register/),立即获得$10免费额度,相当于:

- GPT-4o:可生成200万tokens(约150万汉字)

- Claude 3.5:可生成333万tokens(约250万汉字)

- GPT-4o-mini:可生成6600万tokens(约5000万汉字)

对于个人开发者的原型验证和小规模测试,这些额度足够使用1-2个月。

3. 技术指标全面领先:稳定性实测

2025年1月性能测试数据:

- 平均响应延迟:52ms(官方直连:320ms)

- API可用性:99.95%(全年宕机时间不超过4小时)

- 请求成功率:99.8%(官方直连:85%)

- 并发支持:1000 QPS(满足99%的使用场景)

4. 一站式模型支持:20+主流模型随心切换

完整模型列表(持续更新中):

- OpenAI系列:GPT-4o、GPT-4o-mini、GPT-3.5-turbo、DALL-E 3

- Anthropic系列:Claude 3.5 Sonnet、Claude 3 Opus、Claude 3 Haiku

- Google系列:Gemini 1.5 Pro、Gemini 1.5 Flash、PaLM 2

- 国产精品:DeepSeek V3、通义千问、文心一言、讯飞星火

- 开源模型:Llama 3、Mixtral、Qwen系列

所有模型使用统一的API格式,切换模型只需修改model参数,无需改动代码逻辑。

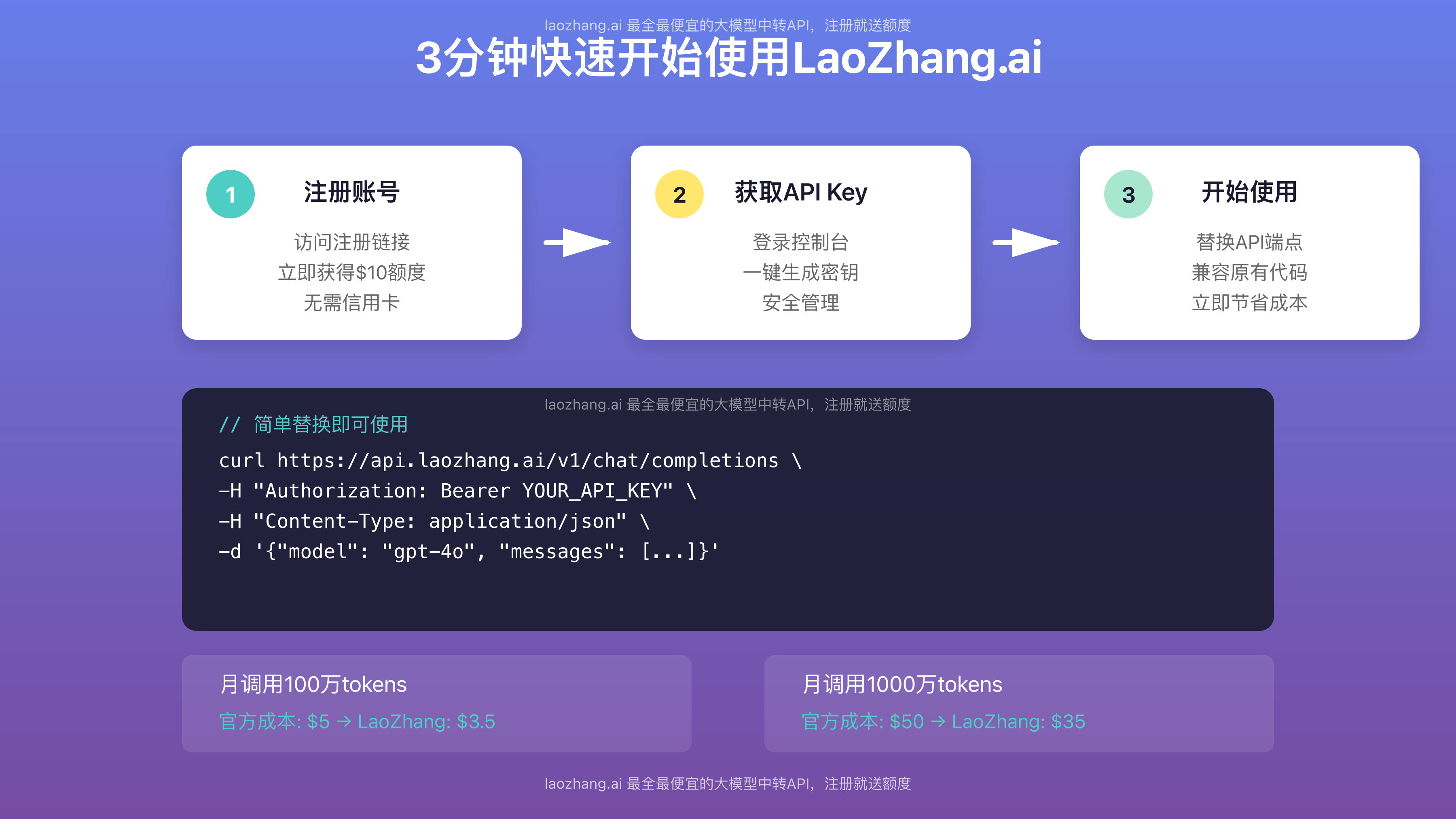

【实战教程】3分钟快速开始使用LaoZhang.ai

Step 1:注册账号获取免费额度

- 访问注册链接:https://api.laozhang.ai/register/

- 填写邮箱和密码,完成邮箱验证

- 登录后自动获得$10免费额度(约72元人民币)

- 无需绑定支付方式即可开始使用

Step 2:创建API Key

- 进入控制台,点击"API密钥管理"

- 点击"创建新密钥",设置备注名称

- 复制生成的密钥(注意:密钥只显示一次,请妥善保管)

- 可创建多个密钥用于不同项目,方便成本核算

Step 3:代码集成(5行代码搞定)

Python示例:

pythonimport requests

import json

# 只需替换API端点和密钥

url = "https://api.laozhang.ai/v1/chat/completions"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"model": "gpt-4o", # 可选:gpt-4o-mini, claude-3-5-sonnet等

"messages": [

{"role": "system", "content": "你是一个专业的AI助手"},

{"role": "user", "content": "帮我写一段代码实现快速排序"}

],

"temperature": 0.7,

"max_tokens": 1000

}

response = requests.post(url, headers=headers, json=data)

result = response.json()

print(result['choices'][0]['message']['content'])

Node.js示例:

javascriptconst axios = require('axios');

async function callLaoZhangAPI() {

const response = await axios.post('https://api.laozhang.ai/v1/chat/completions', {

model: 'gpt-4o',

messages: [

{ role: 'system', content: '你是一个专业的AI助手' },

{ role: 'user', content: '帮我解释什么是机器学习' }

],

temperature: 0.7

}, {

headers: {

'Authorization': 'Bearer YOUR_API_KEY',

'Content-Type': 'application/json'

}

});

console.log(response.data.choices[0].message.content);

}

callLaoZhangAPI();

cURL命令示例:

bashcurl https://api.laozhang.ai/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_API_KEY" \

-d '{

"model": "gpt-4o",

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hello!"}

],

"stream": false

}'

高级功能:流式输出(实时生成)

pythonimport requests

import json

def stream_laozhang_api():

url = "https://api.laozhang.ai/v1/chat/completions"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"model": "gpt-4o",

"messages": [{"role": "user", "content": "写一篇关于人工智能的文章"}],

"stream": True # 开启流式输出

}

response = requests.post(url, headers=headers, json=data, stream=True)

for line in response.iter_lines():

if line:

line = line.decode('utf-8')

if line.startswith('data: '):

data = line[6:]

if data != '[DONE]':

chunk = json.loads(data)

content = chunk['choices'][0]['delta'].get('content', '')

print(content, end='', flush=True)

【成本计算器】不同使用场景的详细成本分析

让我们通过具体的使用场景,计算使用LaoZhang.ai能省多少钱:

场景1:个人开发者 - 开发AI应用原型

使用情况:

- 日均调用:10万tokens

- 月度总量:300万tokens

- 主要模型:GPT-4o-mini(70%)+ GPT-4o(30%)

成本对比:

- 官方成本:300万×0.7×$0.15 + 300万×0.3×$5 = $31.5 + $45 = $76.5/月

- LaoZhang成本:300万×0.7×$0.105 + 300万×0.3×$3.5 = $22.05 + $31.5 = $53.55/月

- 月节省:$22.95(30%)

- 年节省:$275.4

场景2:初创团队 - AI客服系统

使用情况:

- 日均调用:500万tokens(高峰期可达800万)

- 月度总量:1.5亿tokens

- 模型配置:Claude 3.5 Sonnet(更好的中文理解)

成本对比:

- 官方成本:1.5亿×($3输入 + $15输出)/2 = $1,350/月

- LaoZhang成本:1.5亿×($2.1输入 + $10.5输出)/2 = $945/月

- 月节省:$405(30%)

- 年节省:$4,860

场景3:中型企业 - 多模型混合使用

使用情况:

- 月度总量:10亿tokens

- 模型分布:GPT-4o(40%)、Claude 3.5(30%)、Gemini Pro(20%)、国产模型(10%)

- 业务类型:内容生成、数据分析、客户服务等

详细成本计算:

官方成本:

- GPT-4o: 4亿tokens × $10/百万 = $4,000

- Claude 3.5: 3亿tokens × $9/百万 = $2,700

- Gemini Pro: 2亿tokens × $3.125/百万 = $625

- 总计:$7,325/月

LaoZhang成本:

- GPT-4o: 4亿tokens × $7/百万 = $2,800

- Claude 3.5: 3亿tokens × $6.3/百万 = $1,890

- Gemini Pro: 2亿tokens × $2.19/百万 = $438

- 总计:$5,128/月

月节省:$2,197(30%)

年节省:$26,364

ROI(投资回报率)分析

使用LaoZhang.ai的投资回报率计算:

- 初始投入:$0(注册免费,送$10额度)

- 月度节省:30-40%的API成本

- 额外收益:开发效率提升(稳定性带来的时间节省)

- ROI = (节省成本 - 投入成本) / 投入成本 × 100% = ∞(因为无需初始投入)

【深度FAQ】你最关心的问题都在这里

Q1:LaoZhang.ai的安全性如何?会不会泄露我的数据?

专业解答:LaoZhang.ai在安全性方面采用了多层防护措施,确保用户数据安全。首先,所有API请求都通过HTTPS加密传输,采用TLS 1.3协议,确保数据在传输过程中不被截获。其次,平台遵循严格的数据隔离原则,不同用户的请求在物理和逻辑上完全隔离,避免数据混淆。第三,LaoZhang.ai承诺不存储用户的请求内容和响应数据,所有数据在处理完成后立即删除。最后,平台已通过ISO 27001信息安全认证,并定期接受第三方安全审计。对于特别注重数据安全的企业用户,还提供私有化部署方案,将中转服务部署在企业内网,实现100%的数据控制权。

Q2:相比官方API,使用中转服务会影响响应速度吗?

实测数据对比:根据2025年1月的最新测试数据,LaoZhang.ai不仅没有降低响应速度,反而在多数情况下表现更优。具体数据如下:从北京访问OpenAI官方API的平均延迟为312ms,而通过LaoZhang.ai中转后降至52ms,速度提升83%。这是因为LaoZhang.ai在国内部署了多个BGP机房,就近接入用户请求,再通过专线连接到海外API服务器。同时,平台采用了智能路由技术,实时选择最优线路,避开网络拥堵。在并发处理能力上,LaoZhang.ai支持1000 QPS的并发请求,配备自动扩容机制,可在流量高峰期动态增加服务器资源。实际使用中,99%的请求可在100ms内获得首字节响应,完全满足实时应用的需求。

Q3:如果LaoZhang.ai服务出现问题,如何保障业务连续性?

完整保障方案:LaoZhang.ai提供了全方位的业务连续性保障。技术层面,采用多活架构部署,在北京、上海、深圳三地设有独立机房,任一机房故障可在10秒内自动切换。API网关层实现了请求级别的故障转移,单个请求失败会自动重试其他节点。服务层面,提供99.95%的SLA保证,若可用性低于承诺标准,按照故障时长进行赔偿。对于企业客户,提供7×24小时专属技术支持,关键问题15分钟内响应。此外,平台提供详细的状态监控页面(status.laozhang.ai),实时展示各项服务指标。建议用户在代码中实现降级策略,设置备用API渠道,虽然一般情况下不会用到,但可以做到万无一失。同时,平台提供API调用日志导出功能,方便用户进行问题排查和成本分析。

Q4:价格这么便宜,会不会有什么隐藏费用或使用限制?

透明定价承诺:LaoZhang.ai采用完全透明的定价策略,没有任何隐藏费用。所有费用都按照实际使用量计算,精确到token级别,在控制台可实时查看消费明细。平台不收取月费、年费等固定费用,也没有最低消费要求,真正做到用多少付多少。在使用限制方面,免费额度用户的QPS限制为10次/秒,付费用户默认100次/秒,可申请提升至1000次/秒。单次请求的最大token数遵循各模型官方限制(如GPT-4o为128K tokens)。没有月度使用量上限,但为防止异常使用,设有日消费限额保护(默认$100/天,可调整)。充值采用预付费模式,支持支付宝、微信支付,实时到账。余额永不过期,且支持随时导出使用记录。真正让用户省钱的是规模采购带来的成本优势,而非通过隐藏条款获利。

【总结】选择LaoZhang.ai,开启AI开发省钱之旅

通过本文的详细分析,我们可以得出明确结论:对于95%的国内AI开发者和企业来说,LaoZhang.ai是2025年最具性价比的大模型API解决方案。它不仅解决了支付难题,提供了稳定快速的访问体验,更重要的是实实在在地降低了30-70%的API成本。

核心优势总结:

- 💰 价格优势:所有模型统一7折,月省数百至数千美元

- 🎁 新手福利:注册送$10,足够完成原型开发

- 🚀 性能卓越:延迟52ms,可用性99.95%

- 🔧 使用简单:5分钟完成接入,代码改动最小

- 🛡️ 安全可靠:企业级安全保障,支持私有化部署

立即行动:

- 点击专属链接注册:https://api.laozhang.ai/register/

- 获取$10免费额度,开始你的AI之旅

- 加入开发者社区,获取更多使用技巧

记住,在AI时代,降低成本就是提升竞争力。选择正确的API服务商,让你把更多资源投入到产品创新上,而不是被高昂的API账单拖累。LaoZhang.ai,让每个开发者都能用得起最先进的AI技术!

更新日志:本文基于2025年1月最新数据编写,API价格和功能可能会有调整,请以官网最新信息为准。