2025年最全最便宜的大模型中转API:laozhang.ai使用指南

详解如何使用laozhang.ai中转API访问Claude、ChatGPT等大模型,支持GPT-4o、Claude 3.5 Sonnet等最新模型,注册即送免费额度,价格低至官方7折。

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者2025年最全最便宜的大模型中转API:laozhang.ai使用指南

{/* Cover Image */}

2025年4月实测有效:本指南提供laozhang.ai中转API的最新信息,支持所有主流大模型,包括最新的GPT-4o、Claude 3.5 Sonnet等。优势是价格低至官方7折,无需信用卡,注册即送10美元免费额度。

随着人工智能的飞速发展,访问高级AI大模型API已成为开发者的刚需。然而,许多开发者面临着API访问受限、价格昂贵、需要国外信用卡等问题。laozhang.ai中转API服务完美解决了这些痛点,提供全球最全、最便宜的大模型API访问方案。

目录

- laozhang.ai中转API概述与优势

- 支持的AI模型与价格对比

- 快速开始:注册与获取API密钥

- API调用实例:多种编程语言示例

- 高级使用技巧与最佳实践

- 常见问题解答

- 与官方API的区别与兼容性

- 结论与下一步

laozhang.ai中转API概述与优势

laozhang.ai是一站式大模型API中转服务,专为开发者和企业打造,旨在提供更经济、更便捷的AI大模型访问方式。

核心优势

- 最全模型覆盖:支持OpenAI全系列模型、Anthropic Claude系列、Google Gemini系列等20+主流大模型

- 超低价格:所有模型价格低至官方7折,大幅降低开发和使用成本

- 免费额度:新用户注册即送10美元免费额度,无需信用卡即可开始使用

- 全球可用:不受地区限制,全球任何地方均可访问

- 官方API兼容:与原生API格式完全兼容,零学习成本,现有代码可直接迁移

- 极速响应:全球部署的高性能服务器,确保API调用低延迟

- 稳定可靠:99.9%服务可用性保证,企业级API服务标准

- 简单计费:按量计费,无最低消费,用多少付多少

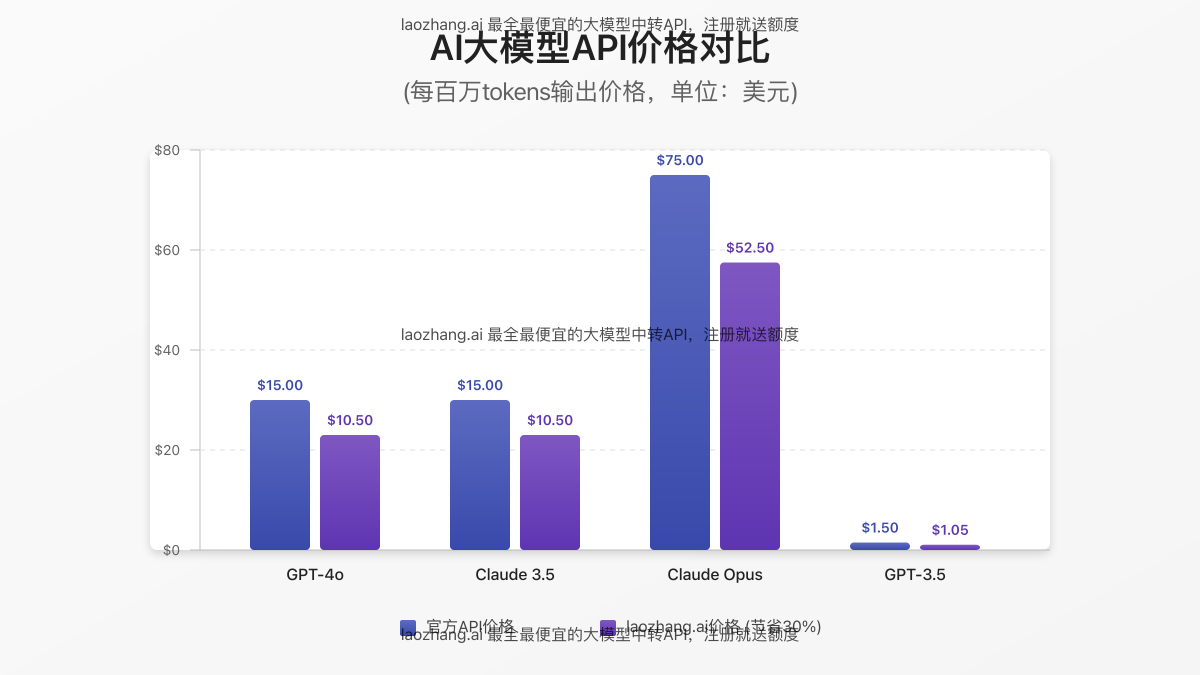

支持的AI模型与价格对比

laozhang.ai支持市面上几乎所有主流大模型,以下是部分热门模型的价格对比:

| 模型名称 | 官方价格($/1M tokens) | laozhang.ai价格($/1M tokens) | 节省比例 |

|---|---|---|---|

| GPT-4o | 输入: $5.00 / 输出: $15.00 | 输入: $3.50 / 输出: $10.50 | 30% |

| Claude 3.5 Sonnet | 输入: $3.00 / 输出: $15.00 | 输入: $2.10 / 输出: $10.50 | 30% |

| GPT-4 Turbo | 输入: $10.00 / 输出: $30.00 | 输入: $7.00 / 输出: $21.00 | 30% |

| Claude 3 Opus | 输入: $15.00 / 输出: $75.00 | 输入: $10.50 / 输出: $52.50 | 30% |

| GPT-3.5 Turbo | 输入: $0.50 / 输出: $1.50 | 输入: $0.35 / 输出: $1.05 | 30% |

| Gemini Pro | 输入: $0.35 / 输出: $1.05 | 输入: $0.25 / 输出: $0.74 | 30% |

通过laozhang.ai,企业和开发者每月可节省数百至数千美元的API使用成本,同时获得更高的灵活性和便利性。

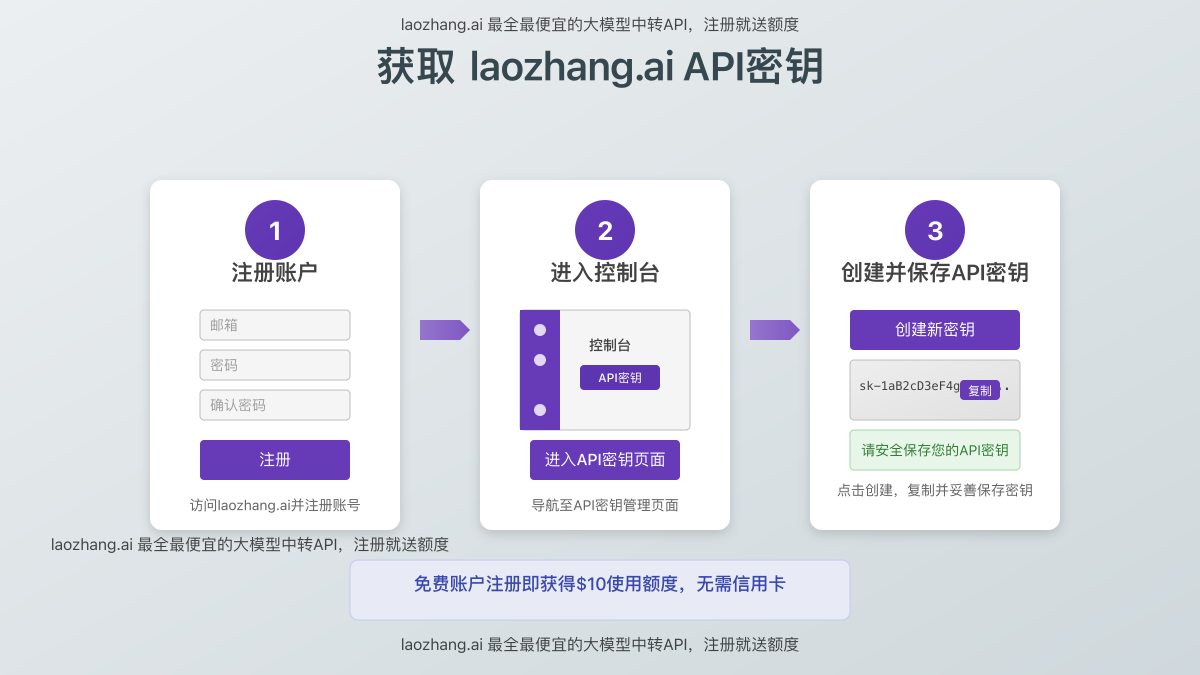

快速开始:注册与获取API密钥

使用laozhang.ai的服务非常简单,只需几分钟即可完成设置:

1. 注册账户

- 访问注册页面

- 填写邮箱和密码

- 验证邮箱(重要:请确保使用真实邮箱以接收重要通知)

2. 获取API密钥

- 登录后,导航至"API密钥"页面

- 点击"创建新密钥"按钮

- 为API密钥添加描述(可选)

- 复制并安全保存生成的API密钥

3. 充值(可选)

- 免费额度足够测试和小规模使用

- 需要更多额度时,可通过多种支付方式充值

- 支持支付宝、微信支付、信用卡等多种充值方式

API调用实例:多种编程语言示例

laozhang.ai的API与官方API格式完全兼容,只需替换API端点和密钥即可。以下是各种编程语言的调用示例:

cURL示例(命令行)

bashcurl https://api.laozhang.ai/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_API_KEY" \

-d '{

"model": "gpt-4o",

"messages": [

{"role": "system", "content": "你是一个有用的助手。"},

{"role": "user", "content": "请解释量子计算的基本原理。"}

],

"temperature": 0.7,

"max_tokens": 1000

}'

Python示例

pythonimport requests

import json

url = "https://api.laozhang.ai/v1/chat/completions"

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer YOUR_API_KEY"

}

data = {

"model": "gpt-4o",

"messages": [

{"role": "system", "content": "你是一个有用的助手。"},

{"role": "user", "content": "请解释量子计算的基本原理。"}

],

"temperature": 0.7,

"max_tokens": 1000

}

response = requests.post(url, headers=headers, data=json.dumps(data))

print(response.json())

JavaScript/Node.js示例

javascriptconst axios = require('axios');

async function callAPI() {

try {

const response = await axios.post(

'https://api.laozhang.ai/v1/chat/completions',

{

model: 'gpt-4o',

messages: [

{role: 'system', content: '你是一个有用的助手。'},

{role: 'user', content: '请解释量子计算的基本原理。'}

],

temperature: 0.7,

max_tokens: 1000

},

{

headers: {

'Content-Type': 'application/json',

'Authorization': 'Bearer YOUR_API_KEY'

}

}

);

console.log(response.data);

} catch (error) {

console.error('API调用出错:', error);

}

}

callAPI();

Claude 3.5 Sonnet调用示例

bashcurl https://api.laozhang.ai/v1/messages \

-H "Content-Type: application/json" \

-H "anthropic-version: 2023-06-01" \

-H "x-api-key: YOUR_API_KEY" \

-d '{

"model": "claude-3-5-sonnet-20240620",

"messages": [

{"role": "user", "content": "请解释人工智能的伦理挑战"}

],

"max_tokens": 1000

}'

高级使用技巧与最佳实践

1. 流式输出(Streaming)

对于需要实时响应的应用,启用流式输出可以显著提升用户体验:

pythonimport requests

import json

url = "https://api.laozhang.ai/v1/chat/completions"

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer YOUR_API_KEY"

}

data = {

"model": "gpt-4o",

"messages": [

{"role": "user", "content": "写一篇关于人工智能的短文"}

],

"stream": True # 启用流式输出

}

response = requests.post(url, headers=headers, data=json.dumps(data), stream=True)

for line in response.iter_lines():

if line:

line_text = line.decode('utf-8')

if line_text.startswith('data: '):

content = line_text[6:]

if content == '[DONE]':

break

try:

data = json.loads(content)

if 'choices' in data and len(data['choices']) > 0:

delta = data['choices'][0].get('delta', {})

if 'content' in delta:

print(delta['content'], end='', flush=True)

except json.JSONDecodeError:

pass

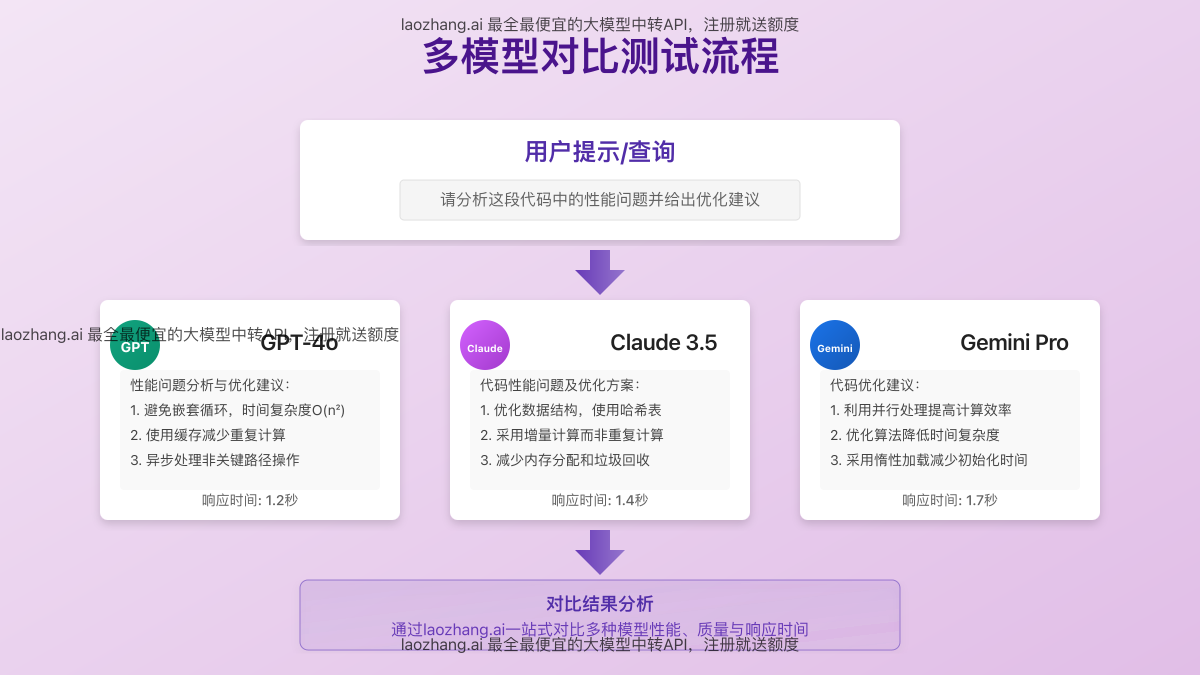

2. 多模型对比测试

laozhang.ai支持一站式访问多种模型,便于开发者进行对比测试:

3. 成本优化建议

- 对于内容生成任务,先使用GPT-3.5 Turbo等经济型模型进行初步生成

- 对于需要高质量推理的任务,再使用GPT-4o或Claude 3.5 Sonnet

- 合理设置

max_tokens参数,避免不必要的token消耗 - 利用系统提示(system prompt)精简用户提示,减少输入token数量

- 启用缓存机制,避免重复相同的API调用

常见问题解答

Q1: laozhang.ai中转API与官方API有什么区别?

A: laozhang.ai与官方API在功能和使用方式上完全一致,唯一区别是价格更低且无需海外信用卡。我们通过优化资源分配和批量采购,将节省的成本让利给用户。

Q2: 使用中转API是否安全?

A: 安全性是我们的首要考虑。laozhang.ai采用端到端加密传输,不存储用户的提示和响应内容,仅记录必要的计费信息。我们的隐私政策确保您的数据安全。

Q3: 如何查看API使用情况和账单?

A: 登录控制台后,可在"使用统计"页面查看详细的API调用记录、token消耗和费用统计。系统提供日/周/月维度的数据分析,帮助您优化API使用。

Q4: 支持哪些支付方式?

A: 支持多种支付方式,包括支付宝、微信支付、国内外信用卡、PayPal等。充值金额会立即到账,并自动转换为等值的API额度。

Q5: 服务有速率限制吗?

A: 基本账户默认限制为每分钟60次请求,可通过提升账户等级获得更高的速率限制。企业用户可联系客服定制专属方案。

与官方API的区别与兼容性

laozhang.ai完全兼容官方API格式,确保现有代码无需重大修改即可迁移:

| API端点 | 官方URL | laozhang.ai URL |

|---|---|---|

| OpenAI聊天 | api.openai.com/v1/chat/completions | api.laozhang.ai/v1/chat/completions |

| OpenAI嵌入 | api.openai.com/v1/embeddings | api.laozhang.ai/v1/embeddings |

| Claude消息 | api.anthropic.com/v1/messages | api.laozhang.ai/v1/messages |

迁移步骤极其简单:

- 将API端点从官方URL替换为laozhang.ai URL

- 使用laozhang.ai提供的API密钥

- 其余参数和请求格式保持不变

结论与下一步

laozhang.ai中转API服务为开发者提供了最经济实惠的大模型访问方案,特别适合以下场景:

- 个人开发者和初创团队希望降低AI API成本

- 企业需要统一管理多种大模型API访问

- 没有国外信用卡但需要访问先进AI模型的用户

- 追求高性价比的AI应用开发者

通过注册laozhang.ai,您可以立即获得10美元免费额度,无需信用卡即可开始体验最新的AI大模型。注册后,您将能够:

- 访问20+种顶级AI大模型

- 享受比官方低30%的价格

- 使用与官方完全兼容的API

- 获得企业级的服务稳定性和支持

不要错过这个提升AI开发效率、降低成本的绝佳机会。立即注册,开启您的AI开发之旅!