LobeChat 本地部署完全指南:Docker、数据库版与 Ollama 该怎么选

基于 2026-03-18 官方文档核验,梳理 LobeChat 单容器、数据库版 Docker Compose 和 Ollama 接入三条路径,帮助你先选对部署模式,再开始动手。

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者很多 LobeChat 部署文章的问题,不是命令不够多,而是先把问题问错了。对今天的大多数读者来说,真正的选择并不是“8 种方式里哪一种最酷”,而是“我现在到底该先跑一个轻量可用的实例,还是直接进入数据库版架构”。

这件事在 2026 年尤其重要,因为官方文档本身已经把部署路径拆得更清楚了。当前你至少要区分两条主线:单容器的 lobehub/lobe-chat,以及服务端数据库版的 lobehub/lobe-chat-database(LobeHub 官方 Docker / 数据库版文档,核验时间 2026-03-18)。如果文章还把它们混成一套“从轻到重的 8 个方案”,读者最后大概率会把架构选错。

本文按这个逻辑重写。你会先看到一张部署模式决策矩阵,再分别看三条当前仍有效的路径:单容器快速部署、数据库版 Docker Compose、以及 Ollama 本地模型接入。文章最后还会给出迁移触发条件,帮助你判断什么时候该升级,而不是一开始就把所有组件堆满。若你后续要继续打通知识库或模型代理配置,可以分别接着看我们的 LobeChat 本地知识库指南 和 LobeChat 自定义 API 指南。

TL;DR

如果你现在的目标只是自己先跑起来、确认界面和模型链路可用,优先选单容器 Docker 路径,当前官方示例已经统一到

3210:3210端口(LobeHub 官方 Docker 文档,核验时间 2026-03-18)。如果你已经明确需要账号体系、对象存储、可持续持久化,或者准备走团队共享和公网域名访问,就不要在单容器上反复打补丁,直接进入数据库版部署。官方当前 Compose 文档也已经把这条路径拆成

Local、Port、Domain三种模式,并要求检查3210、8000、9000、9001端口(LobeHub 官方数据库版 Docker Compose 文档,核验时间 2026-03-18)。Ollama 很适合降低模型调用外部依赖,但它解决的是“模型从哪里来”,不是“存储、认证、备份怎么做”。把 Ollama 接进来,不等于你的部署就天然变成完整离线方案。

先做一个判断:你要的是轻量体验,还是长期服务

很多教程会把部署动作从“安装 Docker”一路写到“公网域名 + 反向代理 + 数据库 + 认证服务”,看起来很完整,但这对多数首次部署者并不友好。你第一次动手时最容易做错的,不是命令敲错,而是把原本只需要半小时验证的事情,升级成了一个需要持续维护的服务栈。

从官方当前文档看,LobeChat 的部署思路已经很明确。单容器 Docker 路径强调的是快速启动、尽快访问和尽快验证;数据库版文档强调的是服务端持久化、多组件协作以及对外访问模式的选择(LobeHub 官方 Docker / 数据库版 Docker Compose 文档,核验时间 2026-03-18)。这两条路径不是“一个给小白,一个给高手”这么简单,而是分别对应两种完全不同的运行目标。

如果你今天只需要一件事,那就是先诚实回答下面这个问题:你的第一目标是“把 LobeChat 跑起来”,还是“把 LobeChat 变成可持续运营的服务”。前者适合单容器,后者通常应该直接进入数据库版。真正浪费时间的,是明明只需要前者,却把自己拖进后者;或者明明已经需要后者,却还在单容器上叠临时补丁。

部署模式决策矩阵

下面这张表是本文最重要的部分。它的作用不是比较术语,而是帮你在动手前先排除错误路径。

| 你的真实需求 | 推荐起点 | 为什么 | 先别做什么 |

|---|---|---|---|

| 只想自己先体验,确认模型能跑、界面能用 | 单容器 Docker | 当前官方示例最短,3210:3210 直接可用(LobeHub 官方 Docker 文档,核验时间 2026-03-18) | 不要一开始就配数据库、S3、认证服务 |

| 想在本地机器上尽量减少云模型依赖 | 单容器 Docker + Ollama | 官方当前本地模型示例直接走 OLLAMA_PROXY_URL(LobeHub 官方 Local LLM 文档,核验时间 2026-03-18) | 不要把“接了 Ollama”误解成“存储和认证也自动本地化” |

| 明确要做多设备长期使用、稳定持久化、公共访问 | 数据库版 Docker / Docker Compose | 官方数据库版文档已拆分 Local / Port / Domain 模式,并以 PostgreSQL、对象存储、认证服务为基础(LobeHub 官方数据库版 Docker Compose 文档,核验时间 2026-03-18) | 不要继续把单容器当成长期生产方案 |

| 需要团队账号、对象存储、后续知识库能力 | 直接数据库版 | 单容器能让你尽快体验,但长期能力边界很快会暴露 | 不要先把时间花在旧教程的端口和变量兼容上 |

这张矩阵真正想帮你避免的,是两种常见失误。第一种是“我先把最复杂的都装上,省得以后迁移”,结果你还没用起来,就已经被数据库、对象存储和认证配置拖住。第二种是“我先用最简单的方案,后面再说”,结果你明明已经需要稳定共享和长期持久化,却还在单容器上做一层层不可维护的补丁。部署的关键不是一步到位,而是第一步就走在对的方向上。

路径一:先把单容器跑起来

如果你的目标是最快拿到一个可访问的 LobeChat 实例,当前最直接的路径仍然是官方 Docker 单容器示例。旧文章里常见的 8080:3000 已经不是当前官方写法,当前示例统一使用 3210:3210(LobeHub 官方 Docker 文档,核验时间 2026-03-18)。

最小可用命令可以写成这样:

bashdocker run -d \ --name lobe-chat \ -p 3210:3210 \ -e ACCESS_CODE=change-this-password \ -e OPENAI_API_KEY=sk-your-key \ lobehub/lobe-chat

如果你需要通过代理地址转发 OpenAI 请求,当前官方文档示例使用的是 OPENAI_PROXY_URL,不是很多旧教程里的 OPENAI_API_BASE_URL(LobeHub 官方 Docker 文档,核验时间 2026-03-18):

bashdocker run -d \ --name lobe-chat \ -p 3210:3210 \ -e ACCESS_CODE=change-this-password \ -e OPENAI_API_KEY=sk-your-key \ -e OPENAI_PROXY_URL=https://your-proxy.example/v1 \ lobehub/lobe-chat

这条路径的价值,不是让你永远停留在单容器,而是让你最快知道三件事:LobeChat 界面是否符合你的使用习惯、模型链路是否可达、你的机器资源是否足够支撑日常会话。对第一次评估产品的人来说,这比直接搭整套基础设施更重要。

这里还有两个容易误判的点。第一,官方文档明确建议设置 ACCESS_CODE,原因很直接:如果你把实例暴露出去却没有保护入口,最先出问题的通常不是应用本身,而是你配置进去的 API Key(LobeHub 官方 Docker 文档,核验时间 2026-03-18)。第二,官方也特别提示,镜像构建本身可能需要大约半小时,所以你刚部署完就看到“有更新”并不一定代表你的版本有问题(LobeHub 官方 Docker 文档,核验时间 2026-03-18)。

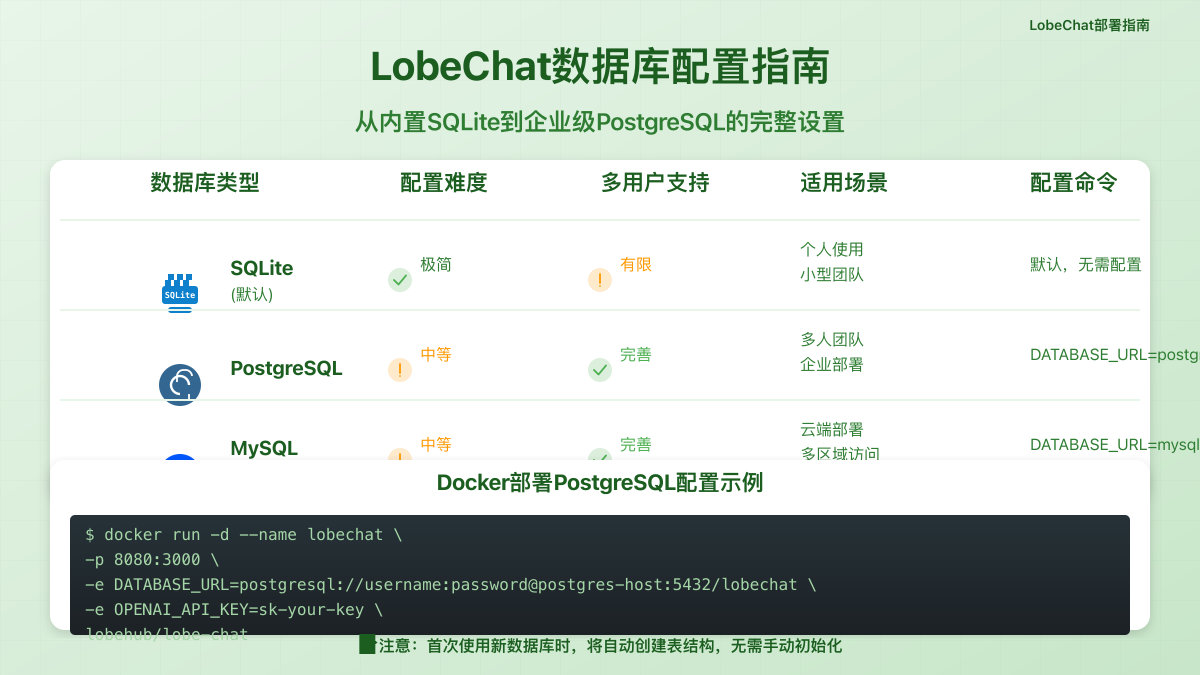

路径二:什么时候该直接上数据库版

一旦你对 LobeChat 的期待从“我自己先跑起来”变成“我要把它作为持续使用的服务”,数据库版就不再是“高级可选项”,而是更稳妥的起点。当前官方数据库版文档已经明确使用 lobehub/lobe-chat-database 镜像,并把关键组件拆得很清楚:PostgreSQL、S3 兼容对象存储,以及认证服务(LobeHub 官方数据库版 Docker / Docker Compose 文档,核验时间 2026-03-18)。

官方 Compose 文档对这条路径的 framing 也很清楚。它不是简单说“这里有个更长的 compose 文件”,而是直接把部署分成 Local、Port、Domain 三种访问模式,并要求你先确认 3210、8000、9000、9001 这些端口是否可用(LobeHub 官方数据库版 Docker Compose 文档,核验时间 2026-03-18)。这意味着数据库版从设计上就是一套服务,而不只是单容器再多挂几个环境变量。

如果你想先按官方的一键脚本把数据库版跑起来,当前文档给出的起手式如下:

bashmkdir -p ~/lobe-chat-db

cd ~/lobe-chat-db

bash <(curl -fsSL https://lobe.li/setup.sh) -l en

这条命令适合 Linux 或 macOS。官方当前文档还特别说明,如果你在 Windows 上走一键脚本,需要通过 WSL 2 执行(LobeHub 官方数据库版 Docker Compose 文档,核验时间 2026-03-18)。

数据库版还有一个旧教程常常忽略的边界:官方 Docker / Docker Compose 文档明确写明,环境变量无法注入 NEXT_PUBLIC_CLERK_PUBLISHABLE_KEY,因此不能直接启用 Clerk 认证;如果你必须使用 Clerk,官方建议改走 Vercel 或自建镜像流程(LobeHub 官方数据库版 Docker / Docker Compose 文档,核验时间 2026-03-18)。这类限制比“命令能不能跑起来”更重要,因为它会直接影响你后续的认证方案。

路径三:把 Ollama 接进来,但不要把它误解成“完整离线”

LobeChat 支持把本地模型接进来,这是它非常有吸引力的一点。官方当前本地模型文档给出的 Docker 示例,已经使用 OLLAMA_PROXY_URL=http://host.docker.internal:11434/v1 这套写法(LobeHub 官方 Local LLM 文档,核验时间 2026-03-18)。如果你机器上已经跑着 Ollama,这确实能显著降低你对外部模型服务的依赖。

最小命令如下:

bashdocker run -d \ --name lobe-chat \ -p 3210:3210 \ -e OLLAMA_PROXY_URL=http://host.docker.internal:11434/v1 \ lobehub/lobe-chat

这里最重要的理解,不是命令本身,而是边界。把 Ollama 接入 LobeChat,解决的是模型推理端的本地化问题;它并不会自动替你解决长期存储、对象存储、认证、备份和公网访问问题。如果你同时还在用云端模型或外部嵌入服务,那也不能把整套方案称为“完全离线”。很多教程喜欢把“本地模型”和“本地部署”直接画等号,这会误导读者低估后续的运维工作。

另一个实践坑是网络地址。官方数据库版 Docker 文档已经明确解释过,在 Docker for macOS / Windows 环境里,容器内的 localhost 指向容器自身,所以当你要从容器连接本机运行的 Postgres、Ollama 或其他服务时,应优先尝试 host.docker.internal(LobeHub 官方数据库版 Docker 文档,核验时间 2026-03-18)。这也是为什么很多人照着旧文把 127.0.0.1 写进去,却始终连不上本地服务。

迁移路线:什么时候从单容器升级到数据库版

这一步比“再学一个 compose 文件”更重要。真正高质量的部署文,不该只告诉你怎么开始,还应该告诉你什么时候该停止在当前架构上继续投入时间。

| 出现的信号 | 这意味着什么 | 建议动作 |

|---|---|---|

| 你已经开始把它当成长期工具,而不只是试用 | 单容器从验证环境变成了长期环境 | 尽快评估数据库版,至少把持久化、备份和访问方式设计清楚 |

| 你需要公网域名、反向代理和稳定访问模式 | 访问层已经不再是“本机打开浏览器” | 直接参考官方 Port / Domain 模式,而不是继续裸露单容器端口 |

| 你要处理多人共享、账号隔离或对象存储 | 应用边界已经进入服务边界 | 不要再把所有问题都压在一个容器和几个环境变量上 |

| 你计划继续做知识库、文件上传或更完整的数据管理 | 数据面复杂度已经提升 | 把数据库版作为主线,再单独规划模型与知识库能力 |

我的建议是这样:如果你还处在“验证产品是不是适合我”的阶段,就让单容器承担这个责任,不要让它承担更多;一旦你已经知道自己会长期用,就尽快切到数据库版,让架构和目标保持一致。最浪费时间的做法,就是在一个已经明显不适合的起点上继续修修补补。

运维和安全边界:这几个坑比命令本身更重要

第一,不要把“我只是临时跑一下”理解成“安全可以先不管”。只要这个实例能被别人访问到,你就应该把 ACCESS_CODE 当成最低限度,而不是可选项(LobeHub 官方 Docker 文档,核验时间 2026-03-18)。部署速度可以快,但默认暴露出去再补密码,通常会比一开始多写一行环境变量更麻烦。

第二,如果你准备把数据库版公开到外网,官方当前文档明确建议在公网可访问场景下关闭注册,并把域名反代配置做完整(LobeHub 官方数据库版 Docker Compose 文档,核验时间 2026-03-18)。这一点很重要,因为数据库版默认会牵出应用入口、认证入口和对象存储入口。你不是只在发布一个 Web UI,而是在发布一整套服务面。

第三,不要把部署文和模型接入文混成一篇。部署的核心是“应用怎么跑”和“状态怎么存”;模型接入的核心是“请求打到哪里”和“费用、延迟、可用性怎么平衡”。如果你部署已经跑通,下一步要做的是模型配置,请转到我们的 LobeChat 自定义 API 指南;如果你下一步要做的是知识库和文件工作流,请继续看 LobeChat 本地知识库指南。把这几个问题分开处理,系统会更稳,你自己的判断也会更清晰。

FAQ

为什么这篇文章不再推荐 8080:3000 和旧变量名?

因为当前官方文档已经不是那套示例了。单容器 Docker 的当前示例使用 3210:3210,代理变量使用 OPENAI_PROXY_URL;Ollama 接入示例使用 OLLAMA_PROXY_URL(LobeHub 官方 Docker / Local LLM 文档,核验时间 2026-03-18)。这并不意味着历史写法在所有版本上都一定立刻失效,但如果你今天重新部署,优先跟当前官方文档对齐,会比继续抄旧文章更稳。

我只是自己用,是不是完全没必要上数据库版?

大多数情况下,是的。只要你的目标还是“自己先用起来”,单容器路径通常更合适。它的优势不是功能更强,而是决策成本更低。你先确认使用频率、模型链路和机器资源,再决定要不要升级,会比一开始就把 PostgreSQL、对象存储和认证服务全部引进来更理性。

但这并不等于数据库版永远不需要。只要你的目标已经变成长期使用、对外访问、稳定持久化或多人共享,数据库版就不是“以后再说”的优化项,而是架构层面的分水岭。

公网访问时该选 Port 还是 Domain 模式?

如果你只是临时在局域网或公网 IP 上做访问测试,Port 模式更直接;如果你已经准备走正式域名、HTTPS 和完整反向代理,那就应该进入 Domain 模式。官方当前数据库版 Compose 文档就是按这两种对外场景来拆说明的(LobeHub 官方数据库版 Docker Compose 文档,核验时间 2026-03-18)。

真正需要避免的,是一边追求长期公网访问,一边还把所有东西暴露在默认端口上。那不是“省事”,而是在把后续维护成本提前埋雷。

为什么我在 Mac 或 Windows 上总是连不上本机的 Ollama 或 Postgres?

因为容器里的 localhost 不是你宿主机的 localhost。官方数据库版 Docker 文档已经专门提醒,在 Docker for macOS / Windows 下,如果你想从容器访问宿主机上的服务,应优先使用 host.docker.internal(LobeHub 官方数据库版 Docker 文档,核验时间 2026-03-18)。

这也是为什么很多人明明已经在本机跑起了 Ollama,却还是觉得 LobeChat “配置没生效”。问题经常不在应用,而在网络指向。

部署后马上提示有更新,是不是我装错版本了?

不一定。官方 Docker 文档明确提到,镜像构建本身可能需要大约半小时,所以新版本发布后的一段时间里,网页或应用里看到“有更新”并不代表你部署失败(LobeHub 官方 Docker 文档,核验时间 2026-03-18)。在这种情况下,先确认容器是否正常启动、功能是否可用,比立刻反复重拉镜像更重要。

什么时候应该把这篇文章和知识库或 API 配置文章一起看?

当你的问题已经不再是“LobeChat 怎么跑起来”,而变成“模型怎么接、数据怎么管、知识库怎么做”时,就该拆分阅读了。部署文负责帮你选架构起点;模型接入文负责帮你理清服务商、代理和变量;知识库文负责帮你处理文件、向量化和持久化能力。把这三件事混在一篇里,通常只会让判断变慢。

结论:先把模式选对,再追求完备

如果你希望这篇文章只留下一个结论,那就是这句:LobeChat 本地部署的难点,不在于命令本身,而在于你是否从一开始就选对了部署模式。单容器适合验证,数据库版适合长期服务,Ollama 适合补足本地模型能力,但它们不是互相替代的同义词。

只要你先把这个判断做对,后面的部署过程会顺很多。先用最短路径确认产品适不适合自己,再在真正需要的时候升级到数据库版,这通常比一开始追求“最全方案”更节省时间,也更接近真实的使用场景。