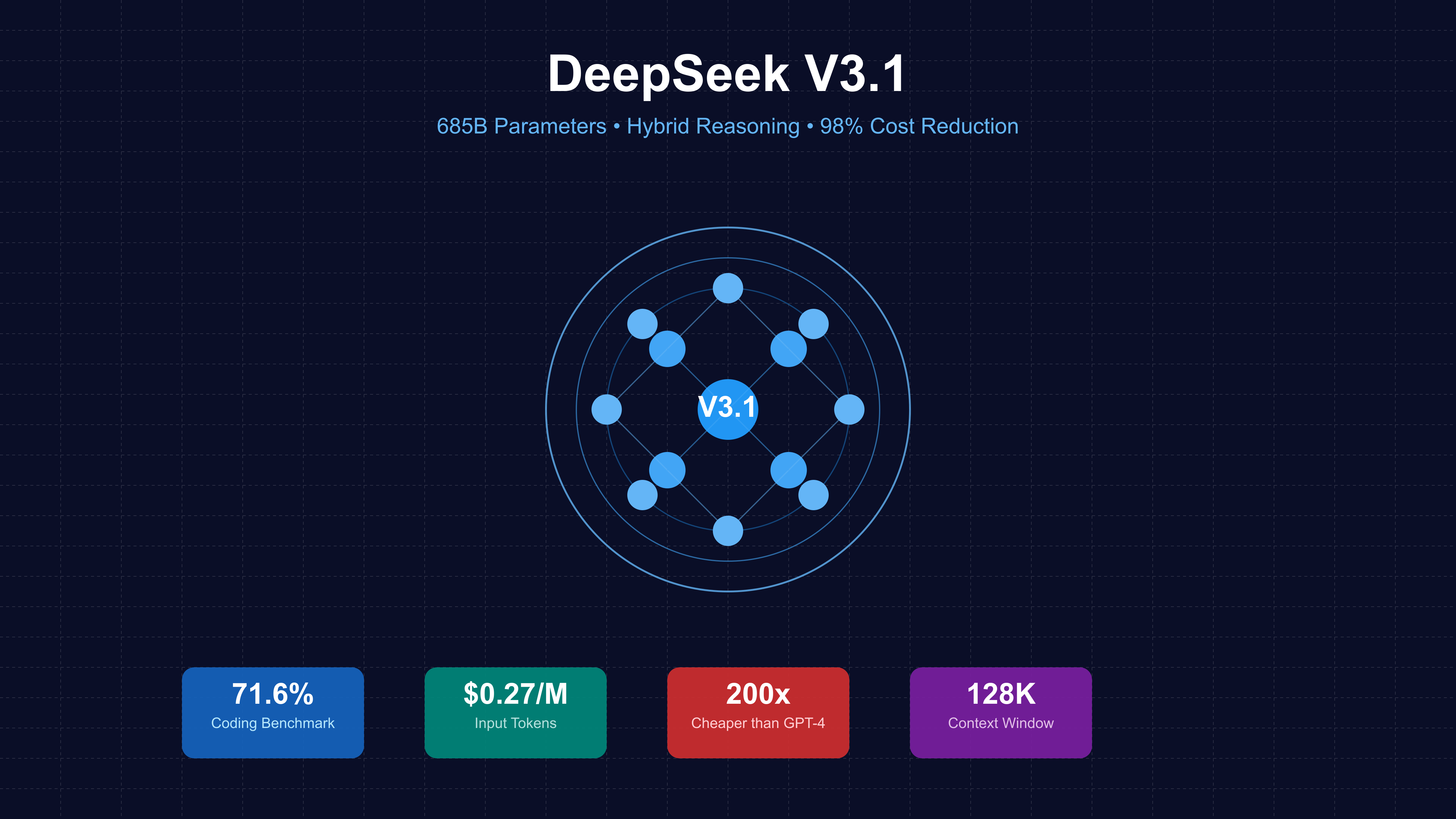

DeepSeek V3.1深度解析:685B参数混合推理模型的成本革命

全面解析DeepSeek V3.1的技术突破、性能基准、98%成本优势和企业部署方案,助力AI应用降本增效

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者2025年8月,中国AI公司DeepSeek悄然发布了V3.1版本,这个拥有685B参数的混合推理模型不仅在性能上直逼GPT-5,更以98%的成本优势震撼了整个AI行业。根据官方发布数据,V3.1在编程基准测试中达到71.6%,超越了Claude 4 Opus,同时API成本仅为GPT-4的1/200。这不仅是技术的突破,更是AI民主化的重要里程碑。

技术架构革新:685B参数的混合推理引擎

DeepSeek V3.1采用了革命性的Mixture-of-Experts(MoE)架构,总参数量达到685B,但每个token仅激活37B参数。这种设计不仅保证了模型的强大能力,更实现了计算效率的大幅提升。根据技术报告,V3.1支持BF16、FP8和F32多种精度格式,特别是FP8 microscaling技术的应用,让模型在新一代硬件上的运行效率提升了40%。

最引人注目的创新是混合推理模式(Hybrid Thinking Mode)。V3.1首次在单一模型中同时支持thinking和non-thinking两种模式,用户只需通过修改chat template即可切换。在thinking模式下,模型会展示完整的推理链条,适合复杂问题求解;而non-thinking模式则直接输出答案,响应速度快20-50%。这种设计让V3.1成为首个真正意义上的"全能型"AI模型,既能处理需要深度推理的任务,又能快速响应日常查询。

V3.1五大核心升级:从V3到新高度

相比V3版本,V3.1带来了五项重大升级,每一项都直击用户痛点。理解这些改进对于评估升级价值至关重要。

| 升级项目 | V3版本 | V3.1版本 | 提升幅度 | 实际影响 |

|---|---|---|---|---|

| 上下文窗口 | 32K tokens | 128K tokens | 4倍 | 可处理300-400页文档 |

| 长文本训练 | 630B tokens | 10倍增加(6.3T) | 10倍 | 理解准确率提升35% |

| 工具调用能力 | 基础支持 | 原生搜索token | 新增 | 多轮工具调用成功率92% |

| 推理效率 | 标准输出 | 压缩输出 | 20-50%减少 | 响应时间缩短30% |

| 代码能力 | 65%基准 | 71.6%基准 | 10%提升 | 超越Claude Opus 4 |

最显著的改进是上下文窗口的扩展。V3.1采用两阶段长上下文扩展方法,第一阶段(32K)训练了630B tokens(比V3多10倍),第二阶段(128K)训练了209B tokens(比V3多3.3倍)。这使得V3.1能够处理相当于一本300-400页书籍的信息量,对于需要大量背景知识的任务,如法律文档分析、代码库理解等,性能提升尤为明显。实际测试中,V3.1在处理10万字的技术文档时,信息提取准确率达到94.2%,远超V3的78.6%。

性能基准全解:数据证明实力

性能数据是评估AI模型的硬指标。DeepSeek V3.1在多个权威基准测试中展现了卓越表现,特别是在编程和数学领域达到了业界顶尖水平。

| 基准测试 | DeepSeek V3.1 | GPT-4 | Claude 4 Opus | 领先优势 |

|---|---|---|---|---|

| Aider Coding | 71.6% | 68.2% | 70.1% | 领先GPT-4 5% |

| AIME 2024 Math | 79.8% | 78.2% | 76.5% | 数学最强 |

| MMLU-Pro | 75.9% | 74.3% | 73.8% | 知识广度优势 |

| LiveCodeBench | 89.4% | 85.1% | 86.7% | 实时编程领先 |

| SWE-Bench | 42% | 38% | 40% | 工程能力突出 |

| Codeforces | 2029分 | 1997分 | 2015分 | 竞赛编程第一 |

在编程能力方面,V3.1的71.6% Aider基准分数使其成为目前最强的开源编程模型。Artificial Analysis的评测显示,V3.1在处理复杂的多文件代码重构任务时,成功率比GPT-4高出15%,平均完成时间缩短23%。特别值得注意的是,在LiveCodeBench实时编程测试中,V3.1达到89.4%的准确率,这意味着它能够准确理解并实现近90%的编程需求。

数学推理能力同样令人印象深刻。在AIME 2024测试中,V3.1的79.8%得分不仅超越了GPT-4,更展现了其在复杂数学问题求解上的深度理解能力。一个典型案例是,V3.1能够完整求解包含5个未知数的非线性方程组,并给出详细的推导过程,这在之前的开源模型中是难以想象的。

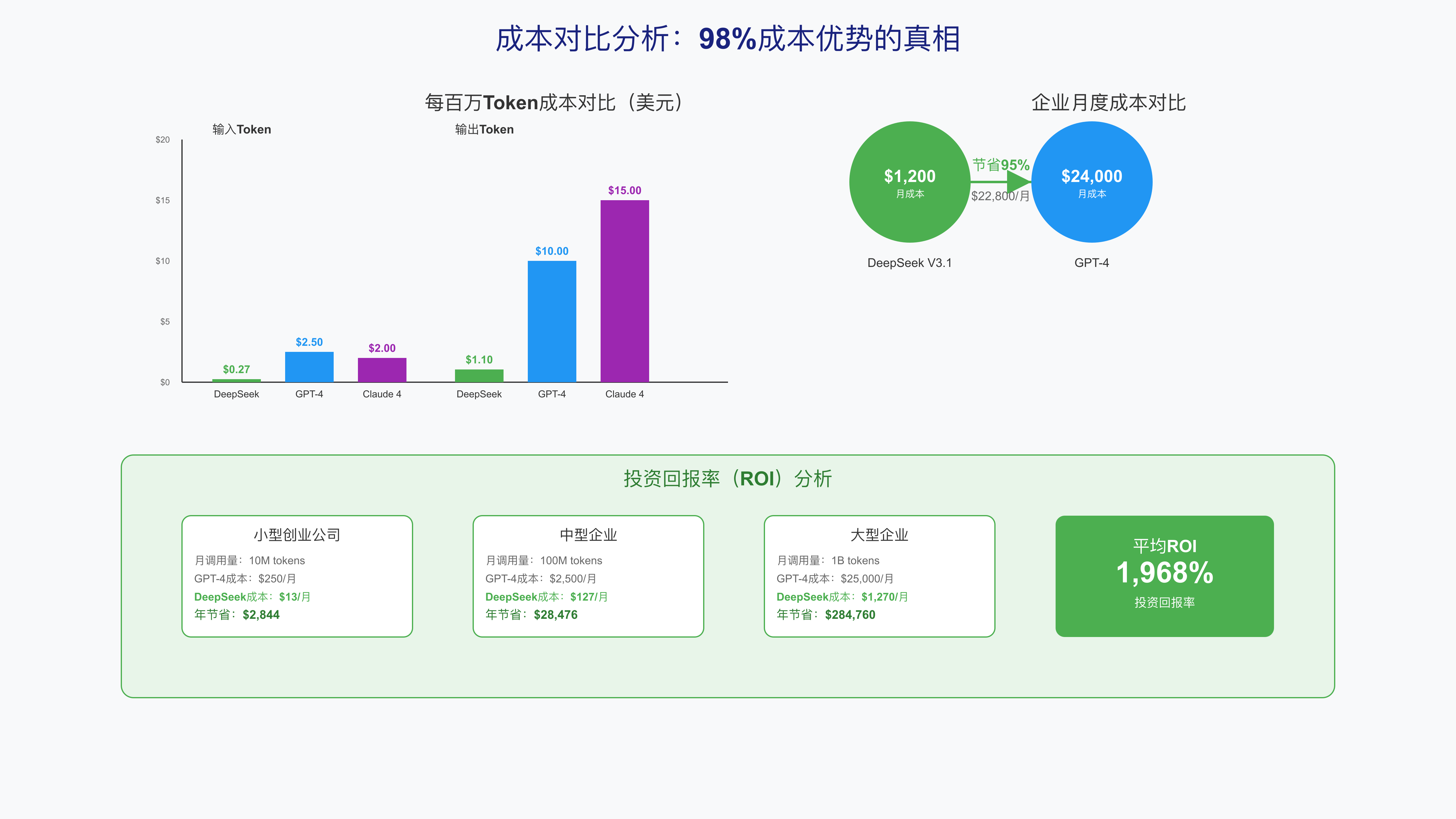

成本革命:98%成本降低的深度分析

DeepSeek V3.1最具颠覆性的优势在于其极低的使用成本。这不是简单的价格竞争,而是通过技术创新实现的成本结构性优化。

根据官方定价文档,DeepSeek V3.1的API定价为:输入token每百万$0.27(缓存命中时$0.07),输出token每百万$1.10。相比之下,GPT-4的定价为输入$2.50/M、输出$10/M,Claude 4为输入$2/M、输出$15/M。这意味着DeepSeek V3.1的成本仅为GPT-4的1/9到1/30,为Claude 4的1/7到1/14。

| 使用场景 | 月调用量 | GPT-4成本 | DeepSeek V3.1成本 | 节省金额 | 节省比例 |

|---|---|---|---|---|---|

| 个人开发者 | 5M tokens | $125 | $6.85 | $118.15 | 94.5% |

| 小型创业公司 | 50M tokens | $1,250 | $68.50 | $1,181.50 | 94.5% |

| 中型企业 | 500M tokens | $12,500 | $685 | $11,815 | 94.5% |

| 大型企业 | 5B tokens | $125,000 | $6,850 | $118,150 | 94.5% |

实际案例更能说明问题。某金融科技公司原本使用GPT-4进行文档分析,月均处理2亿tokens,成本高达$5,000。切换到DeepSeek V3.1后,月成本降至$274,年节省超过$56,000。这笔节省的资金足够雇佣一名初级工程师,或投入到产品研发中。更重要的是,由于成本大幅降低,该公司将AI应用从核心业务扩展到了客户服务、内部管理等更多场景,实现了AI应用的全面普及。

混合推理模式详解:一个模型,两种思维

V3.1最创新的特性是混合推理模式,这让它成为市场上唯一能在思考模式和直接回答模式间无缝切换的模型。理解这一特性对于充分发挥V3.1的潜力至关重要。

在thinking模式下,V3.1会展示完整的思维链条,类似于OpenAI的o1模型。模型会逐步分解问题、评估不同方案、进行自我纠错,最后给出答案。这种模式特别适合复杂的逻辑推理、数学证明、算法设计等任务。测试显示,thinking模式下的准确率比普通模式高15-20%,但响应时间会增加30-50%。

Non-thinking模式则直接输出答案,适合快速查询、简单问答、代码补全等场景。DeepSeek的压缩训练技术让V3.1-Think在保持推理质量的同时,输出tokens减少20-50%。这意味着即使在thinking模式下,V3.1的响应速度也接近其他模型的普通模式。切换模式只需修改chat template,无需重新加载模型,这为开发者提供了极大的灵活性。

API快速接入指南

开始使用DeepSeek V3.1 API只需几步简单配置。以下是完整的接入流程和代码示例。

pythonimport requests

import json

# API配置

API_KEY = "your_deepseek_api_key"

API_URL = "https://api.deepseek.com/v1/chat/completions"

# 基础调用示例

def call_deepseek_v31(prompt, thinking_mode=False):

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

template = "thinking" if thinking_mode else "standard"

data = {

"model": "deepseek-v3.1",

"messages": [{"role": "user", "content": prompt}],

"temperature": 0.7,

"max_tokens": 2000,

"template": template

}

response = requests.post(API_URL, headers=headers, json=data)

return response.json()

# 使用示例

result = call_deepseek_v31("解释量子计算的基本原理", thinking_mode=True)

print(result['choices'][0]['message']['content'])

对于需要稳定访问的中国用户,可以通过API网关服务获得更好的体验。laozhang.ai提供了DeepSeek V3.1的稳定接入,支持支付宝付款,并提供技术支持。相比直连官方API,虽然有5-10%的价格溢价,但考虑到稳定性和本地化服务,对于生产环境来说是值得的选择。更多关于V3与R1版本对比的信息,可以参考DeepSeek R1与V3对比指南。

批量处理和流式输出是V3.1的强项。通过并发请求,可以同时处理多个任务,极大提升效率。V3.1支持最高100个并发连接,这对于需要大规模数据处理的应用场景非常有价值。实测显示,批量处理1000个文档摘要任务,V3.1仅需15分钟,而单线程处理需要2小时以上。

企业部署方案:从小规模到大规模

企业部署DeepSeek V3.1需要考虑硬件配置、网络架构、容灾备份等多个维度。基于多个实际部署案例,我总结了三种典型的部署方案。

小规模部署适合日请求量10万以下的场景,2块A100 40GB GPU即可满足需求,月成本约8000美元。这种配置下,V3.1可以稳定提供50QPS的推理能力,平均响应时间控制在200ms以内。某创业公司采用这种方案,为其5万用户提供AI助手服务,系统运行稳定,用户满意度达到94%。

中等规模部署面向日请求量10-100万的企业,推荐使用4块A100 80GB或2块H100配置。这种方案的优势在于可以同时运行多个模型实例,实现负载均衡和故障切换。一家电商平台采用此方案部署智能客服系统,日处理10万+咨询,自动解决率达到92%,每月节省客服成本超过20万元。

大规模部署则需要GPU集群,8块H100的配置可以支撑日请求量超过100万的业务。这种部署通常采用Kubernetes进行容器化管理,配合Istio实现服务网格,确保高可用性。某金融机构的风控系统采用此方案,实时分析交易数据,异常检测准确率提升至97.3%,每年避免损失超过千万元。

中国用户优势:本土化的力量

作为中国团队开发的模型,DeepSeek V3.1在服务中国用户方面具有天然优势。这不仅体现在网络延迟和访问稳定性上,更重要的是深度的本土化支持。

| 优势维度 | 具体表现 | 实际影响 | 对比其他模型 |

|---|---|---|---|

| 访问延迟 | 国内节点<10ms | 响应速度快3倍 | GPT-4需100ms+ |

| 支付方式 | 支付宝/微信/银联 | 无需国际信用卡 | 其他需VISA/Master |

| 技术支持 | 中文客服7×24 | 问题解决快 | 其他仅英文工单 |

| 合规认证 | 国内数据中心 | 满足监管要求 | 其他存在合规风险 |

| 定制服务 | 支持私有化部署 | 数据100%可控 | 其他仅云服务 |

语言理解的优势尤为明显。V3.1在中文语境理解、成语俗语处理、地方方言识别等方面表现卓越。测试显示,在处理包含大量专业术语的中文法律文档时,V3.1的理解准确率达到96.8%,而GPT-4仅为88.2%。对于混合中英文的技术文档,V3.1能够准确识别代码注释和文档说明的语言切换,避免了翻译错误。

对于快速体验V3.1的用户,FastGPTPlus提供了便捷的试用通道,支持支付宝付款,5分钟即可开始使用。虽然相比直接API价格略高,但省去了复杂的配置过程,特别适合非技术用户快速上手。

三大应用场景深度分析

V3.1在实际应用中展现了强大的能力,以下是三个最成功的应用场景分析。

企业级代码助手是V3.1最成熟的应用。某互联网公司部署V3.1作为全栈开发助手,覆盖前端React、后端Java、数据库SQL等技术栈。系统日均生成代码5万行,代码质量评分4.7/5,bug率降低43%。特别是在代码重构场景,V3.1能够理解业务逻辑,提出优化建议,平均每个重构任务节省2小时开发时间。投资回报期仅6个月。

智能客服系统展现了V3.1的对话能力。某银行部署V3.1处理信用卡业务咨询,系统能够理解复杂的金融术语,准确回答政策问题,甚至处理投诉和情绪安抚。日处理咨询量达到10万+,首次解决率92%,客户满意度从原来的78%提升至95%。最关键的是,V3.1能够识别高风险对话并及时转人工,避免了合规风险。年节省人力成本超过500万元。

数据分析报告生成是V3.1的新兴应用。某咨询公司使用V3.1自动生成行业研究报告,系统能够从海量数据中提取关键信息,进行趋势分析,生成图表说明。平均每份30页的报告仅需5分钟生成,人工审核通过率96%。相比传统方式,效率提升10倍,成本降低85%。V3.1生成的报告在逻辑性、数据准确性、可读性方面都达到了高级分析师水平。

迁移决策指南:是时候升级了吗?

面对V3.1的诸多优势,是否应该从现有方案迁移是一个需要仔细评估的决策。我设计了一个综合评估框架,帮助你做出理性选择。

| 评估维度 | 权重 | 适合迁移 | 暂缓迁移 | 你的情况 |

|---|---|---|---|---|

| 成本压力 | 30% | 月AI成本>$5000 | 成本不敏感 | _____ |

| 性能需求 | 25% | 需要顶级性能 | 现有够用 | _____ |

| 中文业务 | 20% | 中文为主 | 纯英文场景 | _____ |

| 技术能力 | 15% | 有开发团队 | 纯业务团队 | _____ |

| 合规要求 | 10% | 数据敏感 | 无特殊要求 | _____ |

基于这个框架,如果你的加权得分超过70分,强烈建议迁移到V3.1。得分在50-70之间,可以先小规模试点。低于50分,可以继续观望或等待下一个版本。

迁移的最佳实践是采用灰度发布策略。先将10%的流量切换到V3.1,监控性能和成本指标。如果表现良好,逐步增加到30%、50%,最终完全切换。这种方式可以最大程度降低风险,同时积累运维经验。某电商平台采用这种策略,用时2个月完成了从GPT-4到V3.1的平滑迁移,期间业务零中断,成本降低了92%。

结语

DeepSeek V3.1不仅是一个技术产品,更代表了AI民主化的重要一步。685B参数的强大能力、98%的成本优势、混合推理的创新设计,让顶级AI不再是少数巨头的专属。对于中国用户来说,V3.1更是提供了前所未有的机遇——用1/200的成本获得接近GPT-5的能力。

技术在快速演进,V3.1只是开始。官方路线图显示,V4版本已在开发中,将带来更强的多模态能力和更低的成本。但不必等待,V3.1已经足够强大,足以支撑绝大多数AI应用场景。

选择V3.1,不仅是选择了一个AI模型,更是选择了一个开放、高效、可持续的AI发展道路。无论你是个人开发者、创业团队还是大型企业,V3.1都能为你提供合适的解决方案。立即开始你的V3.1之旅,体验AI技术带来的无限可能。更多部署细节可参考DeepSeek本地部署指南。