GPT-4o免费使用指南:ChatGPT退役后的AI访问方案与API调用实战

深度解析GPT-4o从ChatGPT退役后的最新现状,涵盖API仍可用的完整接入方案、五大免费AI替代方案对比、国内用户无需科学上网的访问方法,附Python/Node.js实战代码。

Nano Banana Pro

4K图像官方2折Google Gemini 3 Pro Image · AI图像生成

已服务 10万+ 开发者GPT-4o免费使用指南:ChatGPT退役后的AI访问方案与API调用实战

GPT-4o曾经是OpenAI最受欢迎的多模态模型,为数亿ChatGPT用户提供文本、图像、语音等多种能力。然而,OpenAI于近期正式宣布GPT-4o从ChatGPT中退役,由更强大的GPT-5.2接替其位置。对于搜索"GPT-4o免费使用"的用户来说,这意味着获取方式已经发生了根本性变化。本文将全面解析GPT-4o的最新状态、API层面的可用性,以及当前最值得推荐的免费AI使用方案。

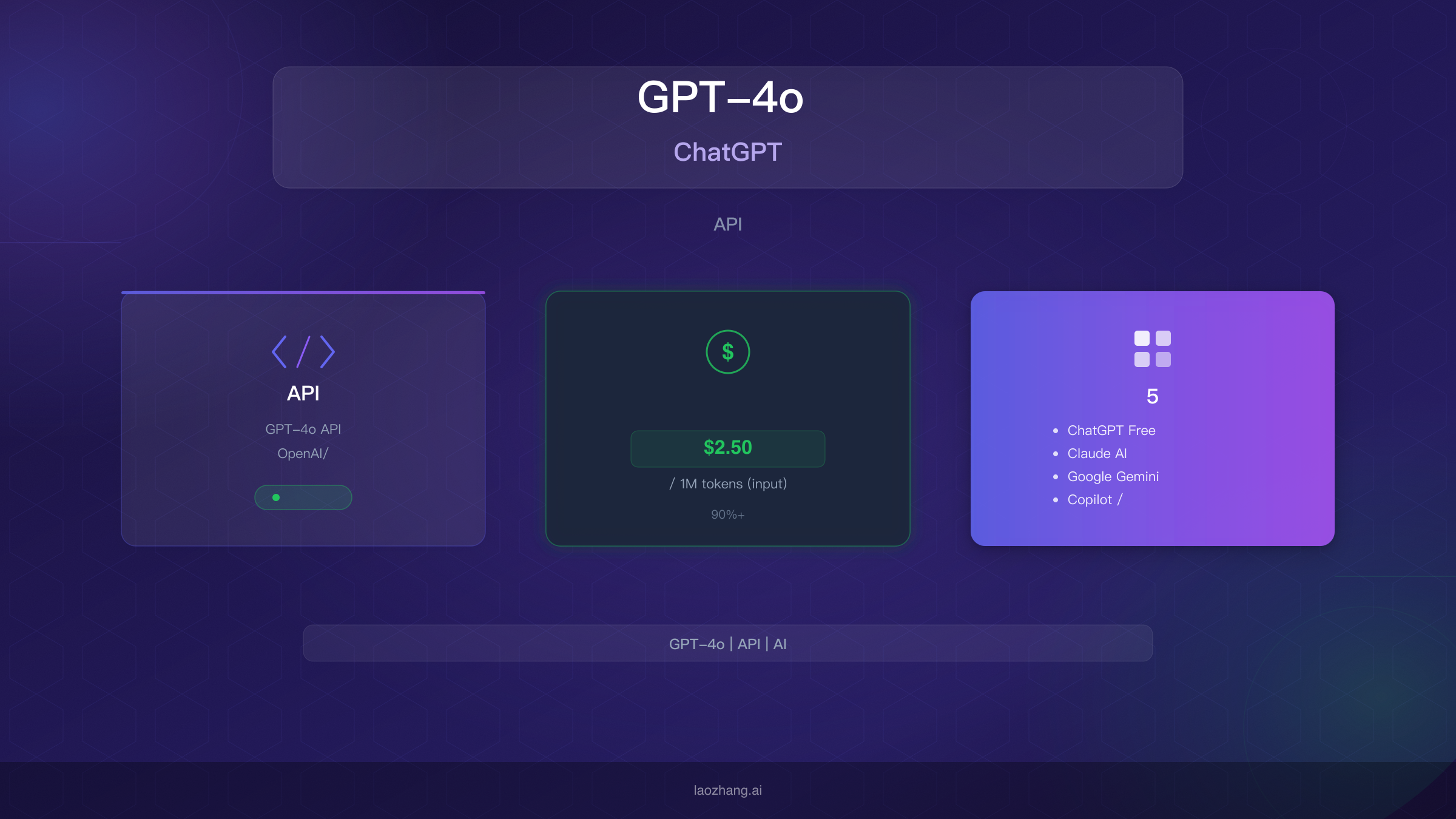

TL;DR — GPT-4o免费使用核心要点

- ChatGPT中已退役:GPT-4o于2026年2月13日从ChatGPT全面退役,被GPT-5.2取代(据OpenAI官方公告)

- API仍然可用:GPT-4o在OpenAI API中暂无退役计划,开发者仍可正常调用

- 免费替代:ChatGPT免费版现提供GPT-4o-mini,每小时约30次对话

- 五大免费方案:ChatGPT免费版、Claude、Gemini、Copilot、开源模型各有优势

- 国内方案:通过API中转服务可无需科学上网使用GPT-4o及最新模型

GPT-4o现状:从ChatGPT免费模型到正式退役

GPT-4o的退役并非突然发生,而是OpenAI模型迭代策略的一部分。随着GPT-5系列的发布和成熟,OpenAI的使用数据显示仅有0.1%的用户仍在主动选择GPT-4o(据OpenAI官方公告),绝大多数用户已自然迁移到了性能更强的GPT-5.2。基于这一数据,OpenAI决定简化产品线,将GPT-4o与GPT-4.1、GPT-4.1 mini、o4-mini等旧模型一同从ChatGPT中移除。

这次退役的具体时间线是:OpenAI于2026年1月底宣布计划,2月13日正式执行退役操作。退役后,所有ChatGPT用户(包括免费版和Plus付费版)在聊天界面中都无法再选择GPT-4o作为对话模型。此前使用GPT-4o创建的自定义GPTs也会自动迁移到新模型上运行。值得注意的是,这次退役引发了相当大的用户反响——许多用户对GPT-4o的对话风格和"人格"有情感依赖,这一现象也引发了业界对AI伴侣关系的讨论。

对于开发者而言,一个重要的好消息是:GPT-4o在OpenAI API中目前没有退役计划。这意味着通过API调用GPT-4o的应用和服务不受影响,开发者仍然可以在项目中使用这个模型。不过,考虑到OpenAI的长期趋势,建议新项目优先考虑GPT-5系列模型,将GPT-4o作为成本优化的备选方案。如果你对各主流AI模型的功能和定价对比感兴趣,我们有更详细的专题分析。

ChatGPT免费版现在能用什么

GPT-4o退役后,ChatGPT的模型配置发生了显著调整。了解当前各版本的具体差异,有助于你选择最适合的使用方案。

ChatGPT免费版目前的默认模型是GPT-4o-mini,这是一个针对速度和成本优化的轻量级模型。虽然名字中包含"4o",但它的能力更接近于GPT-4级别——在日常对话、简单问答和基础写作方面表现良好,但在复杂推理、代码生成和长文本处理方面与GPT-5.2有明显差距。免费版用户每小时大约可以进行30次对话,支持文件上传、图像理解、基础网页浏览和GPT Store访问。

ChatGPT Plus付费版($20/月)则提供了GPT-5.2作为主力模型。GPT-5.2在推理深度、知识广度、代码能力和多模态理解方面都显著超越了GPT-4o。Plus用户还享有更高的使用频率限制、优先响应速度、以及高级功能如深度研究和扩展思考模式。对于需要了解ChatGPT各版本差异的用户,建议查看我们的详细对比文章。

下表清晰展示了当前ChatGPT各版本的核心差异:

| 维度 | 免费版 | Plus ($20/月) | Pro ($200/月) |

|---|---|---|---|

| 默认模型 | GPT-4o-mini | GPT-5.2 | GPT-5.2 + o3-pro |

| 使用频率 | ~30次/小时 | 更高频率 | 无限使用 |

| 图像生成 | 有限 | gpt-image-1 | 无限制 |

| 网页浏览 | 基础 | 深度研究 | 深度研究 |

| 文件上传 | 支持 | 支持 | 支持 |

| 自定义GPTs | 使用 | 创建+使用 | 创建+使用 |

| API访问 | 不支持 | 不支持 | 不支持 |

通过API免费使用GPT-4o的完整方案

虽然GPT-4o在ChatGPT中已退役,但通过OpenAI API仍然可以正常使用这个模型。对于开发者和技术用户来说,API方式不仅能访问GPT-4o,还能以更灵活的方式集成到各种应用中。OpenAI为新注册用户提供了免费的API额度,这也是"免费使用GPT-4o"在当前最可行的方案之一。

官方直连方式需要在OpenAI Platform注册账号并绑定信用卡(验证身份,不一定会扣费),然后创建API Key即可调用。新用户通常会获得一定额度的免费赠送。不过对于国内用户,直连面临网络不稳定和支付困难等挑战。

通过API中转服务是国内开发者的主流选择。以laozhang.ai为例,只需将API端点替换即可——代码完全兼容OpenAI官方格式,支持支付宝和微信支付,注册即送免费额度,无需科学上网。

以下是使用OpenAI Python SDK调用GPT-4o的完整代码:

pythonfrom openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.laozhang.ai/v1" # 国内用户使用中转地址

)

# 基础文本对话

response = client.chat.completions.create(

model="gpt-4o",

messages=[

{"role": "system", "content": "你是一个专业的AI助手。"},

{"role": "user", "content": "请用通俗的语言解释什么是大语言模型。"}

]

)

print(response.choices[0].message.content)

多模态调用(图像理解)同样简单:

pythonimport base64

def encode_image(path):

with open(path, "rb") as f:

return base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="gpt-4o",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": "描述这张图片的内容。"},

{"type": "image_url", "image_url": {

"url": f"data:image/png;base64,{encode_image('photo.png')}"

}}

]

}]

)

print(response.choices[0].message.content)

Node.js用户可以使用以下方式:

javascriptimport OpenAI from 'openai';

const client = new OpenAI({

apiKey: 'your-api-key',

baseURL: 'https://api.laozhang.ai/v1'

});

const response = await client.chat.completions.create({

model: 'gpt-4o',

messages: [

{ role: 'user', content: '解释量子计算的基本原理。' }

]

});

console.log(response.choices[0].message.content);

流式输出对于需要实时显示回答的应用场景至关重要。以下Python代码展示了如何实现流式响应:

pythonstream = client.chat.completions.create(

model="gpt-4o",

messages=[{"role": "user", "content": "写一首关于春天的诗。"}],

stream=True

)

for chunk in stream:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="", flush=True)

结构化输出是GPT-4o的另一个实用功能。通过指定response_format参数,可以让模型输出严格的JSON格式数据,这在数据提取和自动化流程中非常有用:

pythonresponse = client.chat.completions.create(

model="gpt-4o",

messages=[{

"role": "user",

"content": "分析以下产品评论的情感倾向:'这款手机拍照效果不错,但电池续航太差了。'"

}],

response_format={"type": "json_object"}

)

import json

result = json.loads(response.choices[0].message.content)

print(result)

# {"sentiment": "mixed", "positive": ["拍照效果"], "negative": ["电池续航"]}

值得注意的是,通过API使用GPT-4o和通过ChatGPT聊天界面使用有一个本质区别:API方式没有每小时对话次数的限制,只要你的账户余额充足,就可以按需调用。这使得API成为大量、频繁使用GPT-4o的最佳途径,尤其适合需要批量处理任务的开发者和企业用户。

GPT-4o退役的影响与迁移建议

GPT-4o的退役对不同类型的用户有着不同程度的影响,理解这些影响有助于做出正确的迁移决策。

对于普通ChatGPT用户来说,影响其实很小。ChatGPT会自动将你的对话模型切换到GPT-5.2(Plus用户)或GPT-4o-mini(免费用户),你几乎不需要做任何操作。大多数用户在日常使用中甚至不会察觉到模型的变化——GPT-5.2在各项核心能力上都优于GPT-4o,唯一的差异在于一些用户反馈GPT-5.2的"对话风格"更加直接和简洁,少了GPT-4o那种略带温暖的个性化表达。如果你不喜欢新模型的风格,可以通过自定义指令(Custom Instructions)来调整。

对于开发者和企业用户来说,需要关注的主要是两个方面。第一,如果你的应用中硬编码了gpt-4o作为模型名称且通过ChatGPT方式调用,需要更新为API调用方式或切换到新模型。第二,自定义GPTs如果依赖GPT-4o的特定行为特征,迁移后可能需要调整Prompt和配置。我们建议的迁移策略是:保留GPT-4o的API调用作为成本敏感型任务的方案,同时将高质量需求迁移到GPT-5.2。对于更多ChatGPT使用方法的讨论,可以参考我们的专题文章。

对于依赖GPT-4o图像理解能力的用户,好消息是GPT-4o的多模态能力在API中仍然完整可用。图像理解、文档分析、视觉问答等功能通过API调用的方式丝毫不受退役影响。而图像生成方面,OpenAI已经推出了独立的gpt-image-1模型来承接这部分需求。

五大免费AI替代方案深度对比

对于不需要专门使用GPT-4o、而是寻找"免费好用的AI"的用户来说,当前的选择比以往任何时候都丰富。以下是五个最值得推荐的免费方案,每个都有其独特的优势场景。

ChatGPT免费版仍然是普及度最高的选择。它提供的GPT-4o-mini虽然不是最强模型,但在日常对话、翻译、摘要、简单代码编写等场景中表现稳定可靠。免费版的最大优势是无需任何付费即可使用,且支持文件上传和基础图像理解。主要限制是每小时约30次对话的频率限制,以及不支持高级推理和深度研究功能。对于国内用户,访问ChatGPT仍需科学上网,这一点可以参考我们的ChatGPT免费使用详细指南。

Claude免费版是Anthropic提供的竞争方案,当前免费版使用的是Claude 4.5 Haiku模型。Claude在长文本处理、代码分析和学术写作方面有独特优势——它支持高达200K token的上下文窗口,能一次性处理整本书或大型代码库。免费版每天提供的使用额度比ChatGPT更加慷慨,不过具体限制会根据服务器负载动态调整。Claude的另一个优势是内容安全性设计更加严格,输出内容在事实准确性方面通常表现更好。国内用户同样需要科学上网才能访问claude.ai。

Google Gemini免费版提供了Gemini 2.5 Flash模型的免费访问权限。作为Google的旗舰AI产品,Gemini的最大优势在于与Google生态系统的深度整合——它可以直接访问Google搜索获取最新信息、理解YouTube视频内容、分析Google Workspace文档等。在多模态能力方面,Gemini对图像和视频的理解能力尤为突出。更重要的是,Google Gemini对中国大陆用户的访问限制相对宽松,部分地区可以直接使用,这对国内用户来说是一个显著优势。

Microsoft Copilot集成了多种AI模型(包括GPT系列),通过Bing搜索引擎、Windows系统和Office套件免费提供。Copilot的核心优势在于零门槛——无需注册即可在Bing搜索中使用,且内置了实时搜索能力,回答中会引用网页来源。对于日常信息查询和办公场景,Copilot是最便捷的选择。不过,Copilot在深度对话、代码生成和创意写作方面的能力不如专用AI聊天平台。

开源模型自部署适合有技术能力和GPU资源的用户。当前性能最强的开源模型包括Llama 3.1 405B、Mixtral 8x22B和Qwen-2.5等,通过Ollama或vLLM等工具可以在本地或云服务器上部署。自部署的最大优势是完全免费且无使用限制——数据不离开自己的服务器,可以无限制调用。代价是需要强大的GPU硬件(推荐至少24GB显存)和一定的运维能力。

对于想要快速体验开源模型的用户,Ollama提供了最简单的本地部署方式。只需三行命令即可在Mac或Linux上运行一个接近GPT-4o水平的开源模型:

bash# 安装Ollama

curl -fsSL https://ollama.com/install.sh | sh

# 下载并运行Qwen-2.5(推荐中文场景)

ollama run qwen2.5:32b

# 或者运行Llama 3.1(推荐英文场景)

ollama run llama3.1:70b

Ollama还提供了与OpenAI兼容的API接口,这意味着你可以用完全相同的代码同时支持OpenAI API和本地开源模型——只需切换base_url即可。

| 方案 | 模型能力 | 使用限制 | 国内可用性 | 最适合场景 |

|---|---|---|---|---|

| ChatGPT免费 | GPT-4o-mini | ~30次/小时 | 需科学上网 | 日常对话、翻译 |

| Claude免费 | Claude 4.5 Haiku | 每日动态额度 | 需科学上网 | 长文本、代码分析 |

| Gemini免费 | Gemini 2.5 Flash | 每日动态额度 | 部分可用 | 搜索整合、视频理解 |

| Copilot | 多模型 | 基础限制 | 基本可用 | 日常查询、办公 |

| 开源自部署 | Llama/Qwen等 | 无限制 | 完全可用 | 隐私、无限制使用 |

国内用户专属方案:无需科学上网的AI访问

对于国内用户来说,科学上网的不稳定性和法律风险使得直接访问国外AI服务并不理想。幸运的是,目前有多种合规且稳定的替代方案,让国内用户也能享受到世界顶级AI模型的能力。

API中转服务是技术含量最高、也最灵活的方案。中转服务的工作原理是在海外服务器上代理API请求,用户只需将代码中的API端点替换即可。以laozhang.ai为例,它支持OpenAI全系列模型(包括GPT-4o、GPT-5.2)以及Claude、Gemini等其他厂商模型,一个API Key即可访问数十种模型。中转服务的价格通常与官方持平或更低,加上免去了科学上网和外币支付的成本,对于有API开发需求的用户来说是最经济的选择。如果你需要了解API中转服务的详细评测,可以参考我们的专题文章。

国产AI模型在近两年取得了飞速发展,部分场景下已经不输国际顶级模型。百度文心一言、阿里通义千问、字节豆包、智谱清言等都提供了免费使用额度,且完全不需要科学上网。特别是在中文理解和生成方面,这些模型的表现往往比GPT-4o更好——毕竟它们在中文语料上的训练更加充分。缺点是在英语能力、代码生成和复杂推理方面,与GPT-5.2和Claude 4.5仍有差距。

选择方案时的核心考量因素包括:你是否需要API级别的灵活性(选中转服务)、是否主要进行中文交互(选国产模型)、是否有预算限制(选免费版)、以及是否对数据隐私有严格要求(选开源自部署)。对于大多数普通用户,国产AI模型已经能满足日常需求;对于开发者和技术用户,API中转服务则提供了最佳的性价比和灵活性。

下表汇总了国内用户各方案的核心特征:

| 方案 | 技术门槛 | 月均成本 | 模型能力 | 适合人群 |

|---|---|---|---|---|

| API中转 | 中等(需写代码) | 按量付费 | GPT-4o/5.2/Claude | 开发者 |

| 国产AI | 零门槛 | 免费 | 接近GPT-4o | 普通用户 |

| 开源部署 | 高(需GPU) | 服务器成本 | 接近GPT-4o | 技术团队 |

| ChatGPT镜像 | 低 | 免费-低 | 取决于站点 | 普通用户 |

对于企业用户来说,还有一个值得考虑的方案是通过Azure OpenAI Service接入GPT-4o。Azure在中国香港地区有数据中心,延迟相比直连美国服务器低很多。企业通过Azure订阅可以获得企业级的SLA保障、数据合规支持和专属技术支持,虽然不是"免费"方案,但对于有预算的企业来说是最正规的选择。

另一个容易被忽视的方案是GitHub Copilot中的GPT-4o。GitHub Copilot的付费版($10/月)在代码补全和AI对话功能中使用了包括GPT-4o在内的多种模型。对于开发者来说,Copilot不仅提供了AI聊天能力,更重要的是它与IDE深度集成的代码补全功能——这可能是GPT-4o在编程场景中性价比最高的使用方式。

GitHub还为学生和开源项目维护者提供了免费的Copilot访问权限。如果你是在校学生,通过GitHub Education认证即可获得Copilot的完全免费使用权,这也间接实现了"免费使用GPT-4o"的目标。对于开源贡献者,只要维护的项目达到一定活跃度标准,同样可以申请免费的Copilot Pro权限。

各方案实战体验对比:真实使用场景测试

为了给读者提供更有参考价值的信息,我们以三个典型使用场景对上述五大免费方案进行了实测对比。

场景一:中英文翻译(500字商务邮件)。在这个日常任务中,五个方案的表现差异不大。ChatGPT免费版(GPT-4o-mini)和Claude免费版的翻译质量最为接近,都能准确传达商务语境和专业术语;Gemini的翻译偏向直译,有时缺少地道的中文表达;Copilot的翻译质量取决于后端调用的具体模型,表现不太稳定;开源模型中Qwen-2.5在中英翻译方面表现出色,不逊于GPT-4o-mini。综合评分:ChatGPT免费版和Claude并列第一。

场景二:代码调试(200行Python异常处理)。代码场景下各方案的差距更加明显。Claude免费版在代码分析方面表现最为突出——它能完整阅读代码上下文,准确定位bug并给出修复建议。ChatGPT免费版(GPT-4o-mini)在简单bug上表现良好,但面对涉及多文件关联的复杂bug时,受限于上下文窗口大小(约128K token),准确率下降明显。Gemini在代码方面的表现中规中矩,Copilot则更适合在IDE中提供行级别的代码建议而非完整的调试方案。综合评分:Claude免费版第一,ChatGPT免费版第二。

场景三:长文写作(2000字产品分析报告)。长文写作是对AI模型综合能力的考验。ChatGPT免费版虽然模型能力有限,但输出的结构性和可读性依然不错,适合生成初稿后人工润色;Claude免费版在深度分析和逻辑论证方面最为出色,输出内容往往更加nuanced,不过有时会过于冗长;Gemini的优势在于可以实时搜索最新数据来支撑论点,但文本风格偏平淡;Copilot在长文写作方面较弱,更适合短回答场景。综合评分:Claude免费版第一,ChatGPT免费版第二。

GPT-4o API成本优化与最佳实践

对于仍然需要通过API使用GPT-4o的开发者来说,了解其定价结构和优化策略可以显著降低成本。根据OpenAI官方定价页面的数据,GPT-4o当前的API定价为:

GPT-4o API定价:输入 $2.50/百万token,输出 $10.00/百万token。相比GPT-5.2(输入$5/百万token,输出$15/百万token),GPT-4o的成本优势约为50%(据OpenAI Pricing页面)。

这意味着对于不需要GPT-5.2级别推理能力的应用场景——比如内容摘要、基础问答、数据提取和格式转换等任务——使用GPT-4o可以在保证质量的同时节省一半的API费用。如果对OpenAI各模型的定价对比感兴趣,我们有更详细的分析。

以一个实际案例来说明成本差异:假设你运营一个客服问答系统,每天处理1000个用户查询,平均每次查询消耗500输入token和300输出token。使用GPT-5.2的日均成本约为$7.00($5x0.5M + $15x0.3M),而使用GPT-4o则只需$4.25($2.5x0.5M + $10x0.3M),月度差异接近$83。如果进一步将简单查询(约占60%)分流到GPT-4o-mini,月度总成本可以从GPT-5.2方案的$210降至约$80——节省超过60%。这种分层策略在实际生产环境中被广泛采用,是API成本优化的核心方法论。

成本优化的几个核心策略值得在实际项目中贯彻执行。Prompt精简是最直接有效的方法——减少系统提示词的长度,避免在每次请求中重复发送大量上下文。实际测试表明,一个精心设计的50 token系统提示词通常能达到500 token提示词90%以上的效果。缓存机制同样关键——对于相同或相似的查询,在应用层建立缓存可以避免重复调用API。

模型选择分层也是成熟项目的常见做法:简单任务用GPT-4o-mini(价格仅为GPT-4o的十分之一),中等任务用GPT-4o,复杂任务再上GPT-5.2,通过路由逻辑实现最优的成本-质量平衡。以下代码展示了一个简单的模型路由实现:

pythonfrom openai import OpenAI

client = OpenAI(api_key="your-api-key")

def smart_route(query, complexity="auto"):

"""根据任务复杂度自动选择最优模型"""

if complexity == "auto":

# 简单启发式:短查询用mini,长查询用4o

complexity = "simple" if len(query) < 200 else "medium"

model_map = {

"simple": "gpt-4o-mini", # $0.15/$0.60 per 1M tokens

"medium": "gpt-4o", # $2.50/$10.00 per 1M tokens

"complex": "gpt-5.2", # $5.00/$15.00 per 1M tokens

}

response = client.chat.completions.create(

model=model_map[complexity],

messages=[{"role": "user", "content": query}]

)

return response.choices[0].message.content

下表总结了三个层级的模型选择策略:

| 任务类型 | 推荐模型 | 输入价格/1M token | 典型场景 |

|---|---|---|---|

| 简单任务 | GPT-4o-mini | $0.15 | 翻译、摘要、格式转换 |

| 中等任务 | GPT-4o | $2.50 | 内容生成、数据分析、问答 |

| 复杂任务 | GPT-5.2 | $5.00 | 深度推理、代码生成、研究 |

免费AI使用的未来趋势

AI模型的免费可用性正在经历一个有趣的演变过程。一方面,OpenAI、Google、Anthropic等公司持续为免费用户提供越来越强大的模型访问权——ChatGPT免费版从最初的GPT-3.5到GPT-4o-mini,能力已经提升了数倍。另一方面,随着模型训练和推理成本的持续下降,API定价也在稳步走低,GPT-4o级别的能力在两年前需要$30/百万token,现在只需$2.50/百万token。

这一趋势意味着对于普通用户来说,免费获得高质量AI服务将变得越来越容易。目前的"免费版限制+付费版升级"模式可能会逐步演变为"基础功能免费+高级功能付费"的SaaS模式,类似于Gmail或Google Drive的分层策略。对于开发者而言,API成本的下降意味着更多创业想法变得经济可行——以前需要每月数千美元API费用才能运营的AI应用,现在可能只需要几十美元。

值得关注的另一个趋势是开源模型的快速追赶。Llama、Qwen、Mistral等开源模型的性能已经接近甚至在某些领域超过了GPT-4o,而这些模型是完全免费使用的。随着更强大的开源模型持续发布,"免费使用顶级AI"可能不再需要依赖任何商业公司的免费额度策略,而是通过开源社区的力量实现真正的无限制免费使用。这对整个AI行业和终端用户来说都是一个积极的信号。

常见问题解答(FAQ)

GPT-4o退役后ChatGPT免费版还能用吗?

完全可以继续使用。ChatGPT免费版在GPT-4o退役后自动切换到GPT-4o-mini作为默认模型。虽然GPT-4o-mini的推理深度不如GPT-4o,但在日常对话、翻译、摘要等基础任务上表现依然出色。免费版还保留了文件上传、图像理解和基础网页浏览等功能,每小时大约可以进行30次对话,足够满足大多数个人用户的日常需求。

GPT-4o的API还能用多久?

截至当前,OpenAI尚未公布GPT-4o API的退役计划。从ChatGPT退役到API退役通常会有相当长的过渡期——以GPT-3.5为例,它从ChatGPT下线后API又持续运行了超过一年。不过,OpenAI可能会逐步提高旧模型API的定价或降低其优先级。建议开发者在新项目中优先使用GPT-5.2或GPT-4o-mini,将GPT-4o作为过渡期的成本优化方案。

国内用户不翻墙能用ChatGPT吗?

直接使用ChatGPT网页版仍然需要科学上网。但有两个可行的替代路径:第一,通过API中转服务在自己的应用中调用ChatGPT的模型能力,完全不需要科学上网——代码中只需更换API端点即可;第二,使用国产AI模型如通义千问、文心一言等,它们在中文场景下的表现已经非常接近GPT-4o水平,且可以直接在国内访问。

GPT-4o和GPT-5.2哪个更值得用?

取决于你的具体需求和预算。GPT-5.2在推理深度、知识广度和多模态能力方面全面超越GPT-4o,是需要高质量输出的首选。但GPT-4o的API价格约为GPT-5.2的50%,对于内容摘要、数据提取、基础问答等不需要顶级推理能力的任务,GPT-4o仍然是更经济的选择。最佳策略是根据任务复杂度分层使用不同模型。

如何判断自己正在使用的是真正的GPT-4o?

通过API调用时,返回的响应体中会包含model字段,明确标示使用的模型版本(如gpt-4o-2024-08-06)。通过中转服务调用时,模型信息同样会在响应中返回,可以据此验证。如果使用第三方聊天界面,可以通过测试模型的多模态能力(如图像理解)和知识截止日期来间接判断。

免费使用AI有哪些安全注意事项?

无论使用哪种免费AI方案,都需要注意以下几点:不要在对话中输入敏感个人信息(身份证号、银行卡号等);不要将公司机密数据作为AI输入内容;使用第三方服务时确认其数据隐私政策;对AI生成的内容保持批判性思维,尤其是涉及医疗、法律和财务建议时。如果对数据安全有严格要求,建议使用开源模型自部署方案,这样数据完全不离开自己的服务器。另外,选择API中转服务时要关注服务商的资质和口碑,优先选择运营时间长、用户评价好的平台。

ChatGPT Plus值得订阅吗?免费版够用吗?

这取决于你的使用频率和需求层次。如果你每天只是偶尔用AI查查资料、翻译几段文字、写简单的邮件,免费版的GPT-4o-mini完全够用。但如果你是重度用户——每天需要大量使用AI辅助工作,或者你的任务涉及复杂推理(如数据分析、长代码编写、学术研究),那么$20/月的Plus订阅物有所值。GPT-5.2的能力显著超越免费版模型,长期来看它能节省的时间远超订阅费用。另一个思路是通过API按量付费,对于使用量波动较大的用户,这种方式可能比固定月费更经济。

GPT-4o-mini和GPT-4o有什么区别?

GPT-4o-mini是GPT-4o的轻量级版本,在模型架构上进行了精简以降低推理成本和延迟。两者在日常对话和基础任务上的表现差距不大,但在复杂推理、长文本生成和多步骤任务方面,GPT-4o明显更强。

从定价角度看,GPT-4o-mini的API价格仅为GPT-4o的约十分之一(输入$0.15 vs $2.50/百万token),这使得它成为对成本敏感的批量处理场景的首选。在ChatGPT中,免费版用户目前使用的就是GPT-4o-mini,而GPT-4o需要通过API单独调用。对于大多数日常使用场景,GPT-4o-mini已经足够好用。

本文基于OpenAI官方公告和实际体验编写,产品功能和价格以最新官方信息为准。